📢 转载信息

原文链接:http://bair.berkeley.edu/blog/2025/03/25/rl-av-smoothing/

原文作者:BAIR

我们向高峰时段的高速公路车流中投放了 100 辆由强化学习(RL)控制的自动驾驶汽车,旨在缓解交通拥堵并降低所有车辆的燃油消耗。我们的目标是解决令人沮丧的“走走停停”波(stop-and-go waves),这些现象通常没有明确原因,却会导致严重的交通延误和能源浪费。为了训练高效的流量平滑控制器,我们构建了基于数据驱动的高速仿真环境,RL 智能体在其中学习在保证通行效率与安全性的前提下,最大化能源效率。

总体而言,只需极少比例配置良好的自动驾驶汽车(AV),就足以显著改善道路上所有司机的交通流量和燃油效率。此外,这些训练好的控制器设计为可部署在大多数现代车辆上,以去中心化的方式运行,并依赖标准的雷达传感器。在我们最新的论文中,我们探讨了在 100 辆车的实地实验中,将 RL 控制器从仿真环境扩展到大规模现实部署所面临的挑战。

幻影堵车的挑战

只要你开车,就一定经历过那种“走走停停”带来的挫败感——那些似乎凭空出现又突然消失的交通拥堵。这些波往往是由我们在驾驶行为中的微小波动造成的,并随着车流扩散而放大。我们通常根据前车调整车速;如果间距变大,我们会加速;如果前车刹车,我们也会减速。但由于人类驾驶员非零的反应时间,我们往往刹车比前车更重,后车亦然,导致这种波动不断累积。随着时间推移,最初微不足道的减速演变成了后方交通的完全停滞。这些波在车流中向后传播,由于频繁加速导致巨大的能效损失,并伴随 CO2 排放增加和事故风险。

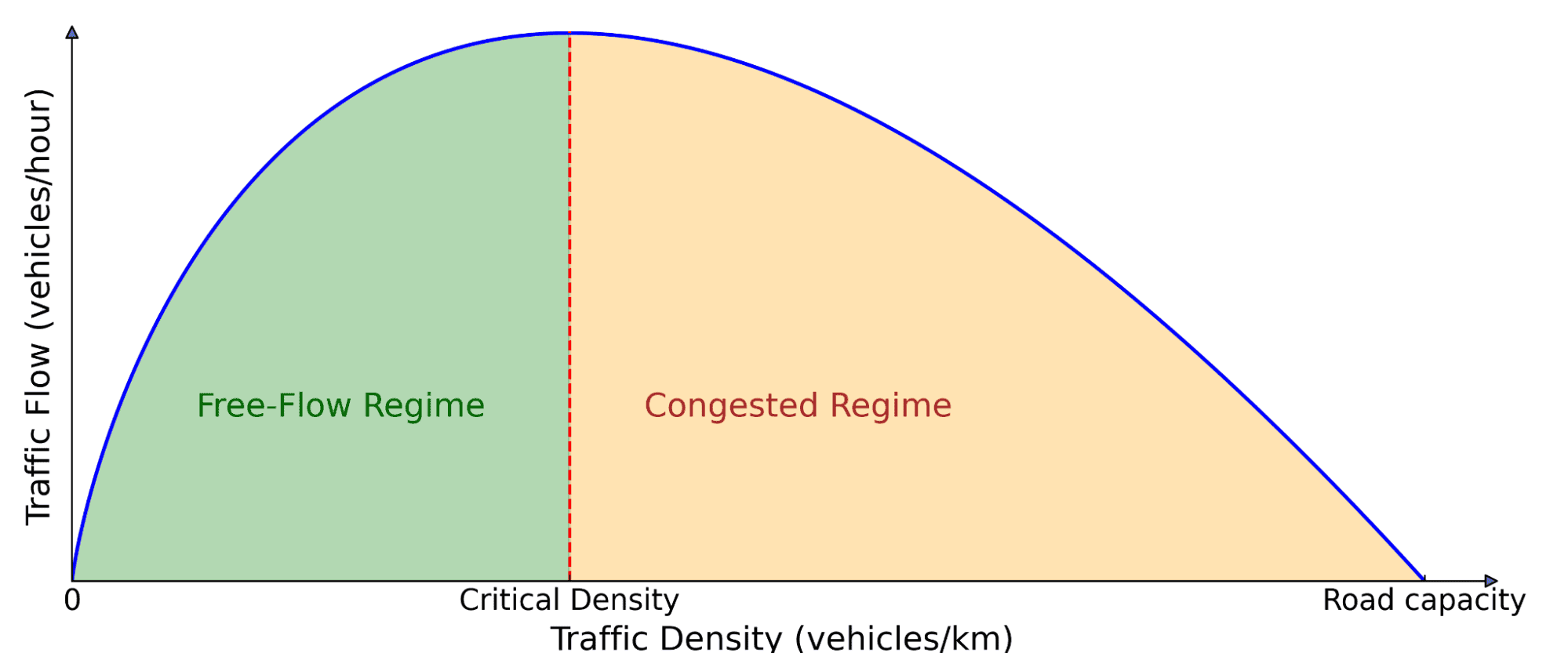

这并非个例!当交通密度超过临界阈值时,这些波在繁忙道路上无处不在。传统方法(如匝道控制和可变限速)需要昂贵的基础设施和集中协调。一种更具扩展性的方法是利用自动驾驶汽车,它们可以实时动态调整驾驶行为。然而,仅仅在人类驾驶员中插入自动驾驶汽车是不够的,它们必须以更聪明的方式驾驶,从而让交通状况对每个人都有所改善,这正是强化学习发挥作用的地方。

用于平滑波动的强化学习自动驾驶

强化学习是一种强大的控制方法,智能体通过与环境交互学习最大化奖励信号。在我们的案例中,环境是一个混合自主性的交通场景,自动驾驶汽车学习驾驶策略来减弱“走走停停”波,并减少自身及周围车辆的油耗。

我们设计自动驾驶汽车时充分考虑了部署需求,确保它们仅使用关于自身及前方车辆的基础传感器信息即可操作。RL 控制器根据 AV 的速度、前车速度和间距,计算出瞬时加速度或目标速度。这种只依赖局部测量的优势在于,它可以无需额外基础设施直接部署在大多数现代车辆上。

奖励设计

最具挑战性的部分是设计奖励函数,以平衡多个目标:

- 波平滑:减少走走停停的震荡。

- 能源效率:降低包括人类驾驶员在内的所有车辆油耗。

- 安全性:确保合理的跟车距离,避免急刹车。

- 驾驶舒适度:避免激进的加速和减速。

- 人类驾驶规范:保持正常的驾驶行为,不让周围司机感到不安。

100 辆自动驾驶汽车现场测试:大规模部署 RL

鉴于仿真结果的优异表现,下一步是从仿真转向高速公路。我们在高峰时段的 I-24 高速公路上部署了 100 辆车。这是有史以来规模最大的混合自主性交通平滑实验,被称为“MegaVanderTest”。

在通过计算机视觉管道提取数百万条车辆轨迹后,我们发现围绕自动驾驶汽车的区域油耗确实有所降低。实验数据显示,能源节省幅度约在 15% 到 20% 之间。这证明了即使只有小比例的智能自动驾驶汽车存在,也能有效减轻交通拥堵中的波动。

总结

这项 100 辆车的实地测试是完全去中心化的,没有任何车辆间的显式协作,证明了在大规模部署下提升公路平滑度和能源效率的可行性。随着配备此类智能平滑控制的车辆增多,我们道路上的拥堵波将越来越少,这意味着更少的污染和为每个人带来的燃油节省。

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区