📢 转载信息

原文链接:https://machinelearningmastery.com/5-production-scaling-challenges-for-agentic-ai-in-2026/

原文作者:Nahla Davies

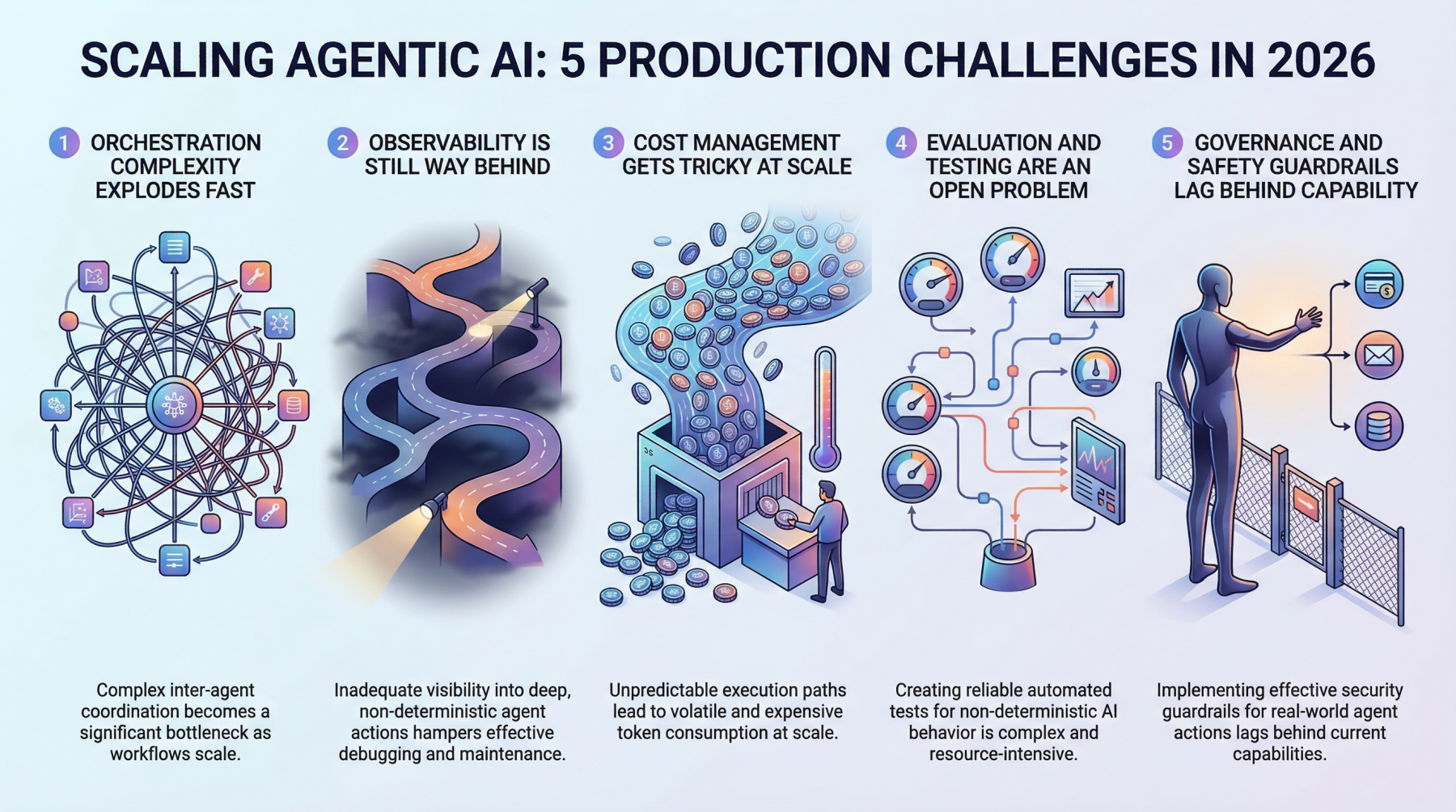

在本文中,你将了解到2026年团队在将AI智能体系统从原型扩展到生产过程中面临的五大主要挑战。

我们将涵盖的主题包括:

- 为什么多智能体系统的编排复杂性增长迅速。

- 在生产环境中,可观测性、评估和成本控制为何仍然困难。

- 为什么治理和安全护栏在智能体系统采取实际行动时变得至关重要。

让我们开始吧。

2026年AI智能体生产规模化的五大挑战

图片来源:Editor

引言

眼下,无论好坏,每个人都在构建AI智能体系统。演示效果令人难以置信,原型感觉像魔法,而宣传材料几乎可以自行完成。

但有一件事没人发推特谈论:让这些东西在生产环境中真正大规模运行,面对真实用户和真实风险,是完全不同的游戏。在机器学习领域,华丽演示和可靠的生产系统之间的差距一直存在,但AI智能体将其拉宽的程度超出了我们以往的任何经验。

这些系统自主地做出决策、采取行动并链接复杂的流程。这既强大,又令人恐惧,当它大规模出现问题时。所以,让我们来谈谈2026年团队在努力扩展AI智能体时遇到的五大最棘手的难题。

1. 编排复杂性呈爆炸式增长

当你只有一个智能体处理一个狭窄的任务时,编排似乎是可管理的。你定义一个工作流,设置一些护栏,然后事情大多还能正常运行。但生产系统很少能保持那么简单。一旦你引入多智能体架构,智能体之间相互委托、重试失败的步骤或动态选择调用哪个工具,你就会面临几乎呈指数级增长的编排复杂性。

团队发现,智能体之间的协调开销成为瓶颈,而不是单个模型的调用。智能体在等待其他智能体,异步流程中出现竞态条件,以及级联故障,这些都极难在预演环境中重现。传统的流程引擎并未为这种程度的动态决策制定做好准备,大多数团队最终会构建定制的编排层,而这层东西很快就成为整个技术栈中最难维护的部分。

真正令人头疼的是,这些系统在负载下表现不同。一个在每分钟100次请求时都能完美运行的编排模式,在10,000次请求时可能完全崩溃。调试这种差距需要一种机器学习团队仍在开发的系统性思维。

2. 可观测性仍远远落后

你无法修复你看不到的东西,而目前,大多数团队还看不到他们在生产环境中AI智能体系统做了什么。传统的机器学习监控会跟踪延迟、吞吐量和模型准确性等指标。这些指标仍然很重要,但它们几乎无法触及AI智能体工作流的表面。

当一个智能体进行12步的旅程来回答用户查询时,你需要理解沿途的每一个决策点。为什么它选择工具A而不是工具B?为什么它重试了第4步三次?为什么最终的输出完全不符合要求,尽管每一步中间看起来都很好?这种深度可观测性的追踪基础设施仍然不成熟。大多数团队会拼凑LangSmith、自定义日志记录以及大量的希望。

AI智能体的行为本质上是非确定性的,这使得问题更加复杂。相同的输入可能产生截然不同的执行路径,这意味着你无法简单地截取一个故障并可靠地重现它。为本质上不可预测的系统构建强大的可观测性仍然是该领域最大的未解决问题之一。

3. 成本管理在规模化时变得棘手

这是一件让许多团队措手不及的事情:运行AI智能体系统的成本很高。每个智能体动作通常涉及一个或多个LLM调用,当智能体为每个请求链接数十个步骤时,token成本会惊人地迅速累积。一个每次执行成本为0.15美元的工作流,当你每天处理500,000个请求时,就会显得很高。

聪明的团队正在创造性地优化成本。他们将更简单的子任务交给更小、更便宜的模型,同时为复杂的推理步骤保留强大的模型。他们积极缓存中间结果,并构建紧急停止开关,在智能体循环失控烧完预算之前将其终止。但在成本效率和输出质量之间始终存在一种张力,找到正确的平衡需要持续的实验。

计费的不可预测性是让工程主管们压力倍增的原因。与传统API不同,你可以相当准确地估算成本,AI智能体系统具有可变的执行路径,这使得成本预测非常困难。一个边缘案例可能会触发一系列重试,其成本是正常路径的50倍。

4. 评估和测试是一个公开的问题

你如何测试一个每次运行时都能采取不同路径的系统?这就是让机器学习工程师夜不能寐的问题。传统的软件测试假设行为是确定的,而传统的机器学习评估假设输入-输出映射是固定的。AI智能体同时打破了这两种假设。

团队正在试验一系列方法。一些团队正在构建“LLM作为裁判”的管道,由一个独立的模型来评估智能体的输出。另一些团队则在创建基于场景的测试套件,以检查行为属性而不是精确的输出。少数团队正在投资于模拟环境,让智能体在进入生产环境之前能够通过数千个合成场景进行压力测试。

但这些方法似乎都没有真正成熟。评估工具分散,基准不一致,而且对于复杂的AI智能体工作流来说,“好”甚至意味着什么,行业内还没有达成共识。大多数团队最终严重依赖人工审查,这显然无法规模化。

5. 治理和安全护栏落后于能力

AI智能体系统可以在现实世界中采取实际行动。它们可以发送电子邮件、修改数据库、执行交易以及与外部服务交互。这种自主性的安全影响是巨大的,而治理框架尚未跟上这些功能部署的速度。

挑战在于实施足够健壮的护栏来防止有害行为,同时又不能过于严格以至于扼杀了智能体的实用性。这是一个微妙的平衡,大多数团队正在通过试错来学习。权限系统、行动审批工作流和范围限制都会增加摩擦,这可能会破坏拥有自主智能体的初衷。

监管压力也在不断增加。随着AI智能体系统开始直接影响客户的决策,问责制、审计性和合规性问题变得迫在眉睫。那些现在不考虑治理的团队,在法规跟上时将会遇到痛苦的阻碍。

最终思考

AI智能体确实具有变革性,但从原型到大规模生产的道路上充满了行业仍在实时解决的挑战。

好消息是,生态系统正在迅速成熟。更好的工具、更清晰的模式以及早期采用者通过艰苦获得的经验教训,正在让这条道路每个月都变得更平坦一些。

如果你现在正在扩展AI智能体系统,请知道你正在经历的痛苦是普遍的。那些早期投资解决这些基础问题的团队,将能够构建在关键时刻真正能够支持系统的产品。

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区