📢 转载信息

原文链接:https://www.kdnuggets.com/run-a-real-time-speech-to-speech-ai-model-locally

原文作者:Abid Ali Awan

如何在本地运行实时语音转语音 AI 模型

在本指南中,您将学习如何一步步在本地安装和运行 PersonaPlex,以便在您自己的机器上体验实时的、可打断的语音转语音 AI。

作者:Abid Ali Awan,KDnuggets 助理编辑,发布于 2026 年 3 月 11 日,分类:人工智能

作者供图

介绍

在开始之前,我想让您观看这个视频:

这难道不令人惊叹吗?我的意思是,您现在可以在自己的机器上运行一个可以与您对话的完整本地模型,而且它开箱即用。它感觉就像在与真人交谈,因为系统可以同时监听和说话,就像自然的对话一样。

这不是通常的“您说话,然后它等待,然后它回复”的模式。PersonaPlex 是一个实时的语音转语音对话式 AI,它可以在您说话时处理打断、重叠以及像“嗯哼”或“好的”这样的自然对话提示。

PersonaPlex 被设计为全双工,因此它可以同时监听和生成语音,而无需强迫用户先暂停。与传统的语音助手相比,这使得对话感觉更加流畅和人性化。

在本教程中,我们将学习如何设置 Linux 环境,在本地安装 PersonaPlex,然后启动 PersonaPlex Web 服务器,以便您可以在浏览器中实时与 AI 进行交互。

在本地使用 PersonaPlex:分步指南

在本节中,我们将介绍如何在 Linux 上安装 PersonaPlex,启动实时 WebUI,并开始与运行在我们本地机器上的全双工语音转语音 AI 模型进行对话。

第一步:接受模型条款并生成令牌

在下载和运行 PersonaPlex 之前,您必须在 Hugging Face 上接受模型的使用条款。NVIDIA 的语音转语音模型 PersonaPlex-7B-v1 是受限制的,这意味着在您同意模型页面上的许可条件之前,您无法访问其权重。

前往 Hugging Face 上的 PersonaPlex 模型页面并登录。您会看到一条通知,说明您需要同意共享您的联系信息并接受许可条款才能访问文件。请阅读 NVIDIA 开放模型许可并接受条件以解锁该仓库。

授予访问权限后,创建一个 Hugging Face 访问令牌:

- 转到 设置 → 访问令牌

- 创建一个具有 读取 权限的新令牌

- 复制生成的令牌

然后在您的终端中导出它:

export HF_TOKEN="YOUR_HF_TOKEN"此令牌允许您的本地机器进行身份验证并下载 PersonaPlex 模型。

第二步:安装 Linux 依赖项

在安装 PersonaPlex 之前,您需要安装 Opus 音频编解码器开发库。PersonaPlex 依赖 Opus 来处理实时音频编码和解码,因此此依赖项必须在您的系统上可用。

在 Ubuntu 或基于 Debian 的系统上,运行:

sudo apt update sudo apt install -y libopus-dev第三步:从源代码构建 PersonaPlex

现在我们将克隆 PersonaPlex 仓库并从源代码安装所需的 Moshi 包。

克隆官方 NVIDIA 仓库:

git clone https://github.com/NVIDIA/personaplex.git cd personaplex进入项目目录后,安装 Moshi:

pip install moshi/.这将编译并安装 PersonaPlex 组件以及所有必需的依赖项,包括 PyTorch、CUDA 库、NCCL 和音频工具。

您应该会看到 torch、nvidia-cublas-cu12、nvidia-cudnn-cu12、sentencepiece 和 moshi-personaplex 等包成功安装。

提示:如果您使用的是自己的机器,请在虚拟环境中执行此操作。

第四步:启动 WebUI 服务器

在启动服务器之前,安装更快的 Hugging Face 下载器:

pip install hf_transfer现在启动 PersonaPlex 实时服务器:

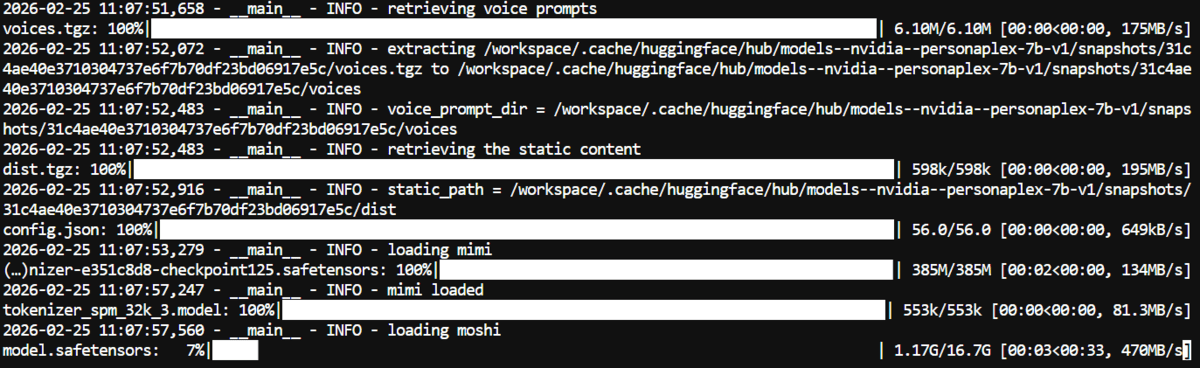

python -m moshi.server --host 0.0.0.0 --port 8998首次运行时将下载完整的 PersonaPlex 模型,大约为 16.7 GB。根据您的互联网速度,这可能需要一些时间。

下载完成后,模型将加载到内存中,服务器将启动。

第五步:在浏览器中与 PersonaPlex 对话

服务器运行后,就可以真正与 PersonaPlex 对话了。

如果您是在本地机器上运行此程序,请将此链接复制并粘贴到您的浏览器中:http://localhost:8998。

这将在浏览器中加载 WebUI 界面。

页面打开后:

- 选择一个声音

- 点击 连接

- 允许麦克风权限

- 开始说话

该界面包含对话模板。在此演示中,我们选择了 宇航员 (趣味) 模板,以使交互更加有趣。您还可以通过编辑初始系统提示文本来创建自己的模板。这允许您完全自定义 AI 的个性和行为。

对于声音选择,我们从默认设置切换并选择了 自然 F3,只是为了尝试一些不同的东西。

说实话,感觉非常自然。

您可以在它说话时打断它。

您可以提出后续问题。

您可以在句子中间改变话题。

它能流畅地处理对话流程,并实时智能地响应。我甚至通过模拟银行客户服务电话进行了测试,体验感觉很逼真。

PersonaPlex 包含多种声音预设:

- 自然 (女):NATF0, NATF1, NATF2, NATF3

- 自然 (男):NATM0, NATM1, NATM2, NATM3

- 多样 (女):VARF0, VARF1, VARF2, VARF3, VARF4

- 多样 (男):VARM0, VARM1, VARM2, VARM3, VARM4

您可以尝试不同的声音来匹配您想要的个性。有些声音听起来更具对话性,有些则更具表现力。

结论

在完成了整个设置过程并实际与 PersonaPlex 进行实时对话后,有一点变得非常清楚。

这感觉不一样。

我们习惯了基于聊天的 AI。您输入。它回复。您等待轮到您。感觉像是交易。

语音转语音彻底改变了这种动态。

通过在本地运行 PersonaPlex,您不再需要等待轮到您。您可以打断它。您可以在句子中间改变方向。您可以自然地提出后续问题。对话流畅。感觉更接近人类实际的交流方式。

这就是为什么我真诚地相信 AI 的未来是语音转语音。

但这还只是故事的一半。

真正的转变将发生在当这些实时对话系统与代理和工具深度连接时。想象一下对您的 AI 说:“给我订一张周五早上的机票。”查看股票价格并进行交易。写那封邮件并发出去。安排会议。拉取报告。

无需切换标签页。无需复制粘贴。无需输入命令。

只是交谈。

PersonaPlex 已经解决了最困难的问题之一,即自然、全双工的对话。下一层是执行。一旦语音转语音系统连接到 API、自动化工具、浏览器、交易平台和生产力应用程序,它们就不再仅仅是助手,而是开始成为操作员。

简而言之,它变成了某种程度上“超级充电”的 OpenClaw。

一个不仅像人一样交谈,而且能实时代表您采取行动的系统。

Abid Ali Awan (@1abidaliawan) 是一位认证的数据科学家,热爱构建机器学习模型。目前,他专注于内容创作,撰写关于机器学习和数据科学技术的技术博客。Abid 拥有技术管理硕士学位和电信工程学士学位。他的愿景是利用图神经网络为有心理健康困扰的学生构建一个 AI 产品。

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区