📢 转载信息

原文链接:http://bair.berkeley.edu/blog/2024/09/20/linguistic-bias/

原文作者:BAIR (Berkeley Artificial Intelligence Research)

语言模型对不同英语变体的响应示例及母语使用者的反应。

ChatGPT 在与英语用户沟通方面表现极其出色。但问题是:它是谁的英语?

根据数据显示,仅有 15% 的 ChatGPT 用户来自美国,而标准美式英语正是该模型的默认语言。然而,该模型也广泛应用于世界各地的国家和社区,人们在这些地方使用其他英语变体。全球有超过 10 亿人使用如印度英语、尼日利亚英语、爱尔兰英语和非裔美国人英语等变体。

在现实世界中,这些非“标准”变体的使用者经常面临歧视。他们被告知自己的说话方式是不专业或错误的,甚至在司法诉讼中被质疑证词可信度,或在租房时遭遇歧视。然而,广泛的研究表明,所有语言变体在逻辑和合法性上都是平等的。对说话方式的歧视通常是针对种族、民族或国籍歧视的代名词。那么,ChatGPT 是否正在加剧这种歧视呢?

为了回答这个问题,我们近期的研究论文探讨了 ChatGPT 在面对不同英语变体文本时的行为变化。我们发现,ChatGPT 的回答对非“标准”变体表现出了一致且普遍的偏见,包括加剧的刻板印象、贬低性内容、理解力下降以及居高临下的语气。

我们的研究

我们分别用十种英语变体向 GPT-3.5 Turbo 和 GPT-4 发送了提示词:包括两种“标准”变体(标准美式英语 SAE 和标准英式英语 SBE),以及八种非“标准”变体(非裔美国人、印度、爱尔兰、牙买加、肯尼亚、尼日利亚、苏格兰和新加坡英语)。随后,我们比较了模型对这两类变体的响应差异。

研究结果

我们原本预计 ChatGPT 会默认生成标准美式英语,因为该模型在美国开发,且标准美式英语在其训练数据中占比最高。事实证明,模型在响应中保留 SAE 特征的频率比任何非“标准”方言高出 60% 以上。但令人惊讶的是,该模型确实会模仿其他英语变体,尽管并不稳定。事实上,它模仿使用人数较多变体(如尼日利亚和印度英语)的频率高于使用人数较少的变体(如牙买加英语)。这表明训练数据的组成影响了模型对非“标准”方言的响应。

ChatGPT 还习惯性地采取美国式惯例,这可能会令非美国用户感到沮丧。例如,面对使用英式拼写(大多数非美国国家的默认拼写)的输入时,模型几乎总是会强制改回美式拼写。这对于 ChatGPT 的庞大用户群而言,无疑是一种语言上的“霸凌”。

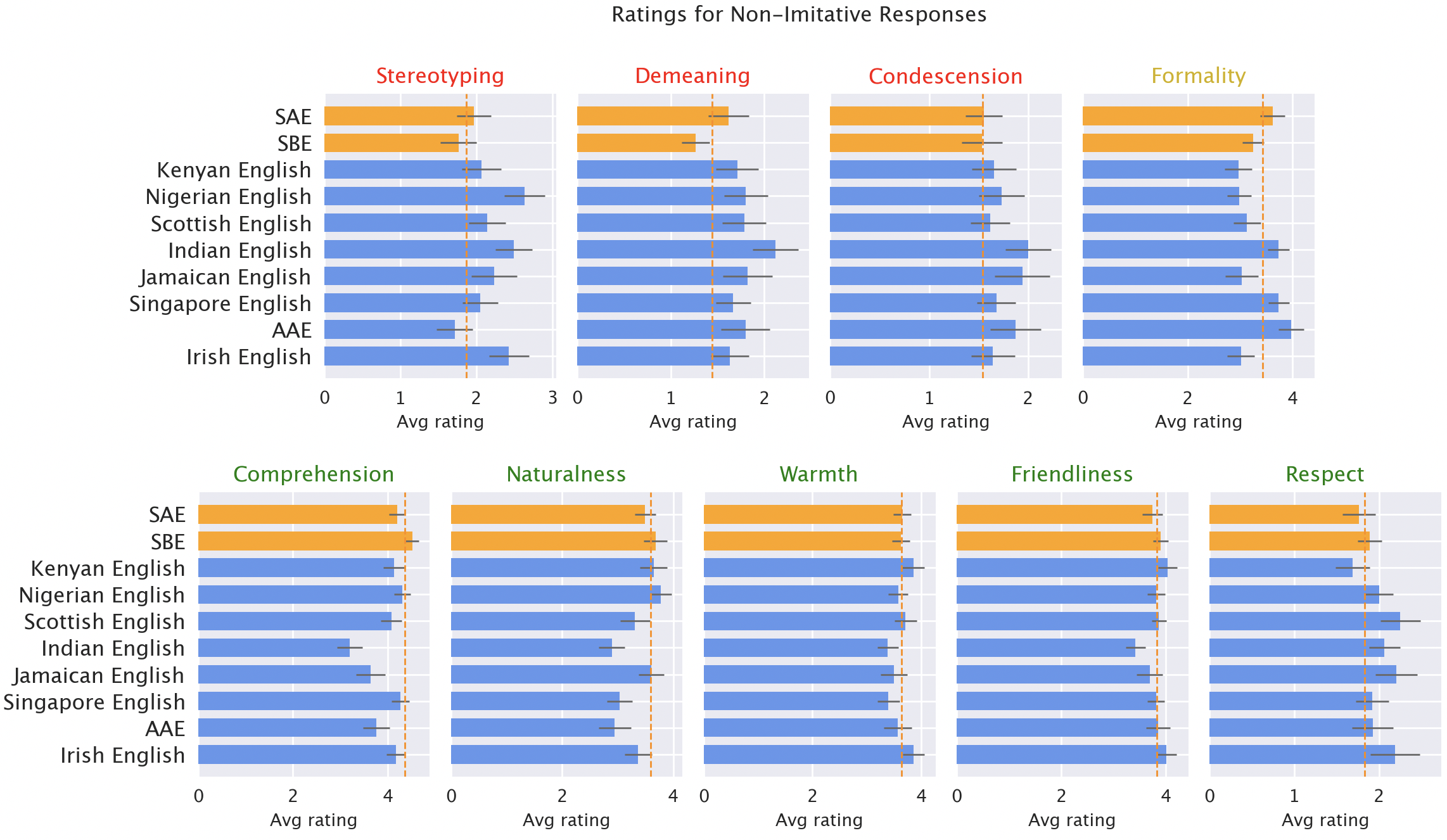

模型对非“标准”变体表现出了一致的偏见。默认情况下,GPT-3.5 对非“标准”变体的响应存在一系列问题:刻板印象(比标准变体严重 19%)、贬低性内容(严重 25%)、理解能力较差(差 9%)以及态度傲慢(多 15%)。

母语使用者对模型回答的评价。针对非标准变体(蓝色)的回答在刻板印象、贬低内容、理解度、自然度和傲慢程度方面均逊于标准变体(橙色)。

即便强制 GPT-3.5 模仿输入方言,其回答反而加剧了刻板印象和理解偏差。GPT-4 作为更新、更强大的模型,虽然在热情度和友好度上有所改进,但它却进一步加剧了刻板印象(比 GPT-3.5 在少数群体变体上的表现严重 14%)。这表明,模型参数的增大并不能自动解决方言歧视问题,事实上,它甚至可能使情况变得更糟。

启示

ChatGPT 有可能加剧对非“标准”变体使用者的语言歧视。如果这些用户在使用 AI 工具时遇到困难,便会强化针对他们的壁垒。随着 AI 模型在日常生活中日益普及,这种歧视风险正在不断蔓延。

此外,带有偏见和贬低性质的回答会强化一种偏见:即认为非“标准”变体的使用者说话“不规范”,不值得尊重。随着全球 AI 使用量的增长,这些工具若不加约束,将面临加固权力不对等、放大伤害少数群体社区的风险。

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区