📢 转载信息

原文链接:https://www.kdnuggets.com/context-engineering-is-the-new-prompt-engineering

原文作者:Nahla Davies

Image by Editor

# 引言

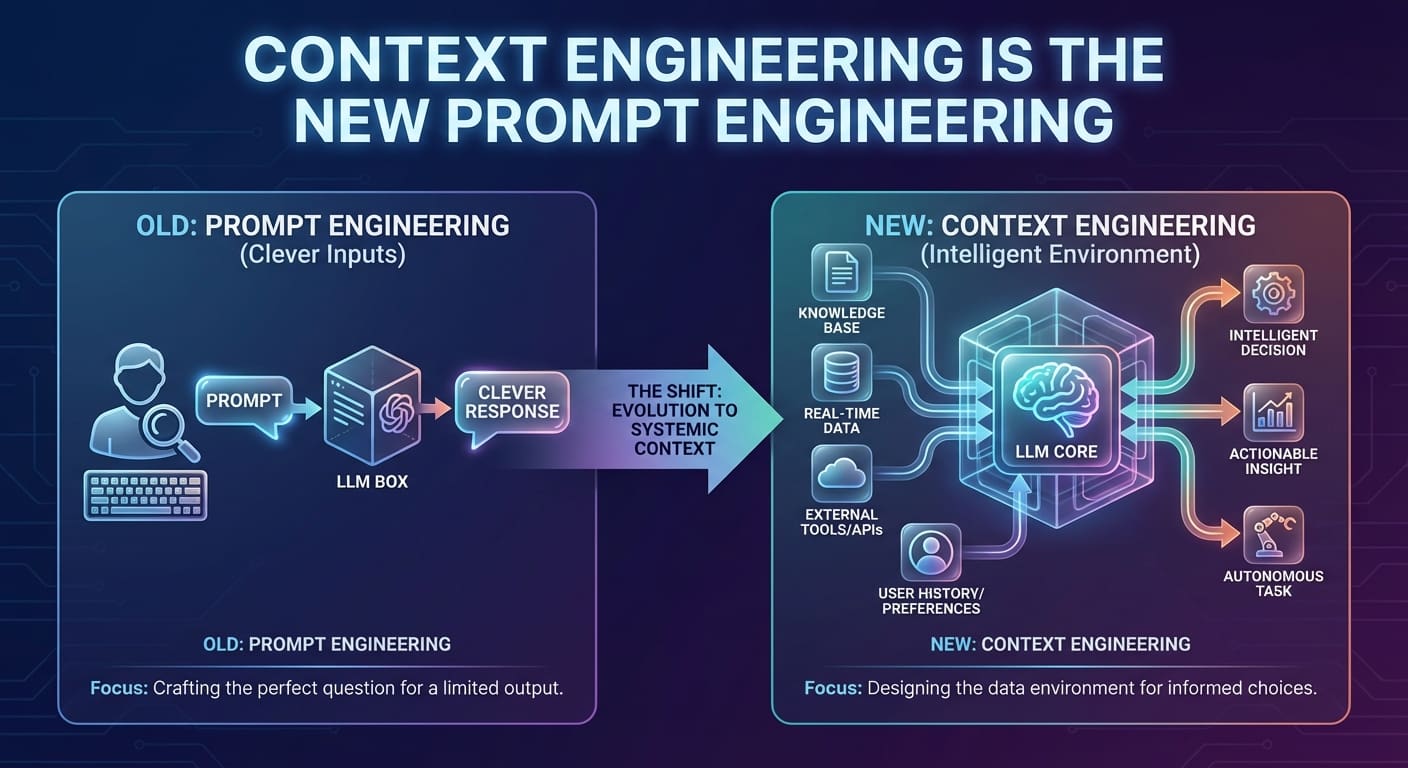

每个人都曾痴迷于构建完美的提示词——直到他们意识到提示词并非他们想象中的“魔法咒语”。真正的力量在于它们周围的环境:数据、元数据、记忆和叙事结构,这些赋予了AI系统连续性。

上下文工程正在取代提示词工程,成为新的控制前沿。它不再关乎巧妙的措辞。它关乎设计AI可以以深度、一致性和目的性进行思考的环境。

这种转变是微妙但却具有颠覆性的:我们正从提出明智的问题,转向为模型构建更智能的世界,让它们栖居其中。

# 提示词热潮的短暂生命

当ChatGPT首次兴起时,人们相信提示词的措辞可以解锁无限的创造力。工程师和影响者在领英上充斥着各种“神奇”模板,每一个都声称能破解模型的“大脑”。起初这很令人兴奋——但很快就结束了,我们意识到提示词工程从来就不是为了规模化而设计的。一旦用例从一次性聊天转向企业级工作流程,裂痕就显现出来了。

提示词依赖于语言的精确性,而非逻辑。它们是脆弱的。改变一个词或一个Token,系统的行为就会不同。在小型实验中,这没关系。但在生产环境中?那就是一场混乱。

企业了解到,除非每次都“喂”给模型上下文,否则模型就会遗忘、漂移并误解信息。于是,行业开始转变。工程师们不再不断地重新措辞提示词,而是开始构建能够通过记忆、元数据和结构来维持意义的框架。因此,上下文工程成为了粘合一致性的胶水。

提示词热潮的终结并没有扼杀创造力——它重新定义了创造力。撰写精美提示词的努力被转向了设计有弹性的环境。如今最聪明的AI工程师不再是提出更好的问题,而是为答案的涌现构建了更好的条件。

# 上下文才是真正的接口

每个模型的智能都受限于其上下文窗口——即它一次可以处理的文本或数据范围。这一限制催生了上下文工程这门学科。目标不是措辞出完美的请求,而是构建一个场景,使模型的推理过程保持稳定、准确和适应性。

精心构建的上下文表现得像无形的底层架构。它将逻辑联系在一起,提供参考,并将模型的推理锚定在可验证的数据上。检索增强生成(RAG)就是一个典型的例子:模型不再依赖于没有记忆的提示词,而是从策划好的知识库中即时拉取上下文。结果就是连续性——一个能记住重要信息并丢弃无关信息的AI。

在这个范式中,上下文成为接口。它是我们传达结构而非语法的方式。我们不是直接指示模型,而是在每次查询前,构建系统为模型预加载恰好合适的背景信息。未来AI的可靠性将不取决于花哨的措辞,而取决于能够使模型始终植根于相关信息的工程化上下文管道。

# 理解背后的架构

上下文工程就像是认知领域的城市规划。它组织数据、记忆和逻辑,使模型能够在复杂的环境中导航而不会迷失方向。提示词工程关注语言的技巧,而上下文工程则专注于基础设施:嵌入(embeddings)、模式(schemas)和检索逻辑,这些构成了模型的“心理地图”。

精心设计的上下文是分层的。第一层构建持久的身份——用户是谁、他们想要什么以及模型应该如何表现。下一层注入从外部数据库或应用程序编程接口(API)中提取的相关、时效性知识。最后,瞬态层实时适应,根据对话方向进行更新。这些层构成了理解的架构。

这不再是文字游戏;这是信息编排。工程师们正在学习平衡简洁性和上下文饱和度,决定在不压垮模型的情况下应该暴露多少信息。一个产生幻觉的AI和一个能清晰推理的AI之间的区别,通常归结于一个设计选择:它的上下文是如何构建和维护的。

# 从命令模型到协作

提示词是一种基于命令的关系:人类告诉AI做什么。上下文工程将其转变为协作。目标不再是控制每一次响应,而是共同设计响应得以产生的框架。这是一种结构与自主性之间的舞蹈。

当上下文系统集成记忆、反馈和长期意图时,模型开始更像同事,而不是聊天机器人。想象一个AI能回忆起先前的编辑,理解你的风格模式,并相应地调整其推理。这就是通过上下文实现的协作。每一次互动都建立在上次的基础上,形成一个共享的心理工作空间。

这种协作层完全改变了我们对提示词的思考方式。我们不再是措辞命令,而是定义关系。上下文工程赋予AI连续性、同理心和目的性——这些是通过一次性的语言命令不可能实现的品质。

# 记忆成为新的提示词层

记忆的引入标志着提示词工程的真正终结。静态提示词在单次交互后就消亡了;记忆将AI交互转变为不断演变的故事。通过向量数据库和检索系统,模型现在可以保留经验、决策和错误,然后利用它们来完善未来的推理。

但这并不意味着无限的记忆。聪明的上下文工程师会策划选择性的回忆。他们设计机制来决定保留什么、压缩什么或忘记什么。

艺术在于平衡“新近性”与“相关性”,就像人类认知一样。一个记住所有事情的模型是嘈杂的;一个有策略地记忆的模型才是智能的。

# 上下文设计的兴起

上下文工程正在迅速从研究实验室扩展到更广的领域。在客户支持中,AI系统会引用先前的工单来保持同理心。在分析领域,数据模型学会回忆先前的摘要以保持一致性。在创意领域,像图像生成器这样的工具现在利用分层上下文来交付感觉上具有人为意图的作品。

上下文设计引入了一个新的反馈循环:上下文影响行为,行为重塑上下文。这是一个驱动适应性的动态周期。系统会随着每一次输入而演化。这种转变需要新的设计思维——AI产品必须被视为活的生态系统,而非静态工具。工程师正在成为连续性的策展人。

很快,每一个严肃的AI工作流程都将依赖于工程化的上下文层。那些忽视这一转变的人会发现他们的输出是脆弱且不一致的。而那些拥抱它的人将创造出随着时间推移变得更智能、更一致、更具弹性的系统。

# 结论

提示词工程教会了我们如何与机器对话。上下文工程则教会我们如何构建它们思考的世界。AI设计的下一个前沿在于记忆、连续性和适应性结构。未来十年内,每一个强大的系统都将建立在连贯的上下文之上,而不是巧妙的措辞。

提示词时代正在结束。环境时代已经开始。那些学会工程化上下文的人不仅会获得更好的输出——他们将创造出真正理解的模型。这不是自动化。这是协同智能。

Nahla Davies是一位软件开发人员和技术作家。在全职从事技术写作之前,她曾从事过许多有趣的工作,包括在一家Inc. 5,000体验式品牌组织担任首席程序员,该组织的客户包括三星、时代华纳、Netflix和索尼。

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区