📢 转载信息

原文链接:https://www.kdnuggets.com/ai-music-generation-goes-consumer-with-googles-musicfx-dj

原文作者:Shittu Olumide

AI音乐生成走向消费级:谷歌推出MusicFX DJ

谷歌的MusicFX DJ将AI音乐生成转变为一种交互式、消费者友好的体验,能够根据文本提示实时创作音乐。

图片由作者提供

#

引言

多年来,人工智能音乐生成一直是一个复杂的研 Google's MusicFX DJ,一个将文本提示实时转化为连续、可控音乐流的网络应用。在本文中,我们将从技术角度审视MusicFX DJ,探讨其面向用户的特性、驱动它的技术以及它对数据科学领域的意义。

#

什么是MusicFX DJ?

MusicFX DJ是Google DeepMind与Google Labs合作开发的一款实验性网络应用。它标志着从单一输出的人工智能音乐生成器向交互式、面向表演的体验的重大转变。该工具设计得非常易于访问,无需任何音乐理论知识或数字音频工作站(DAW)的专业技能。

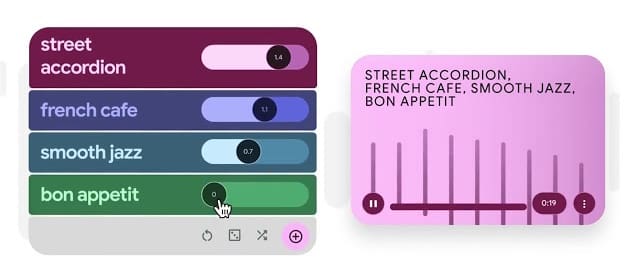

MusicFX DJ的核心功能类似于一个生成式混音台。用户可以同时输入多个文本提示,如“放克贝斯线”、“空灵的合成器铺垫”和“动感的嘻哈节拍”,并将它们分层播放。该界面提供了实时推子式控件,用于调整如“强度”、“混乱度”和“密度”等参数,允许用户在音乐播放时对其进行塑造。这种实时交互性和高品质的48 kHz立体声音频输出,使其区别于早期的静态生成工具。

AI音乐生成走向消费级:谷歌推出MusicFX DJ

#

节拍背后的技术:Lyria和实时扩散

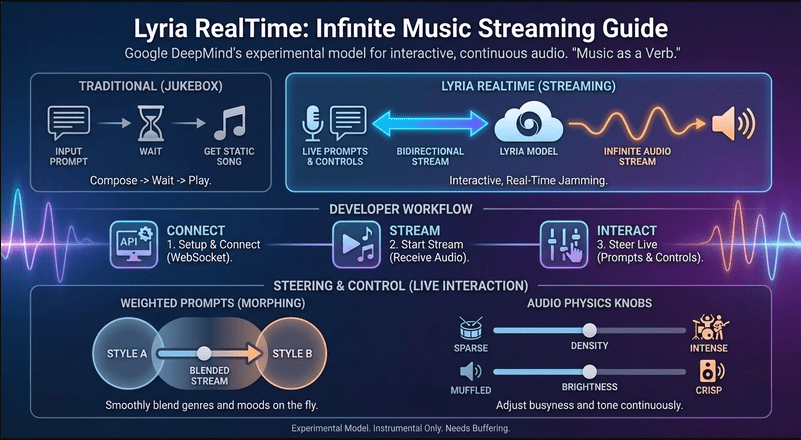

虽然谷歌尚未发布MusicFX DJ的具体模型白皮书,但众所周知,它由Lyria系列模型驱动,特别是Lyria RealTime。了解Lyria是理解该工具功能特性的关键。

Lyria是Google DeepMind最先进的音乐生成模型,基于扩散模型构建,该模型已成为高保真音频和图像生成的主流模型。以下是这项技术在MusicFX DJ中可能如何工作的简化说明:

- 训练过程:模型在一个包含海量音乐音频及其书面解释的数据集上进行训练。它学习将音频波形的模式—旋律、和声、音色、节奏—与文本中的语义概念关联起来。

- 扩散过程:扩散模型不是一步生成音乐,而是通过一个持续改进的过程来工作。它以纯噪声(静态)开始,然后通过许多步骤逐步“去噪”,将其转化为与输入文本提示匹配的连贯音乐。

- 实时适应(Lyria RealTime):标准的Lyria模型可以根据提示生成完整的片段。Lyria RealTime修改了这一过程以支持流式传输。它很可能生成短的、重叠的音频片段,形成一个连续的循环,同时一个独立的控制过程根据用户的实时输入(改变提示、滑块)动态调整生成参数。这使得无缝过渡和实时混音成为可能。

- 条件和控制:MusicFX DJ分层功能的“魔力”来自于条件生成。模型不只基于一个提示,而是基于多个提示的加权组合。当你调整“放克贝斯线”的推子时,你就是在调整该条件在模型生成过程中的权重,从而使其在输出音频流中更为主导或不那么主导。

Lyria和实时扩散

这种结构解释了该工具的专业级音频质量及其独特的交互式感觉;它不仅仅是播放预制片段,而是在响应你的指令时实时生成音乐。

#

MusicFX DJ的工作原理

使用MusicFX DJ的感觉更像是指挥一支乐队或进行DJ表演,而不是编程AI。其工作流程直观:

- 提示分层:第一步是将最多十个不同的文本提示添加到单独的音轨中。

- 实时生成:开始后,该工具立即开始生成一段连续的音乐,其中包含所有活动提示的元素。

- 交互式混音:每个提示音轨都有自己的音量推子和专用控件(例如,“混乱度”用于增加不可预测性,“密度”用于填充声音)。实时调整这些控件可以在不中断流程的情况下改变音乐。

- 动态演化:音乐并非固定循环。机器学习模型会不断演化作曲,引入变化并确保其不会变得重复,同时尊重用户引导的提示和滑块位置。

这种设计理念降低了创意音乐探索的门槛,使其成为头脑风暴、原型歌曲创意或仅仅享受引导式音乐发现过程的强大工具。

#

对数据科学家和AI社区的影响

MusicFX DJ的推出不仅仅是一个酷炫的演示;它标志着应用AI的几个重要趋势。

- 复杂模型的消费化:这表明尖端研究(扩散模型、大规模音频训练)可以被包装成直观的应用。对于数据科学家来说,它凸显了用户体验(UX)设计和实时系统思维在将人工智能推向广大受众方面的重要性。

- 可实时控制的生成:从批处理推理转向实时交互式生成是一项重大的技术挑战。MusicFX DJ表明,对于像音频这样的高维数据,这现在是可行的。这为视频、3D设计及其他领域的类似交互式人工智能铺平了道路。

- API和能力去中心化:谷歌已通过API(最初通过Gemini API和AI Studio)提供了基础的Lyria RealTime模型。这使得开发者和数据科学家能够在此强大的音乐生成引擎之上构建自己的应用程序,从而鼓励在游戏、内容创作和交互式媒体领域的创新。

- 伦理和创意考量:该工具还将紧迫的问题推到了舞台中央。训练数据集是如何收集和组织的?AI生成音乐的版权含义是什么?我们如何确保艺术家获得报酬?通过与Jacob Collier等音乐家合作开发,谷歌突出了一条人工智能增强而非取代人类创造力的道路。

#

结论

谷歌的MusicFX DJ是一款里程碑式的应用,它成功地弥合了先进的人工智能研究与消费者友好的创意之间的差距。通过使用Lyria RealTime扩散模型,它提供了一种独特的、交互式的音乐生成体验,既强大又有趣。

对于数据科学家来说,这是一个关于实时人工智能系统设计、模型条件化以及生成技术商业化的引人注目的案例研究。随着底层模型通过API变得可用,我们可以期待一系列新的应用程序出现,进一步模糊人类和机器辅助艺术之间的界限。交互式生成媒体的时代并非遥不可及,它已然到来,而MusicFX DJ这样的工具正在引领潮流。

//

参考文献- MusicFX Labs 页面

- DeepMind

- Jacob Collier & Google's Musical Brainstorming AI

- 新的生成式AI工具开启音乐创作之门

- DeepMind关于Lyria和Lyria RealTime的页面

Shittu Olumide是一位软件工程师和技术作家,热衷于利用尖端技术创作引人入胜的故事,注重细节并擅长简化复杂概念。你也可以在Twitter上找到Shittu。

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区