📢 转载信息

原文作者:Pavan Kumar Rao Navule, Sudhanshu Hate, Jared Dean, Melanie Li, and Saurabh Trikande

生成式 AI 推理的采用和实施随着组织在生产中大规模构建更多使用 AI 功能的运营工作负载而不断增加。为了帮助客户扩展其生成式 AI 应用的规模,Amazon Bedrock 提供了跨区域推理 (CRIS) 配置。CRIS 是一项强大的功能,组织可以利用它在多个 AWS 区域无缝地分发推理处理。此功能可帮助您在规模化构建时获得更高的吞吐量,并在重负载下保持生成式 AI 应用的响应能力和可靠性。

我们很高兴地推出 Amazon Bedrock 的全球跨区域推理,并将 Anthropic Claude 模型引入印度。Amazon Bedrock 现在通过 Amazon Bedrock 全球跨区域推理 (CRIS) 为在印度运营的客户提供 Anthropic 的 Claude Opus 4.6、Claude Sonnet 4.6 和 Claude Haiku 4.5。这些前沿模型提供高达 100 万个 token 的上下文窗口和先进的智能体功能,使您的应用程序能够以前所未有的速度和智能处理海量数据集和复杂工作流。通过此次发布,使用 ap-south-1 (孟买) 和 ap-south-2 (海得拉巴) 的客户可以在 Amazon Bedrock 上访问 Anthropic 的最新 Claude 模型,同时受益于 Amazon Bedrock 管理的全球推理容量和高可用性推理。通过全球 CRIS,客户可以无缝扩展推理工作负载,提高弹性,并降低运营复杂性。在本博文中,您将了解如何使用 Amazon Bedrock 的全球跨区域推理功能来处理印度的 Claude 模型。我们将指导您了解每个 Claude 模型变体的功能,以及如何通过代码示例立即开始构建生成式 AI 应用。

全球跨区域推理的核心功能

全球跨区域推理通过使用全球范围内的推理容量计算资源,帮助组织管理计划外的流量高峰(商业 AWS 区域(非 AWS GovCloud (US) 区域和中国区域))。本节将探讨 Global cross-Region inference 功能如何工作以及为其功能提供支持的技术机制。

了解推理配置

Global cross-Region inference 通过推理配置提供。推理配置基于两个关键概念:

- 源区域 – API 请求发起的区域

- 目标区域 – Amazon Bedrock 可以将请求路由到该区域进行推理

要使用 Anthropic 模型,Amazon Bedrock 会提供开箱即用的全球推理配置。例如:

- Opus 4.6:

<global.anthropic.claude-opus-4-6-v1> - Sonnet 4.6:

<global.anthropic.claude-sonnet-4-6> - Opus 4.5:

<global.anthropic.claude-opus-4-5-20251101-v1:0> - Sonnet 4.5:

<global.anthropic.claude-sonnet-4-5-20250929-v1:0> - Haiku 4.5:

<global.anthropic.claude-haiku-4-5-20251001-v1:0>

对于在印度使用 BOM (ap-south-1) 和 HYD (ap-south-2) 的客户,源区域和目标区域将如下所示:

- 源 -> 目标

- BOM (

ap-south-1) -> AWS 商业区域 - HYD (

ap-south-2) -> AWS 商业区域

- BOM (

有关选择地理位置和全球跨区域推理之间注意事项的信息,请参阅 Amazon Bedrock 用户指南中的选择地理位置和全球跨区域推理。

实施全球跨区域推理

截至今天,您可以为以下模型实施全球 CRIS。

| 名称 | 模型 | 推理配置 ID | 推理处理目标区域 |

| Global Anthropic Claude Opus 4.6 | Claude Opus 4.6 | global.anthropic.claude-opus-4-6-v1 |

商业 AWS 区域 |

| Global Anthropic Claude Sonnet 4.6 | Claude Sonnet 4.6 | global.anthropic.claude-sonnet-4-6 |

商业 AWS 区域 |

| Global Anthropic Claude Haiku 4.5 | Claude Haiku 4.5 | global.anthropic.claude-haiku-4-5-20251001-v1:0 |

商业 AWS 区域 |

| Global Claude Sonnet 4.5 | Claude Sonnet 4.5 | global.anthropic.claude-sonnet-4-5-20250929-v1:0 |

商业 AWS 区域 |

| GLOBAL Anthropic Claude Opus 4.5 | Claude Opus 4.5 | global.anthropic.claude-opus-4-5-20251101-v1:0 |

商业 AWS 区域 |

例如,要将全球跨区域推理与 Anthropic 的 Claude Opus 4.5 结合使用,您应完成以下关键步骤:

- 使用全局推理配置 ID – 在向 Amazon Bedrock 发出 API 调用时,指定全局 Anthropic Claude Opus 4.5 推理配置 ID (

global.anthropic.claude-opus-4-5-20251101-v1:0) 而不是特定于区域的模型 ID。这适用于InvokeModel、InvokeModelWithResponseStream以及Converse和ConverseStreamAPI。 - 配置 IAM 权限 – 要为用户启用全局跨区域推理,您必须将三部分 AWS Identity and Access Management 策略应用于角色。有关更多信息,请参阅配置全局跨区域推理的 IAM 策略。

印度高峰需求季节的全球跨区域推理

印度企业在流量高峰期面临独特的挑战。排灯节购物潮、杜塞拉电子商务高峰、开斋节庆典、圣诞节庆祝活动、报税截止日期、板球比赛以及客户参与度急剧上升的节日季。全球跨区域推理为印度客户提供了处理这些需求高峰而不会出现性能下降所需的吞吐量弹性。在这些高峰期,电子商务平台、金融科技应用程序和客户服务聊天机器人会经历 3-5 倍于正常流量的流量。通过全球 CRIS,您的应用程序会自动访问跨 AWS 商业区域的推理容量,从而帮助实现:

- 节日购物高峰期间的不间断服务 – 例如,在排灯节、开斋节、圣诞节和地区庆典期间,数百万客户同时与 AI 驱动的产品推荐和客户支持进行交互

- 无缝的税务季处理 – 处理 7 月至 9 月报税期间的文档分析、表格处理和合规性查询的激增

- 节日活动的营销扩展能力 – 在节日期间部署 AI 驱动的营销活动,无需进行容量规划

- 文化和体育赛事期间的业务连续性 – 在板球比赛、选举期间以及其他驱动大规模参与度高峰的活动期间保持性能

通过在全球范围内路由请求,印度客户可以访问更大的容量池——从区域每分钟 token (TPM) 限制转换为全球规模的吞吐量。这意味着,在您的业务最需要时,您的生成式 AI 应用仍能保持响应能力和可靠性,而无需手动进行多区域编排的运营复杂性,也无需承担面向客户的节流错误的风险。

在 Amazon Bedrock 上通过全球跨区域推理进行推理的入门分步指南:

有两种方法可以推理支持全局跨区域推理的模型。让我们详细了解这两种方法。

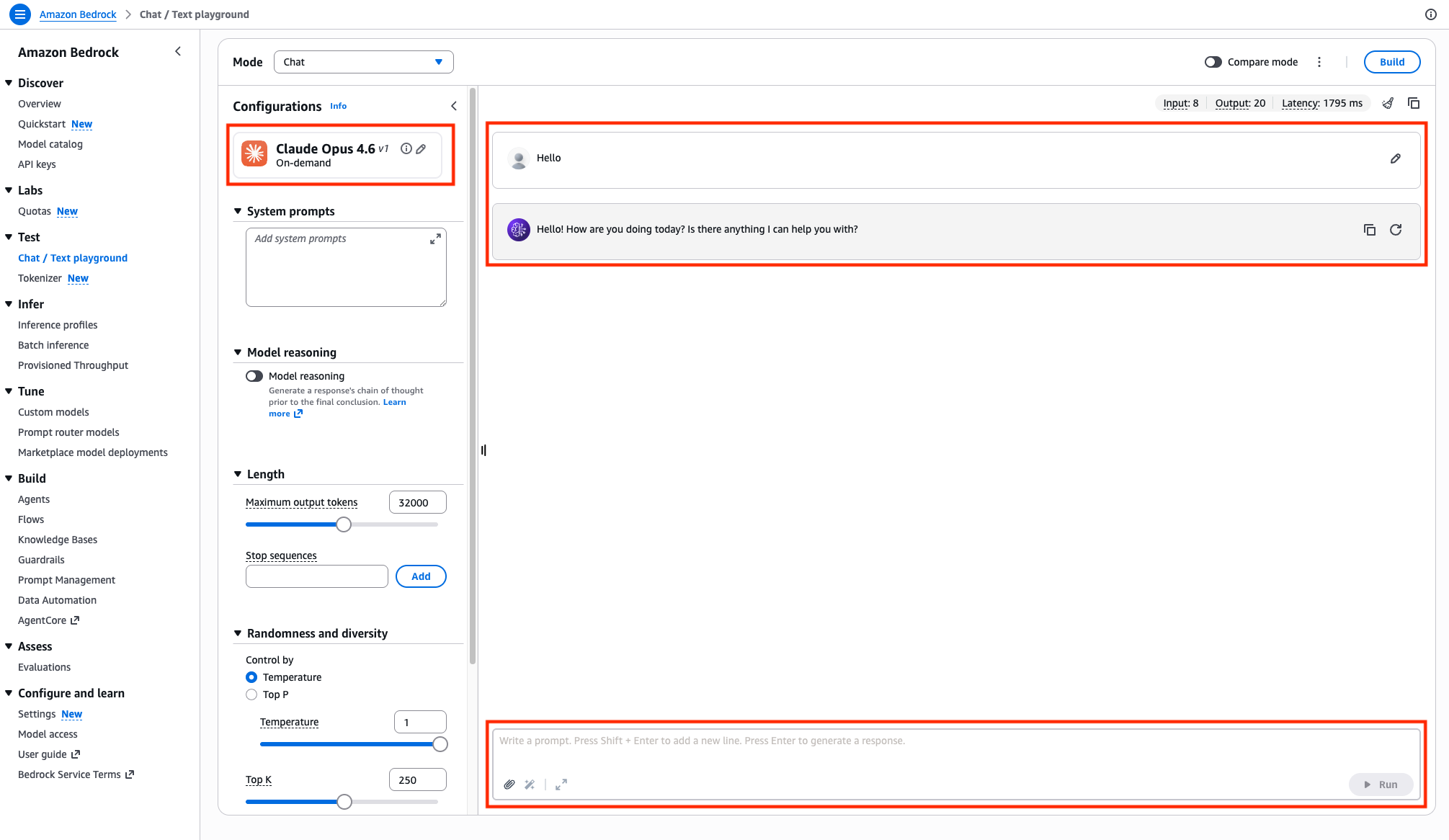

方法 1:在 Amazon Bedrock 控制台中使用 Amazon Bedrock Playground,在亚太地区(孟买)区域进行全球 CRIS 模型的推理

Amazon Bedrock Playground 提供了一个可视化界面,可用于通过使用不同的配置参数来试验不同的模型。您可以使用 Playground 通过试验提示来测试和比较不同的模型,然后再将它们集成到您的应用程序中。

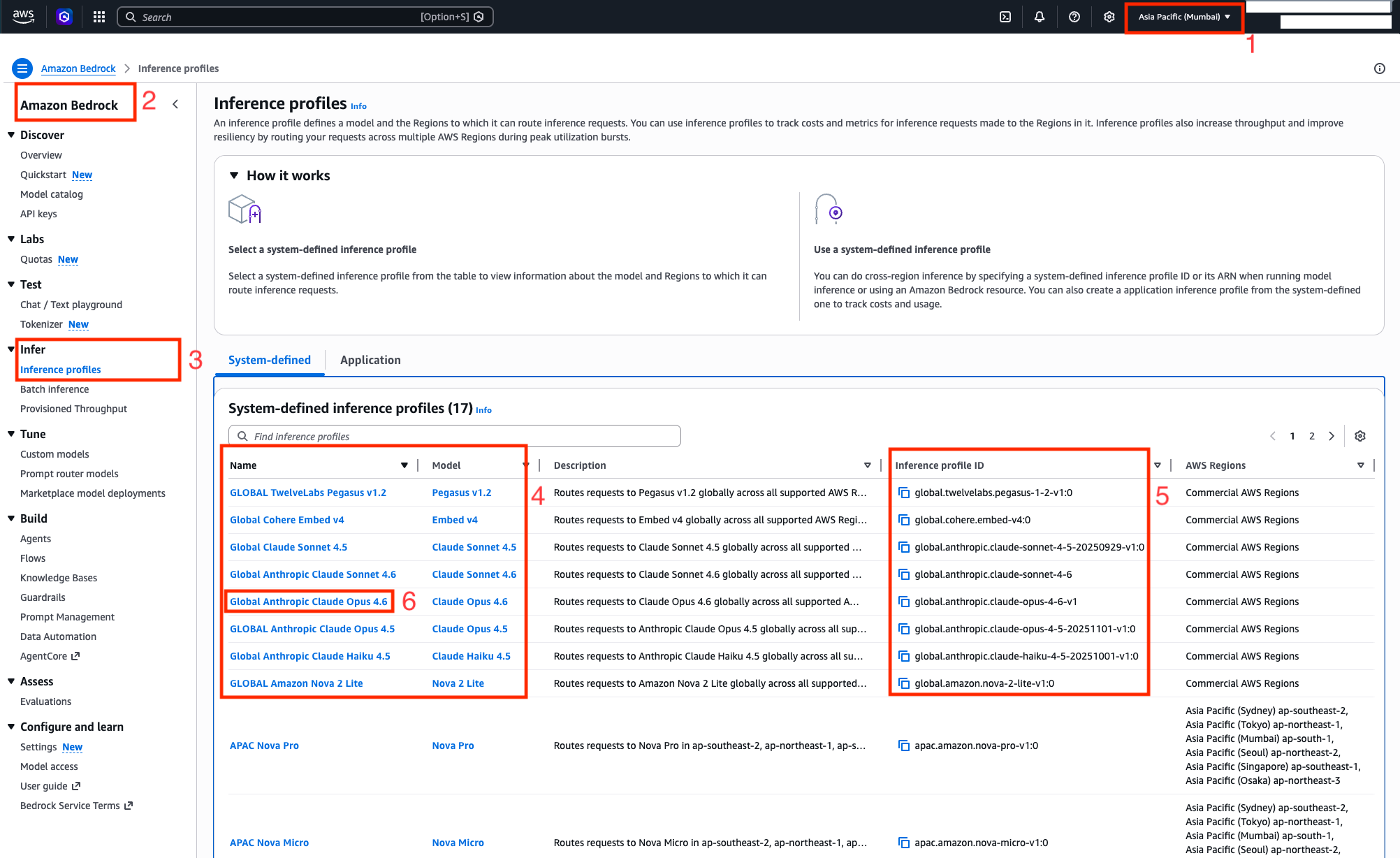

要开始使用 Playground,请完成以下步骤:

- 登录 AWS Console,然后选择亚太地区(孟买)区域。

- 导航到 Amazon Bedrock Console

- 在侧边导航菜单的“推理”下,选择“推理配置”。

- 全局推理配置将以关键字

global开头。 - 通过“系统定义的推理配置”表中的相应“推理配置 ID”列,获取通过全局 CRIS 调用模型的模型 ID。在撰写本文时,它支持 Anthropic Claude Opus 4.6、Claude Sonnet 4.6、Claude Haiku 4.5 以及其他基础模型。

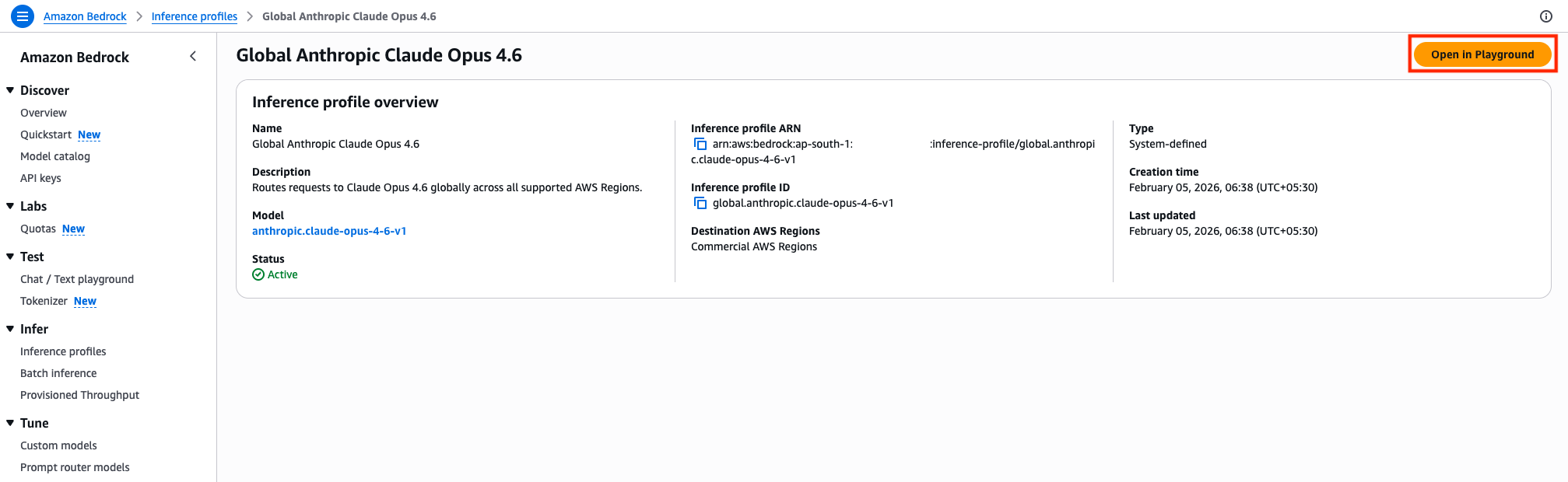

- 选择模型名称,例如,Global Anthropic Claude Opus 4.6,然后导航到将显示模型详细信息的屏幕。

- 查看上一步中选择模型的推理配置概述。要在聊天/文本 Playground 中执行推理,请选择控制台中的“在 Playground 中打开”按钮。

- 您可以通过尝试一些提示,在 Amazon Bedrock 聊天/文本 Playground 上开始推理模型

方法 2:以编程方式推理全局跨区域推理模型

要以编程方式调用全局模型,可以使用 InvokeModel、Converse API 进行实时请求,以及 InvokeModelWithResponseStream 和 ConverseStream API 进行流式处理工作负载。演示这些调用 API 的完整源代码可在 GitHub 存储库 aws-samples/sample-amazon-bedrock-global-cris 中找到。

使用 Converse API 通过全球跨区域推理调用 Anthropic Claude 模型

让我们通过 Converse API 来理解在 global.anthropic.claude-opus-4-6-v1 模型上实现全球跨区域推理。我们推荐使用 Converse API 进行对话式应用程序,它提供了一个统一的接口。

import boto3 # 初始化印度区域(孟买)的 Bedrock 客户端

bedrock = boto3.client("bedrock-runtime", region_name="ap-south-1") # Claude Opus 4.6 的全局 CRIS 模型 ID

MODEL_ID = "global.anthropic.claude-opus-4-6-v1"

try:

print("Invoking Claude Opus 4.6 via Global CRIS...")

# 使用 Converse API 进行简化交互

response = bedrock.converse(

messages=[

{

"role": "user",

"content": [{"text": "Explain cloud computing in 2 sentences."}]

}

],

modelId=MODEL_ID,

)

# 提取并显示响应

response_text = response["output"]["message"]["content"][0]["text"]

print("Response:", response_text)

# 显示 token 使用信息

usage = response.get("usage", {})

print("Tokens used:", usage)

if usage:

print(f"Input tokens: {usage.get('inputTokens', 'N/A')}")

print(f"Output tokens: {usage.get('outputTokens', 'N/A')}")

print(f"Total tokens: {usage.get('totalTokens', 'N/A')}")

except Exception as e:

print(f"Error: {e}")

print("Please check your AWS credentials and region configuration.")调用 Anthropic Claude 模型以及使用不同 API 类型的全球跨区域推理的代码示例

可以参考以下代码示例,用于全局 CRIS 模型的 InvokeModel、InvokeModelWithResponseStream 以及 Converse 和 ConverseStream API:

| 模型名称 | 推理配置 ID | 调用 API | GitHub 示例代码 |

| Global Anthropic Claude Opus 4.6 | global.anthropic.claude-opus-4-6-v1 |

Converse | Code |

| ConverseStream | Code | ||

| InvokeModel | Code, Advanced Usage | ||

| InvokeModelWithResponseStream | Code, Advanced Usage | ||

| Global Anthropic Claude Sonnet 4.6 | global.anthropic.claude-sonnet-4-6 |

Converse | Code |

| ConverseStream | Code | ||

| InvokeModel | Code | ||

| InvokeModelWithResponseStream | Code | ||

| Global Anthropic Claude Haiku 4.5 | global.anthropic.claude-haiku-4-5-20251001-v1:0 |

Converse | Code |

| ConverseStream | Code | ||

| InvokeModel | Code | ||

| InvokeModelWithResponseStream | Code | ||

| Global Claude Sonnet 4.5 | global.anthropic.claude-sonnet-4-5-20250929-v1:0 |

Converse | Code |

| ConverseStream | Code | ||

| InvokeModel | Code | ||

| InvokeModelWithResponseStream | Code | ||

| GLOBAL Anthropic Claude Opus 4.5 | global.anthropic.claude-opus-4-5-20251101-v1:0 |

Converse | Code |

| ConverseStream | Code | ||

| InvokeModel | Code | ||

| InvokeModelWithResponseStream | Code |

您还可以使用应用程序推理配置来处理全局 CRIS 模型。示例可在 GitHub 存储库 application-inference-profile/multi_tenant_inference_profile_example.py 中找到。您可以在“设置模型调用资源并使用推理配置”中了解有关跨区域(系统定义的)推理配置和应用程序推理配置的更多信息。

使用全球跨区域推理进行监控和日志记录

在使用全球跨区域推理时,Amazon CloudWatch 和 AWS CloudTrail 将继续仅在请求发起的源区域记录日志条目。这通过将记录保留在单个区域来简化监控和日志记录,无论推理请求最终在哪里处理。

到目前为止,我们已经学习了如何使用 InvokeModel、InvokeModelWithResponseStream 以及 Converse 和 ConverseStream API 调用支持全球跨区域推理的模型。我们还从这些 API 的响应中捕获了使用情况。接下来,我们将学习如何有效地捕获日志和指标,从而提高全局端点请求和响应的整体可观测性和可追溯性。我们将使用几个关键功能来构建仪表板:

- 模型调用日志记录,将日志推送到 CloudWatch Logs

- 生成式 AI 可观测性

- 查询 CloudTrail 事件数据存储以跟踪哪些目标区域执行了每个推理请求

这种分阶段的方法将帮助您了解如何设置和理解请求的处理位置,并帮助您有效监控模型性能。

阶段 1:CloudWatch 指标启用、图形报告快照

要获得对全局 CRIS 使用情况的全面可见性,您需要启用模型调用日志记录并设置监控仪表板。这将帮助您跟踪性能指标、token 使用情况,并确定哪些区域正在处理您的请求。

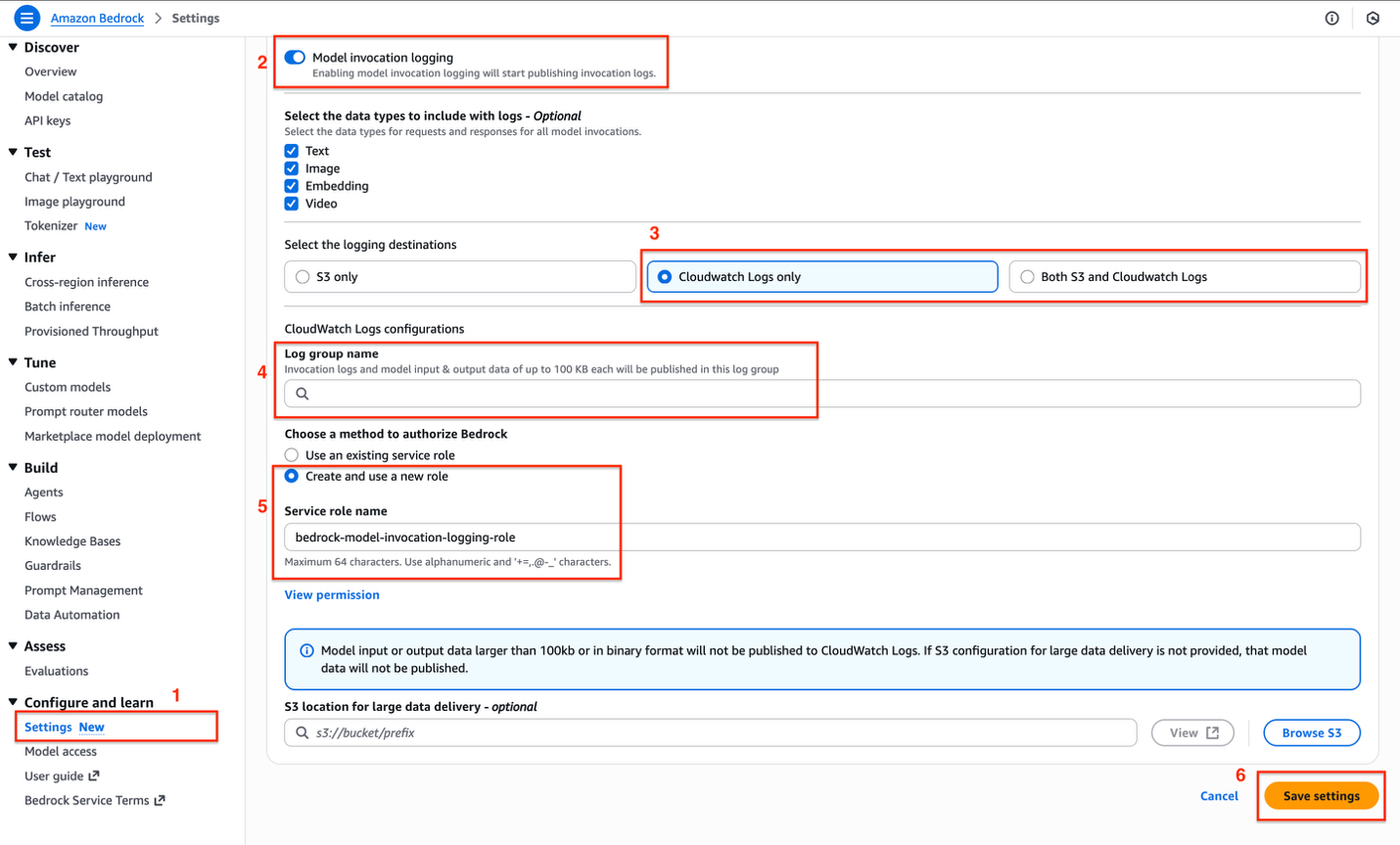

步骤 1:启用模型调用日志记录

要启用模型调用日志记录,请在 AWS 控制台中导航到 Amazon Bedrock 服务页面,并按所示执行以下操作。

- 在左侧出现的侧边导航中的“配置和学习”部分下,选择“设置”。切换“模型调用日志记录”的单选按钮。

- 在设置页面的顶部,切换“模型调用日志记录”。这将开始发布您的 Bedrock 模型使用的调用日志。

- 选择您希望存储日志的位置:

- 仅 S3 – 将日志存储在 Amazon Simple Storage Service (Amazon S3) 中

- 仅 CloudWatch Logs – 将日志存储在 CloudWatch 中(推荐给大多数用户)

- S3 和 CloudWatch Logs – 将日志存储在两个位置

- 选择“仅 CloudWatch Logs”或“S3 和 CloudWatch Logs”,因为我们必须可视化 CloudWatch Gen AI Dashboard。

- 如果选择了 CloudWatch 作为目标:

- 参考在 CloudWatch Logs 中创建日志组来创建日志组。

- 输入将发布调用日志的日志组名称。

请注意,最多 100 KB 的日志和模型输入/输出数据将存储在此组中。

- 在“选择授权 Bedrock 的方法”部分下,选择以下选项之一,以指示 Amazon Bedrock 如何获得写入日志的授权:

- 使用现有的服务角色 – 选择预先存在的 IAM 角色。

- 创建并使用新角色 – 让 AWS 自动创建新角色。

为简单起见,我们将选择创建并使用新角色。

- 选择“保存设置”以应用您的日志记录配置。

步骤 2:模型调用的生成式 AI 可观测性

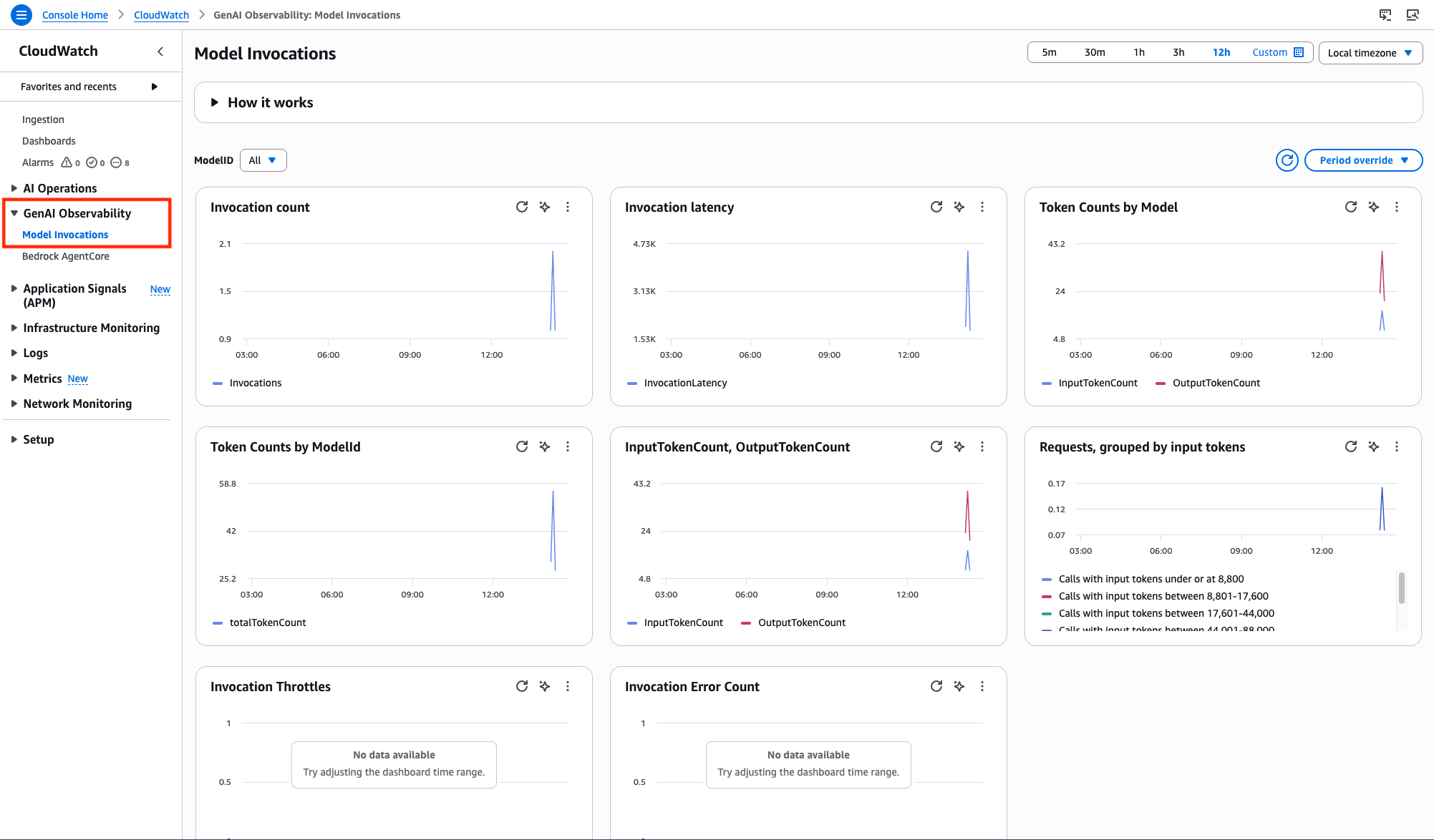

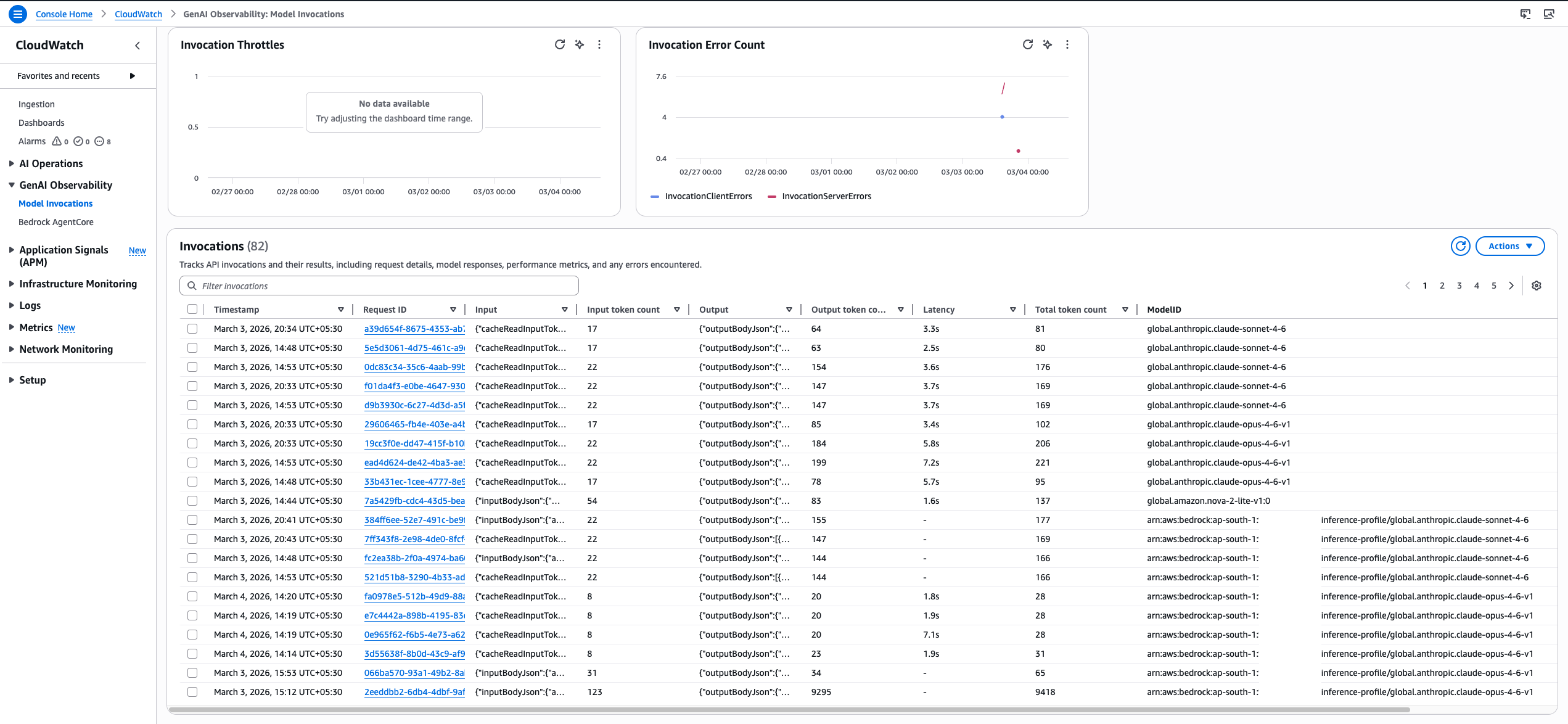

您可以使用 CloudWatch 生成式 AI 可观测性仪表板来监控模型调用性能。您可以使用开箱即用的视图跟踪调用计数、token 使用情况和错误等指标。我们已经启用了模型调用日志记录,因此我们将导航到 AWS 控制台中的 CloudWatch 服务页面,并在 Gen AI 可观测性下选择模型调用。

通过 Gen AI 可观测性,您可以全面了解 Gen AI 工作负载的性能,包括关键指标、端到端提示跟踪以及大型语言模型 (LLM) 交互的分步分析。您可以快速诊断问题,并实时了解整个 AI 堆栈的性能和可靠性。

阶段 2:使用 CloudTrail 进行 CRIS 的目标区域推理理解

要跟踪处理请求的区域,CloudTrail 事件包含一个 additionalEventData 字段,其中有一个 inferenceRegion 键,用于指定目标区域。组织可以监视和分析其推理请求在 AWS 全球基础设施中的分布情况。

步骤 1:在 CloudTrail 中创建事件数据存储

- 在 AWS...

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区