📢 转载信息

原文作者:Bhavya Sruthi Sode 和 David Rostcheck

如今,Amazon Bedrock 使定制 Amazon Nova 模型以满足特定业务需求变得非常简单。随着企业扩大 AI 部署规模,他们需要模型能够反映其专有知识和工作流——无论是保持品牌语气、处理复杂的行业流程,还是在高容量的航空预订系统中精确分类用户意图。提示词工程(Prompt Engineering)和检索增强生成(RAG)等技术能提供额外背景信息以提升性能,但它们无法将知识真正注入模型内部。

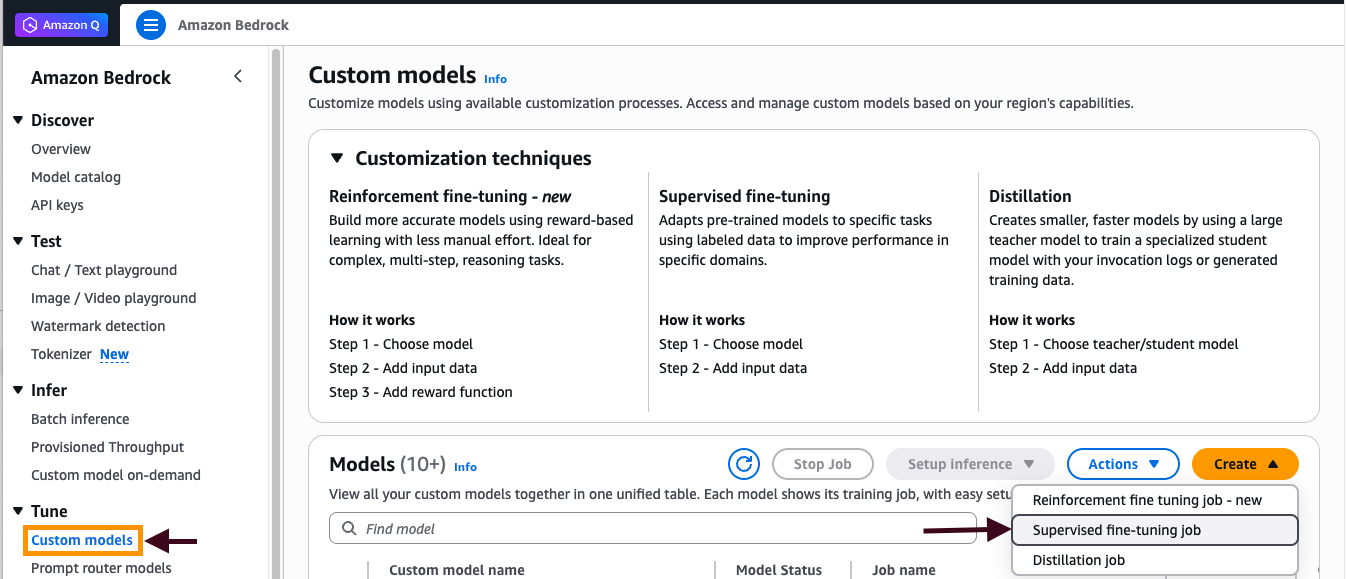

Amazon Bedrock 支持三种定制方案:监督微调(SFT)、强化微调(RFT)以及模型蒸馏。这些方法将新知识直接嵌入模型权重中。通过这些方案,您可以在处理关键业务任务时获得更快的推理速度、更低的 Token 成本和更高的准确率。Amazon Bedrock 会自动管理训练过程,无需深厚的机器学习专业知识。

理解微调及其适用场景

提示词工程或 RAG 将信息放入上下文窗口中。虽然它们响应即时且无需训练,但每次调用都会消耗 Token,从而增加长期成本和延迟,且模型难以处理超出提示词范围的推理任务。相比之下,微调通过向模型添加权重矩阵并进行训练,使模型获得了全新的领域特定技能。

何时进行微调:如果您拥有高容量且定义明确的任务,并能整理高质量的标记样本或构建奖励函数时,请考虑微调。例如,Amazon 客服部门通过微调 Nova Micro,在特定领域问题上的准确率提升了 5.4%。

Amazon Bedrock 的三种定制方案

- 监督微调 (SFT):使模型学习您提供的标记数据模式。

- 强化微调 (RFT):结合训练数据与奖励函数,引导模型学习目标行为。

- 模型蒸馏:将大模型(老师)的知识压缩进较小、更高效的学模型(学生)中,适用于资源受限的场景。

Amazon Bedrock 会自动使用参数高效微调(PEFT)技术,在保持高质量的同时降低内存需求并加速训练。

实战演练:意图检测

我们将使用开源的“航空公司旅行信息系统 (ATIS)”数据集对 Nova Micro 模型进行微调。原始模型在 ATIS 上的准确率为 41.4%,而通过简单的微调,其准确率提升至 97%。

数据准备关键点:Amazon Bedrock 要求使用 JSONL 格式。务必确保训练时使用的系统提示词(System Prompt)与推理时一致。同时,请注意对敏感数据进行匿名化处理。

超参数配置建议

epochCount:建议设为 1-5,对于中小规模数据集,3 次迭代通常能获得良好效果。learningRateMultiplier:控制学习速度,推荐起始值为 1e-5。learningRateWarmupSteps:用于平稳开启训练,默认值 10 即可。

监控与评估:通过 AWS 控制台的“自定义模型”看板,您可以实时监控训练状态并查看损失曲线(Loss Curve)。平滑下降的损失曲线是模型成功收敛的最佳标志;如果曲线剧烈波动,请尝试降低学习率。

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区