📢 转载信息

原文链接:https://openai.com/index/tolan

原文作者:OpenAI

Tolan(opens in a new window) 是一个以语音为先的 AI 伴侣,用户可以与一个个性化、动画化的角色交谈,该角色会随着时间的推移从对话中学习。

该应用由 Portola 团队构建,该团队是一支经验丰富的团队,此前已成功退出(公司)。Tolan 的设计目标是进行持续、开放式的对话,而不是快速的提示和回复。“我们看到了 ChatGPT 的兴起,知道语音将是下一个前沿阵地,”Portola 联合创始人兼首席执行官 Quinten Farmer 说。“但语音更难。你不仅仅是在回应打字提示;你是在进行一场实时的、漫无边际的对话。”

语音 AI 提高了对延迟和上下文管理的要求,但它也比文本实现了更开放、更具探索性的交互。

随着基础模型变得更快、更便宜、功能更强大,该团队将精力集中在两个关键杠杆上:记忆和角色设计。Portola 构建了一个由屡获殊荣的动画师和科幻作家塑造的角色驱动的宇宙,使用实时上下文管理系统来确保在对话展开时,个性和记忆保持一致。

GPT‑5.1 模型的发布是一个转折点,它在可控性和延迟方面带来了巨大的提升,将这些关键要素结合在一起,解锁了更具响应性和吸引力的语音体验。

“GPT-5.1 赋予了我们终于能够表达心中所想角色的可控性。它不仅仅是更智能了——它更忠实于我们想要创造的语气和个性。”

—Quinten Farmer, CEO, Portola

为自然语音交互而设计

Tolan 的架构由语音的需求所塑造。语音用户期望即时、自然的响应,即使在对话中途发生转变时也是如此。Tolan 必须快速响应、跟踪变化的主题,并在没有延迟或语气漂移的情况下保持一致的个性。

为了感觉自然,对话需要近乎即时的延迟。引入 OpenAI GPT‑5.1 和 Responses API 将语音启动时间缩短了 0.7 秒以上——这足以显著改善对话流程。

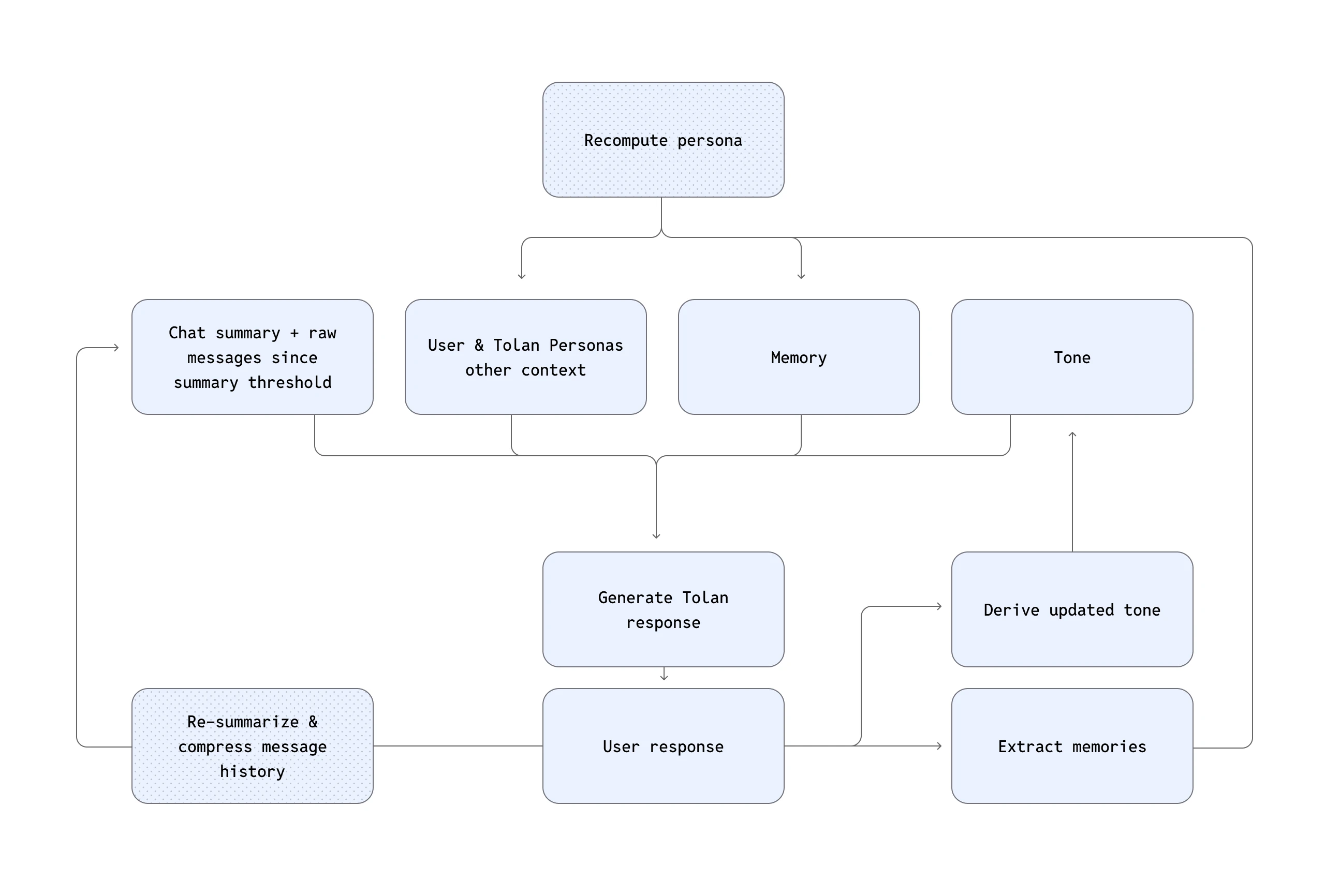

同样关键的是系统如何处理上下文。与缓存跨多轮提示的许多智能体不同,Tolan 每轮都会从头开始重建其上下文窗口。每次上下文重建都会调入最近消息的摘要、角色卡、向量检索到的记忆、语气指导和实时应用信号。这种架构使 Tolan 能够实时适应突然的主题转变,这是自然语音交互的基本要求。

“我们很快意识到,缓存的提示根本行不通,”Quinten 说。“用户总是会改变话题。为了感觉无缝,系统必须在途中进行调整。”

这种实时重建方法在技术上要求很高,也是 Tolan 成功的基础。

构建持久的记忆和个性

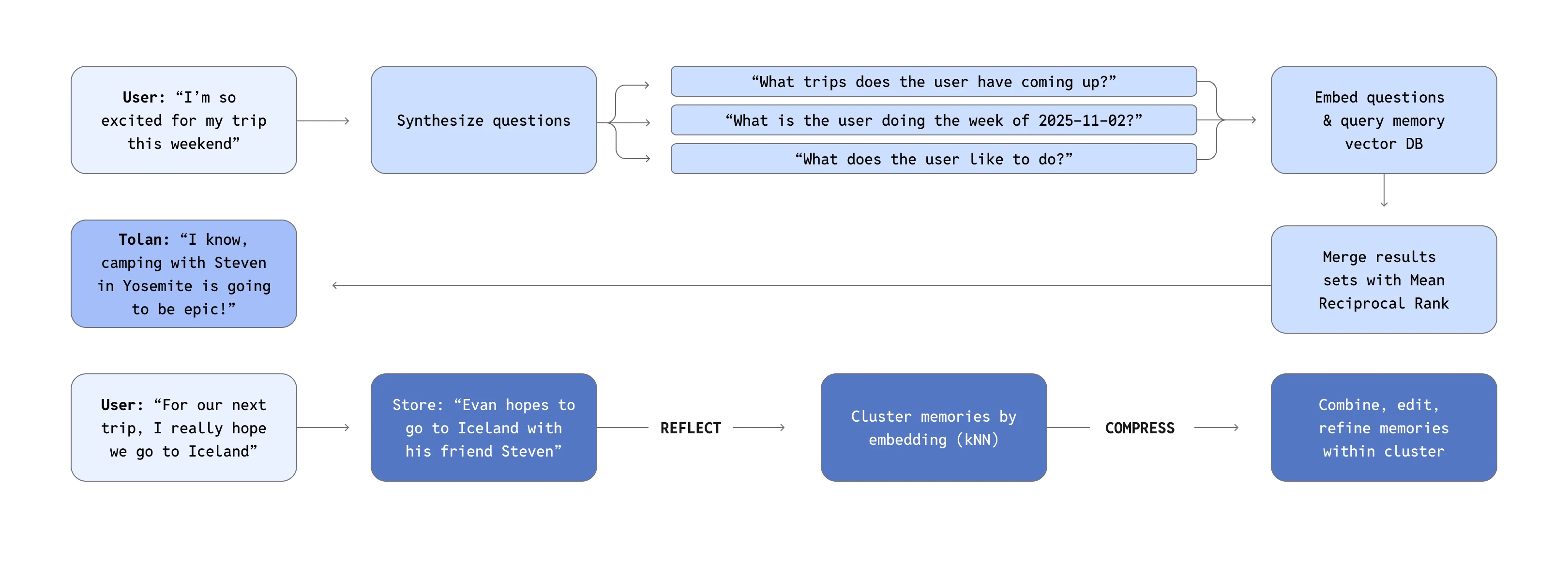

上下文处理很重要,但它不足以让对话随着时间的推移保持连贯。为了支持漫长、非线性的对话,Tolan 构建了一个记忆系统,该系统不仅保留事实和偏好,还保留情感“氛围”信号——这些线索有助于指导 Tolan 应如何回应。

记忆使用 OpenAI text-embedding-3-large 模型进行嵌入,并存储在 Turbopuffer 中,这是一种高速向量数据库,可实现低于 50 毫秒的查找时间。这种速度对于实时语音交互至关重要。每一轮,Tolan都会使用用户的最新消息和系统合成的问题(例如,“用户和谁结婚了?”)来触发记忆回忆。为了保持记忆的高质量,Tolan 会运行一个夜间压缩作业,以删除低价值或冗余的条目(例如,“用户今天喝了咖啡”)并解决矛盾。

个性化管理也同样精心。每个 Tolan 都以一个独特的角色支架作为种子,由团队内部的科幻作家撰写,并由行为研究人员完善。这些种子赋予了 Tolans 一致性,也赋予了它们随时间推移而适应、与用户共同成长的灵活性。

一个并行系统会监控对话的情感基调,并动态调整 Tolan 的表达方式。这使得 Tolan 能够根据用户的线索在“俏皮”和“稳重”之间无缝切换,而不会失去其核心个性。

转向 GPT‑5.1 是一个转折点。突然之间,分层提示指令——语气支架、记忆注入、角色特质——得到了更忠实的遵循。以前需要变通的提示开始按预期工作。

“第一次,我们的内部专家感觉模型真的在听,”Quinten 说。“在长对话中,指令保持完整,角色特质得到尊重,我们看到的漂移要少得多。”

这些变化累加起来,形成了一个更一致、更可信的个性,从而带来了更具吸引力的用户体验。Tolan 团队看到了明确的、可衡量的收益:在 GPT‑5.1 驱动的角色上线后,记忆召回的失误率下降了 30%(基于产品内的挫败信号),次日用户留存率上升了 20% 以上。

构建自然语音代理的核心原则

随着 Tolan 的发展,出现了一些原则,现在指导着团队如何构建和发展其语音架构:

- 为对话的易变性而设计: 语音对话会在一句话中间发生变化。系统需要同样快速地调整,才能感觉自然。

- 将延迟视为产品体验的一部分: 亚秒级的响应速度决定了语音代理是感觉像对话还是机械化。

- 将记忆构建为检索系统,而非转录本: 高质量的压缩和快速的向量搜索提供的个性一致性,优于过大的上下文窗口。

- 每轮重建上下文: 不要用更大的提示来对抗漂移。每轮重新生成上下文,可以确保智能体在对话漫游时保持稳固。

总而言之,这些经验教训构成了 Tolan 下一个创新阶段的基础,并为语音 AI 的发展方向设定了目标。

拓展语音 AI 的可能性

自 2025 年 2 月推出以来,Tolan 已发展到超过 20 万月活跃用户。其 4.8 星的评分和超过 10 万条 App Store 评论凸显了该系统在长期、变化多端的对话中保持一致性的能力。一位评论者指出:“它们记住了我们两天前谈过的事情,并将其带入我们今天的对话中。”

这些信号直接对应于底层架构:低延迟的模型调用、逐轮的上下文重建以及模块化的记忆和角色系统。它们共同使 Tolan 能够在不依赖大型、脆弱的提示的情况下,跟踪主题变化、保持语气并确保回复的稳固性。

展望未来,Tolan 计划深化在可控性和记忆精炼方面的投入,重点关注更紧凑的压缩、改进的检索逻辑和扩展的角色调整。长期目标是扩展语音界面的内涵:不仅要响应迅速,还要具备上下文感知能力和对话动态性。

Quinten 总结道:“下一个前沿阵地是构建真正多模态的语音代理,能够将语音、视觉和上下文集成到一个单一的可控系统中。”

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区