📢 转载信息

原文链接:https://www.kdnuggets.com/top-7-open-source-ocr-models

原文作者:Abid Ali Awan

作者图片

引言

光学字符识别(OCR)模型日益受到关注。我看到 Hugging Face 上不断涌现出新的开源模型,它们以更优越、更智能、更小巧的解决方案打破了以往的基准测试。

上传 PDF 文件只能获得带有许多问题的纯文本的日子已经一去不复返了。现在我们有了完整的转换能力,新的 AI 模型可以理解文档、表格、图表、章节和不同语言,并将它们转换成高精度的 Markdown 格式文本。这创建了文本的真正 1 对 1 数字副本。

在本文中,我们将回顾您可以在本地无障碍运行的 7 款顶级 OCR 模型,将您的图像、PDF 甚至照片转换为完美的数字副本。

1. olmOCR 2 7B 1025

olmOCR-2-7B-1025 是一个专为文档光学字符识别优化的高级视觉语言模型。

该模型由艾伦人工智能研究所(Allen Institute for Artificial Intelligence)发布,基于 Qwen2.5-VL-7B-Instruct 进行微调,使用了 olmOCR-mix-1025 数据集,并通过 GRPO 强化学习训练进一步增强。

该模型在 olmOCR-bench 评估中取得了 82.4 的总分,在具有挑战性的 OCR 任务中展现出强大的性能,包括数学方程、表格和复杂的文档布局。

它专为高效的大规模处理而设计,与 olmOCR 工具包配合效果最佳,该工具包提供自动渲染、旋转和重试功能,可处理数百万份文档。

以下是其前五大关键特性:

- 自适应内容感知处理:自动对文档内容类型(包括表格、图表和数学方程)进行分类,以应用专业化的 OCR 策略,从而提高准确性。

- 强化学习优化:GRPO 强化学习训练专门提高了对数学方程、表格和其他困难 OCR 案例的准确性。

- 卓越的基准性能:在 olmOCR-bench 上总体得分 82.4,在 arXiv 文档、旧扫描件、页眉、页脚和多栏布局方面表现强劲。

- 专业文档处理:针对最长维度为 1288 像素的文档图像进行了优化,需要特定的元数据提示以获得最佳效果。

- 可扩展的工具包支持:旨在与 olmOCR 工具包配合使用,支持基于 VLLM 的高效推理,能够处理数百万份文档。

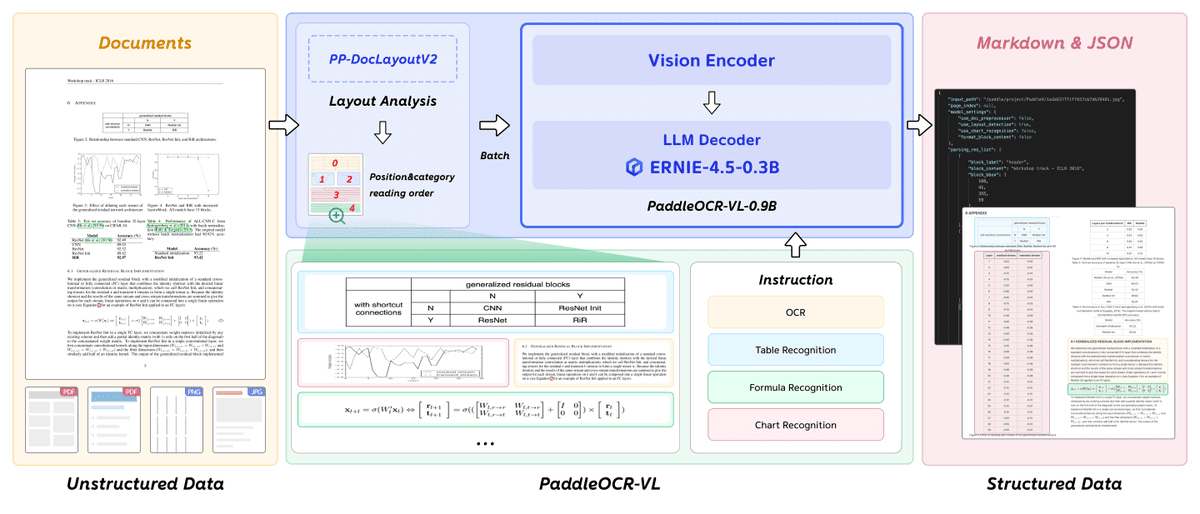

2. PP OCR v5 Server Det

PaddleOCR VL 是一个超紧凑的视觉语言模型,专为高效的多语言文档解析而设计。

其核心组件 PaddleOCR-VL-0.9B 集成了 NaViT 风格的动态分辨率视觉编码器和轻量级的 ERNIE-4.5-0.3B 语言模型,在保持最小资源消耗的同时实现了最先进的性能。

该模型支持 109 种语言,包括中文、英文、日文、阿拉伯文、印地文和泰文,擅长识别文本、表格、公式和图表等复杂的文档元素。

通过在 OmniDocBench 和内部基准测试中的全面评估,PaddleOCR-VL 展现出卓越的准确性和快速的推理速度,使其在实际部署场景中非常实用。

以下是其前五大关键特性:

- 超紧凑的 0.9B 架构:结合了 NaViT 风格的动态分辨率视觉编码器和 ERNIE-4.5-0.3B 语言模型,在保持高准确性的同时实现了资源高效的推理。

- 最先进的文档解析:在 OmniDocBench v1.5 和 v1.0 上实现了领先的整体文档解析、文本识别、公式提取、表格理解和阅读顺序检测性能。

- 广泛的多语言支持:能识别 109 种语言,涵盖主要的全球语言和不同的文字系统,如西里尔字母、阿拉伯文、梵文和泰文,实现真正的全球文档处理。

- 全面的元素识别:擅长识别和提取文本、表格、数学公式和图表,包括复杂的布局和具有挑战性的内容,如手写文本和历史文档。

- 灵活的部署选项:支持多种推理后端,包括原生 PaddleOCR 工具包、transformers 库和 vLLM 服务器,可在不同部署场景中实现优化性能。

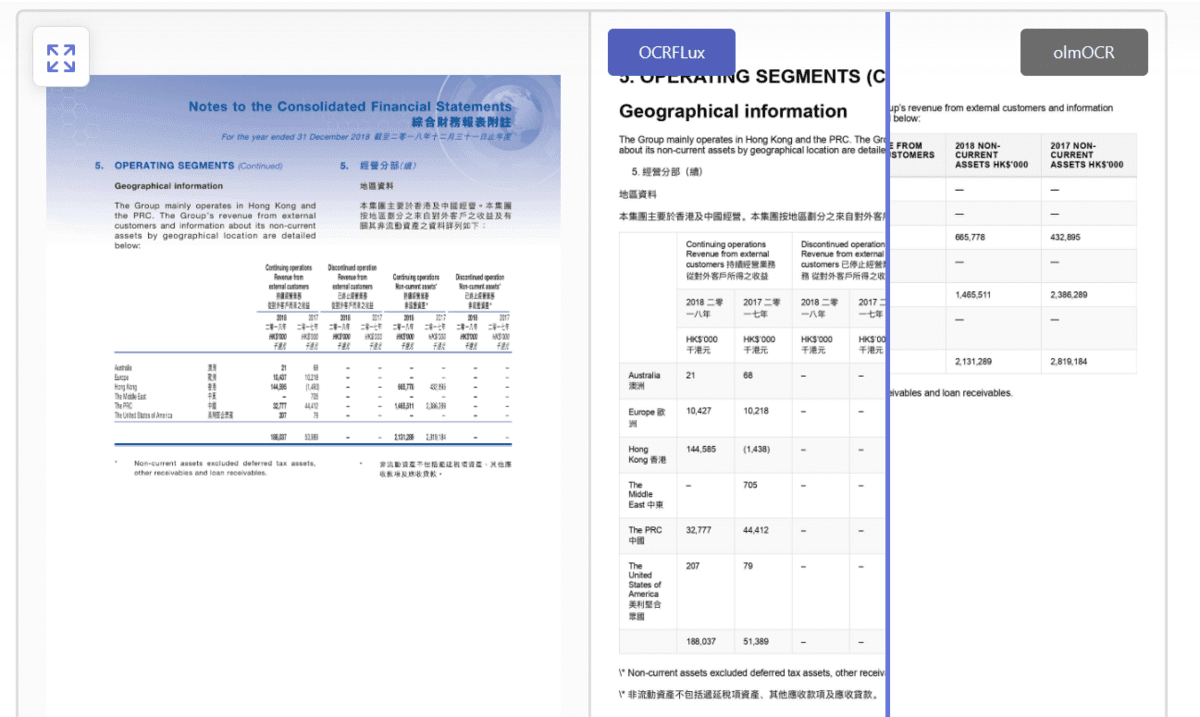

3. OCRFlux 3B

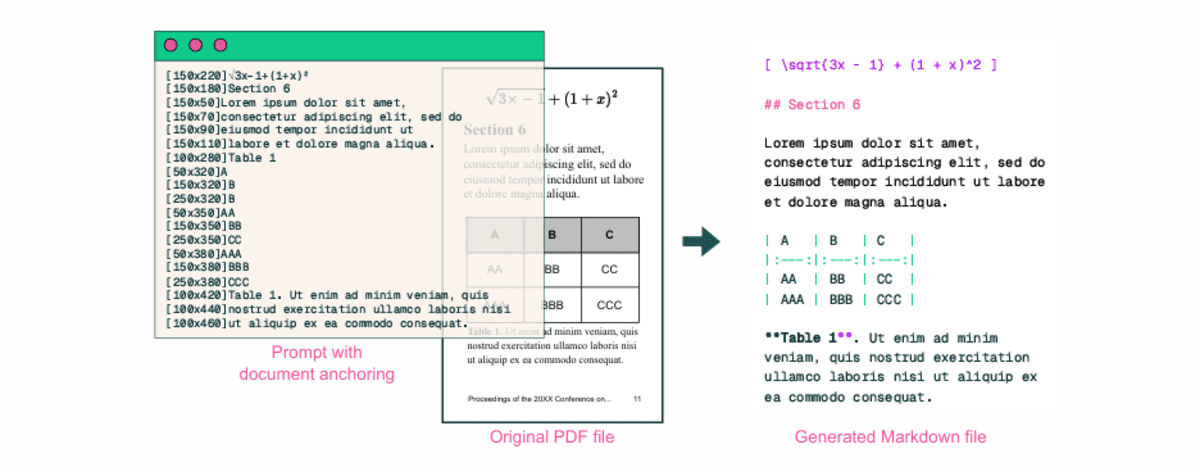

OCRFlux-3B 是一个多模态大型语言模型的预览版本,基于 Qwen2.5-VL-3B-Instruct 进行微调,用于将 PDF 和图像转换为清晰、可读的 Markdown 文本。

该模型利用私有文档数据集和 olmOCR-mix-0225 数据集来实现卓越的解析质量。

凭借其紧凑的 30 亿参数架构,OCRFlux-3B 可以在 GTX 3090 等消费级硬件上高效运行,同时通过 OCRFlux 工具包支持原生跨页表格和段落合并等高级功能,并支持 vLLM 推理。

该模型在全面的基准测试中取得了最先进的性能,专为可扩展部署而设计。

以下是其前五大关键特性:

- 卓越的单页解析精度:在 OCRFlux-bench-single 上实现了 0.967 的编辑距离相似度,显著优于 olmOCR-7B-0225-preview、Nanonets-OCR-s 和 MonkeyOCR。

- 原生跨页结构合并:首个原生支持检测和合并跨越多页的表格和段落的开源项目,在跨页检测上取得了 0.986 的 F1 分数。

- 高效的 3B 参数架构:紧凑的模型设计支持部署在 GTX 3090 GPU 上,同时通过 vLLM 优化推理,实现数百万文档的处理能力,保持高性能。

- 全面的基准测试套件:提供了包括 OCRFlux-bench-single 和带有手动标记真值的跨页基准测试,以实现可靠的性能测量。

- 可扩展的生产级工具包:包含 Docker 支持、Python API 和用于批量处理的完整流水线,具备可配置的工作进程、重试和错误处理功能,适用于企业部署。

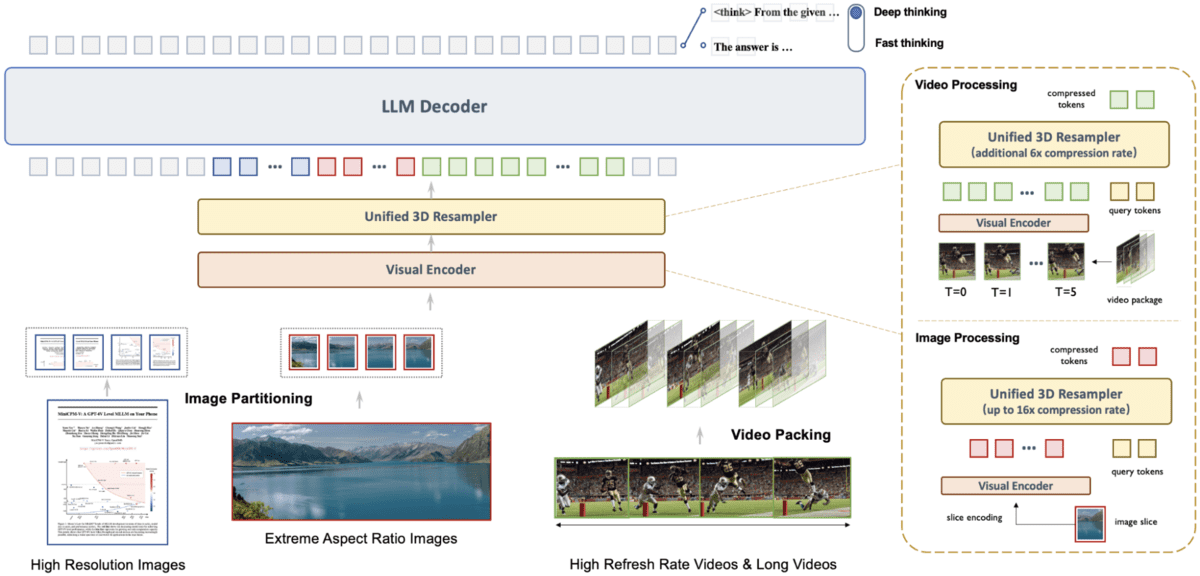

4. MiniCPM-V 4.5

MiniCPM-V 4.5 是 MiniCPM-V 系列的最新模型,提供先进的光学字符识别和多模态理解能力。

该模型基于 Qwen3-8B 和 SigLIP2-400M 构建,拥有 80 亿参数,为在移动设备上直接处理图像、文档、视频中的文本和多张图像提供卓越性能。

它在全面的基准测试中取得了最先进的结果,同时保持了日常应用所需的实用效率。

以下是其前五大关键特性:

- 卓越的基准性能:实现了 77.0 的平均 OpenCompass 分数,超越了 GPT-4o-latest 和 Gemini-2.0 Pro 等更大模型。

- 革命性的视频处理:使用统一的 3D-Resampler 实现高效视频理解,将视频令牌压缩 96 倍,支持高达每秒 10 帧的高 FPS 处理。

- 灵活的推理模式:可控的混合快速和深度思考模式,可在快速响应和复杂推理之间切换。

- 先进的文本识别:强大的 OCR 和文档解析能力,可处理高达 180 万像素的高分辨率图像,在 OCRBench 和 OmniDocBench 上取得了领先分数。

- 多功能平台支持:通过 llama.cpp 和 ollama 支持、16 种量化模型大小、SGLang 和 vLLM 集成、微调选项、WebUI 演示、iOS 应用和在线 Web 演示,轻松部署在各个平台上。

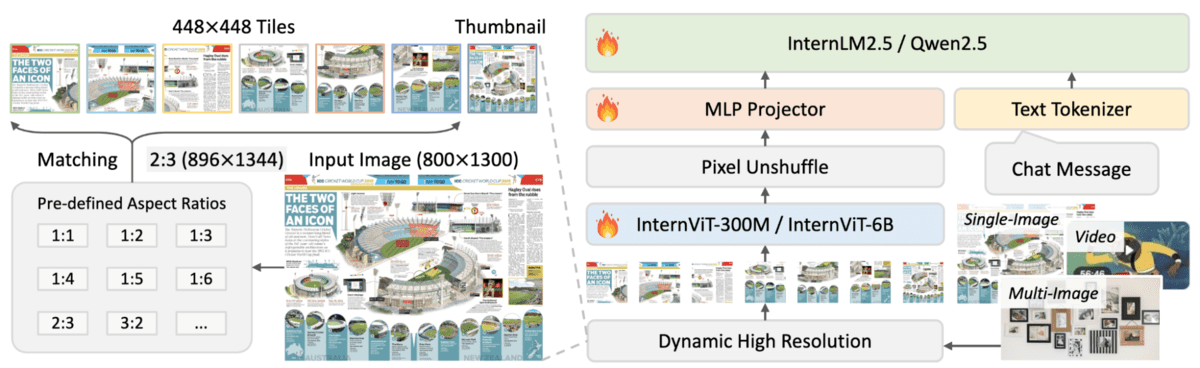

5. InternVL 2.5 4B

InternVL2.5-4B 是 InternVL 2.5 系列中的一个紧凑型多模态大型语言模型,它结合了 3 亿参数的 InternViT 视觉编码器和 30 亿参数的 Qwen2.5 语言模型。

该模型总参数量为 40 亿,专为高效的光学字符识别和跨图像、文档和视频的全面多模态理解而设计。

它采用了一种动态分辨率策略,以 448x448 像素的块处理视觉内容,同时在文本识别和推理任务上保持强劲性能,使其适用于资源受限的环境。

以下是其前五大关键特性:

- 动态高分辨率处理:通过像素解混操作进行智能令牌减少,将单张图像、多张图像和视频帧划分为自适应的 448x448 像素块进行处理。

- 高效三阶段训练:具有精心设计的流水线,包括 MLP 预热、用于专业领域的可选视觉编码器增量学习,以及带有严格数据质量控制的全模型指令微调。

- 渐进式缩放策略:先用较小的语言模型训练视觉编码器,然后再迁移到较大的模型,使用的令牌不到同类模型所需令牌的十分之一。

- 先进的数据质量过滤:采用基于 LLM 的质量评分、重复检测和基于启发式规则的过滤的全面流水线,以去除低质量样本并防止模型退化。

- 强大的多模态性能:在 OCR、文档解析、图表理解、多图像理解和视频分析方面取得了有竞争力的结果,同时通过改进的数据策展保持了纯语言能力。

6. Granite Vision 3.3 2b

Granite Vision 3.3 2b 是 IBM 于 2025 年 6 月 11 日发布的一个紧凑高效的视觉语言模型,专为视觉文档理解任务设计。

该开源模型基于 Granite 3.1-2b-instruct 语言模型和 SigLIP2 视觉编码器构建,能够从表格、图表、信息图、图形和示意图中自动提取内容。

它引入了实验性功能,包括图像分割、文档标签生成和多页文档支持,同时比早期版本具有更高的安全性。

以下是其前五大关键特性:

- 卓越的文档理解性能:在 ChartQA、DocVQA、TextVQA 和 OCRBench 等关键基准测试中得分提高,优于以前的 granite-vision 版本。

- 增强的安全对齐:在 RTVLM 和 VLGuard 数据集上具有更高的安全分数,能更好地处理政治、种族、越狱和误导性内容。

- 实验性多页支持:经过训练可使用文档中多达 8 个连续页面处理问答任务,支持长上下文处理。

- 高级文档处理功能:引入了图像分割和文档标签生成等新功能,用于将文档解析为结构化文本格式。

- 面向企业的的高效设计:紧凑的 20 亿参数架构,针对视觉文档理解任务进行了优化,同时保持了 128 千个令牌的上下文长度。

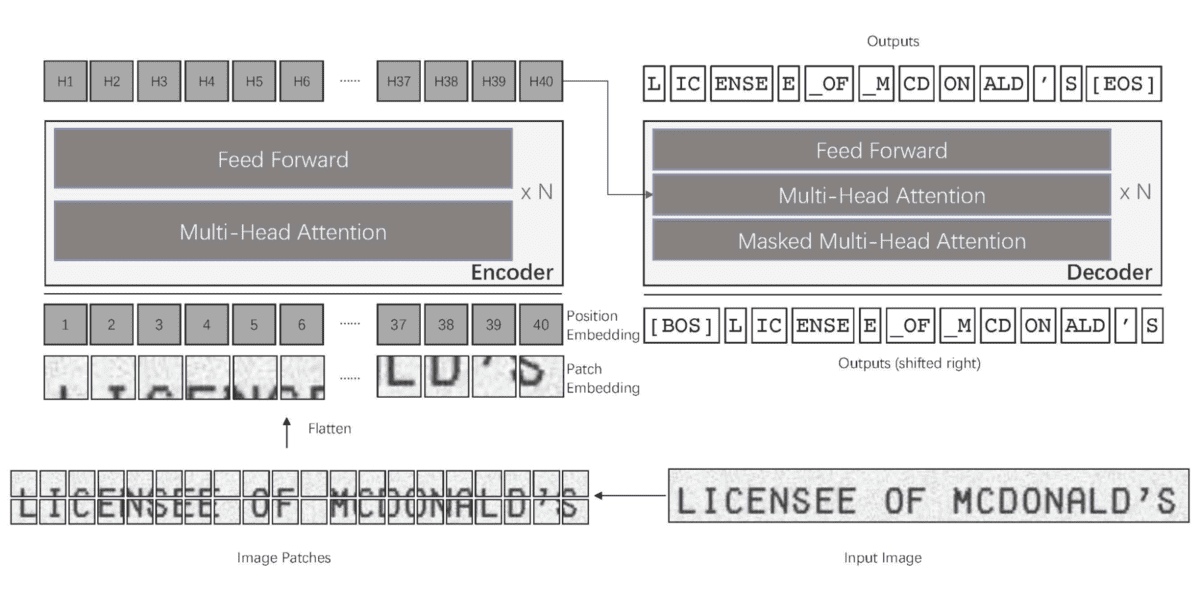

7. Trocr Large Printed

在 SROIE 数据集上微调的 TrOCR 大尺寸模型是一种专门的基于 Transformer 的光学字符识别系统,旨在从单行图像中提取文本。

该模型基于论文《TrOCR: Transformer-based Optical Character Recognition with Pre-trained Models》中介绍的架构,结合了经 BEiT 初始化处理的图像 Transformer 编码器和经 RoBERTa 初始化处理的文本 Transformer 解码器。

该模型将图像处理为 16x16 像素块的序列,并自回归生成文本令牌,因此在印刷文本识别任务中特别有效。

以下是其前五大关键特性:

- 基于 Transformer 的架构:采用编码器-解码器设计,具有图像 Transformer 编码器和文本 Transformer 解码器,实现端到端的 OCR。

- 预训练组件初始化:利用 BEiT 权重进行图像编码器和 RoBERTa 权重进行文本解码器,以获得更好的性能。

- 基于块的图像处理:将图像处理为固定大小的 16x16 块,带有线性嵌入和位置嵌入。

- 自回归文本生成:解码器按顺序生成文本令牌,以实现准确的字符识别。

- SROIE 数据集专业化:在 SROIE 数据集上进行微调,以增强对印刷文本识别任务的性能。

总结

下表快速总结了领先的开源 OCR 和视觉语言模型,突出显示了它们的优势、功能和最佳用例。

| 模型 | 参数量 | 主要优势 | 特殊功能 | 最佳用例 |

|---|---|---|---|---|

| olmOCR-2-7B-1025 | 7B | 高精度文档 OCR | GRPO RL 训练、方程和表格 OCR,针对 ~1288px 文档输入优化 | 大规模文档处理流程、科学和技术 PDF |

| PaddleOCR v5 / PaddleOCR-VL | 1B | 多语言解析(109 种语言) | 文本、表格、公式、图表;基于 NaViT 的动态视觉编码器 | 全球多语言 OCR,具有轻量级、高效的推理能力 |

| OCRFlux-3B | 3B | Markdown 准确解析 | 跨页表格和段落合并;为 vLLM 优化 | PDF 转 Markdown 处理流程;可在消费级 GPU 上良好运行 |

| MiniCPM-V 4.5 | 8B | 最先进的多模态 OCR | 视频 OCR,支持 1.8MP 图像,快速和深度思考模式 | 移动和边缘 OCR,视频理解,多模态任务 |

| InternVL 2.5-4B | 4B | 高效 OCR 和多模态推理 | 动态 448×448 瓷砖策略;强大的文本提取能力 | 资源受限环境;多图像和视频 OCR |

| Granite Vision 3.3 (2B) | 2B | 视觉文档理解 | 图表、表格、示意图、分割、文档标签、多页问答 | 企业级文档提取,涵盖表格、图表和示意图 |

| TrOCR Large (Printed) | 0.6B | 清晰的印刷文本 OCR | 16×16 块编码器;带有 RoBERTa 解码器的 BEiT 编码器 | 简单、高质量的印刷文本提取 |

Abid Ali Awan (@1abidaliawan) 是一位认证的数据科学家专业人士,热衷于构建机器学习模型。目前,他专注于内容创作和撰写有关机器学习和数据科学技术的博客。Abid 拥有技术管理硕士学位和电信工程学士学位。他的愿景是利用图神经网络为正在与精神疾病作斗争的学生构建一个 AI 产品。

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区