📢 转载信息

原文链接:http://bair.berkeley.edu/blog/2024/07/20/visual-haystacks/

原文作者:Berkeley AI Research (BAIR)

人类擅长处理大量的视觉信息,这项技能对于实现通用人工智能(AGI)至关重要。几十年来,人工智能研究人员开发了视觉问答(VQA)系统来解释单个图像中的场景并回答相关问题。虽然基础模型(foundation models)的最新进展显著缩小了人类与机器视觉处理之间的差距,但传统的VQA系统一直局限于一次只能推理单个图像,而不是整个视觉数据集合。

这种局限性在更复杂的场景中带来了挑战。例如,在医疗图像集合中辨别模式、通过卫星图像监测森林砍伐、使用自动导航数据绘制城市变化图、分析大型艺术收藏品的主题元素,或从零售监控录像中理解消费者行为等场景。每个场景不仅需要在数百或数千张图像上进行视觉处理,还需要对这些发现进行跨图像处理。为弥补这一差距,本项目专注于“多图像问答”(MIQA)任务,该任务超出了传统VQA系统的能力范围。

视觉草垛 (Visual Haystacks):第一个“以视觉为中心”的“大海捞针”(Needle-In-A-Haystack, NIAH)基准测试,旨在严格评估大型多模态模型(LMMs)处理长上下文视觉信息的能力。

如何对MIQA中的VQA模型进行基准测试?

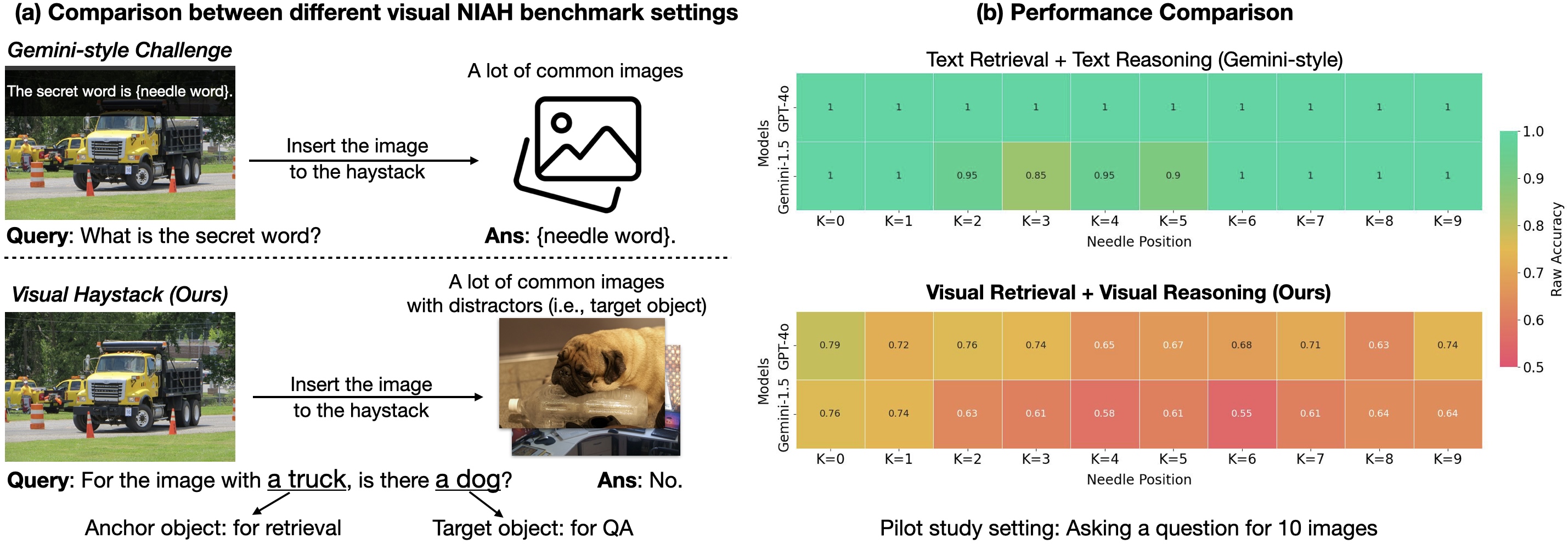

“大海捞针”(NIAH)挑战最近已成为基准测试LLM处理包含“长上下文”输入(如长文档、视频或数百张图像)能力的最流行范式之一。在此任务中,包含特定问题答案的关键信息(“针”)被嵌入到大量数据(“干草堆”)中。系统必须检索相关信息并正确回答问题。

第一个用于视觉推理的NIAH基准测试由谷歌在其Gemini-v1.5 技术报告中引入。在该报告中,他们要求模型从大型视频的单个帧中检索叠加的文本。事实证明,现有模型在该任务上表现良好——主要是因为它们强大的OCR检索能力。但如果我们提出更多视觉问题,模型的表现是否依然如此出色呢?

什么是视觉草垛(VHs)基准测试?

为了评估“以视觉为中心”的长上下文推理能力,我们引入了“视觉草垛(VHs)”基准测试。该新基准旨在评估大型多模态模型(LMMs)在大型不相关图像集上的视觉检索和推理能力。VHs包含大约1K个二元问答对,每个集合包含1到10K张图像不等。与以往专注于文本检索和推理的基准测试不同,VHs的问题侧重于识别特定视觉内容(例如物体)的存在,利用COCO数据集中的图像和标注。

VHs基准测试分为两个主要挑战,每个挑战旨在测试模型在响应查询之前准确定位和分析相关图像的能力。我们精心设计了数据集,以确保仅凭猜测或依赖常识推理而无需查看图像无法获得优势(即在二元QA任务中仅获得50%的准确率)。

-

单针挑战 (Single-Needle Challenge):在图像的“干草堆”中仅存在一个“针”图像。问题的措辞是:“对于带有锚点物体的图像,是否存在目标物体?”

-

多针挑战 (Multi-Needle Challenge):在图像的“干草堆”中存在两到五个“针”图像。问题的措辞是:“对于所有带有锚点物体的图像,它们是否都包含目标物体?”或“对于所有带有锚点物体的图像,它们中是否有任何一个包含目标物体?”

来自VHs的三个重要发现

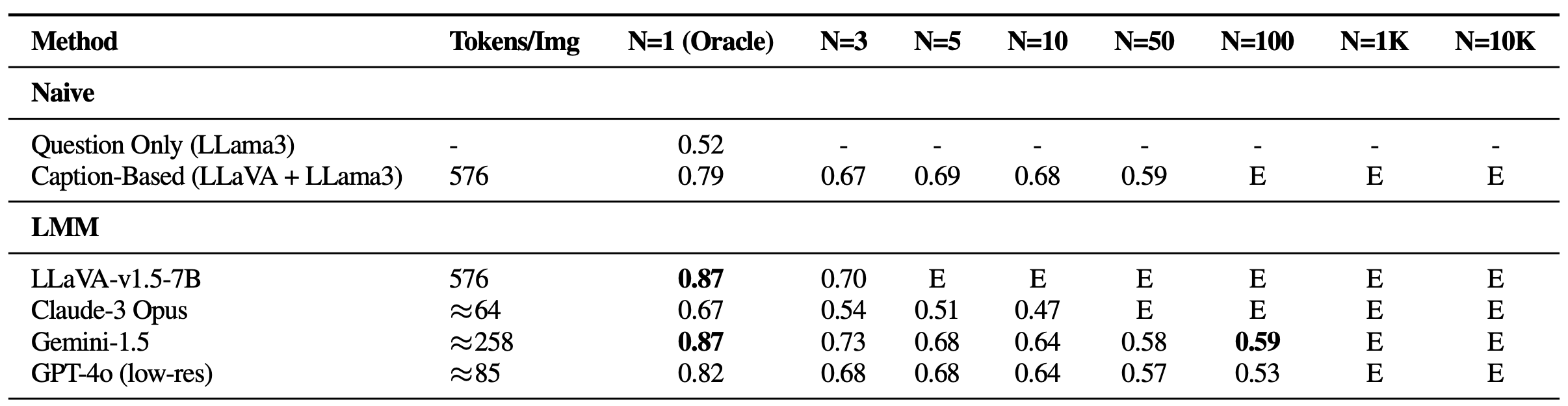

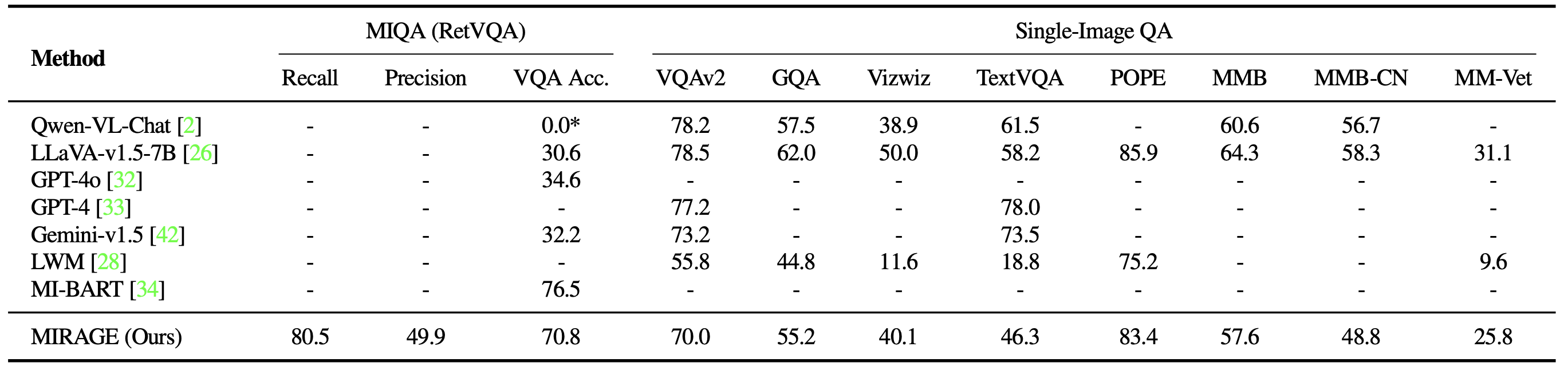

视觉草垛(VHs)基准测试揭示了当前大型多模态模型(LMMs)在处理大量视觉输入时面临的重大挑战。在我们的实验1中,无论是在单针还是多针模式下,我们评估了多种开源和专有方法,包括LLaVA-v1.5、GPT-4o、Claude-3 Opus和Gemini-v1.5-pro。此外,我们还加入了一个“字幕”(Captioning)基线,采用两阶段方法:首先使用LLaVA为图像生成字幕,然后使用Llama3根据字幕文本回答问题。以下是三个关键见解:

-

视觉干扰的挣扎

在单针设置中,尽管保持了很高的神谕准确率(oracle accuracy),但随着图像数量的增加,性能明显下降——这种情况在先前的基于文本的Gemini式基准测试中并未出现。这表明现有模型主要在视觉检索方面存在困难,尤其是在存在具有挑战性的视觉干扰物时。此外,必须强调开源LMM(如LLaVA)的局限性,由于2K的上下文长度限制,它们最多只能处理三张图像。另一方面,像Gemini-v1.5和GPT-4o这样的专有模型,尽管声称具有扩展的上下文能力,但由于使用API调用时的有效载荷大小限制,当图像数量超过1K时,通常无法处理请求。

单针问题在VHs上的性能。随着“干草堆”大小(N)的增加,所有模型的性能都出现显著下降,表明它们对视觉干扰物缺乏鲁棒性。E:超出上下文长度。 -

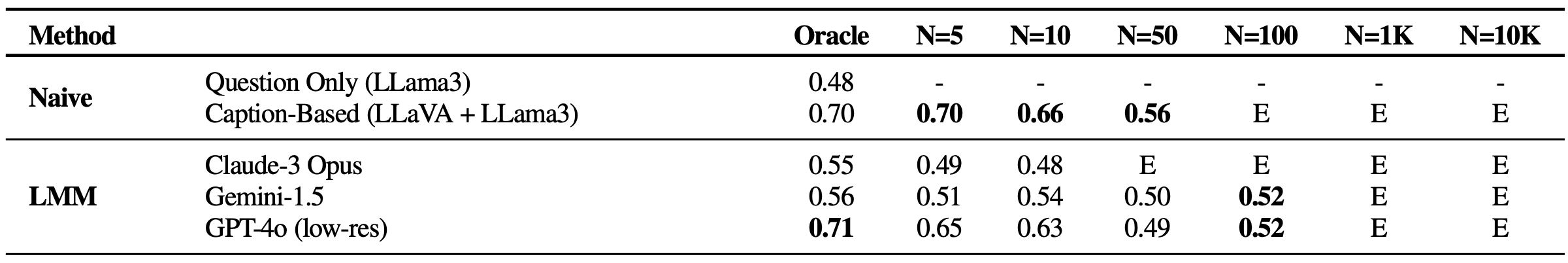

跨多图像推理的难度

有趣的是,与将字幕模型(LLaVA)与LLM聚合器(Llama3)链接起来的基本方法相比,所有基于LMM的方法在包含5张以上图像的单图像QA和所有多针设置中的表现都很弱。这种差异表明,虽然LLM能够有效地整合长上下文字幕,但现有的基于LMM的解决方案不足以处理和整合来自多张图像的信息。值得注意的是,在多图像场景中,性能急剧下降,Claude-3 Opus在仅有神谕图像时表现不佳,而Gemini-1.5/GPT-4o在更大的数据集(50张图像)下准确率下降到50%(如同随机猜测)。

多针问题的VHs结果。所有具有视觉意识的模型表现都很差,表明模型在隐式整合视觉信息方面存在挑战。 -

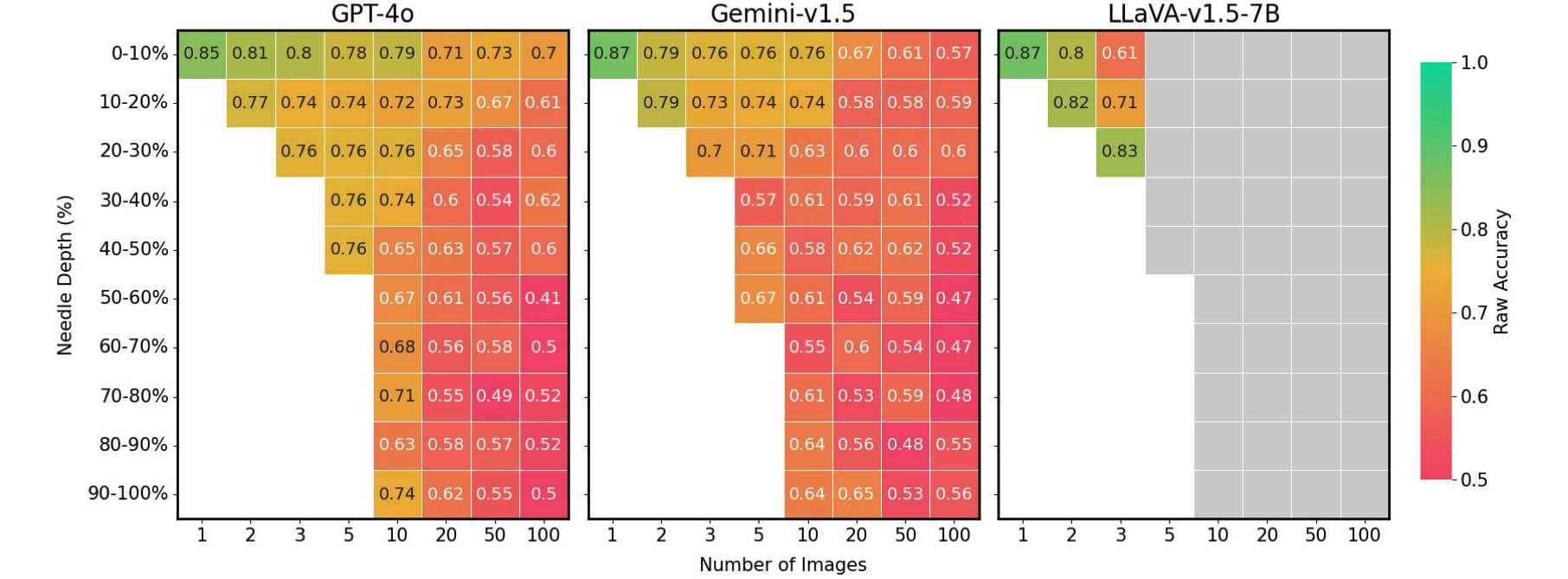

视觉领域的现象

最后,我们发现LMM的准确性受到“针”图像在输入序列中位置的巨大影响。例如,当“针”图像紧接在问题之前放置时,LLaVA表现更好,而在其他情况下,准确率会下降多达26.5%。相比之下,专有模型通常在图像位于开头时表现更好,当不在开头时,准确率会下降多达28.5%。这一模式与自然语言处理(NLP)领域中看到的“迷失在中间”(lost-in-the-middle)现象相呼应,即位于上下文开头或结尾的关键信息会影响模型性能。先前的Gemini式NIAH评估未发现此问题,因为它仅要求文本检索和推理,这也凸显了我们VHs基准测试带来的独特挑战。

不同图像设置下,VHs中“针”位置与性能的关系。当“针”没有理想放置时,现有LMMs显示出高达41%的性能下降。灰色框:超出上下文长度。

MIRAGE:一种基于RAG的解决方案,用于改进VHs性能

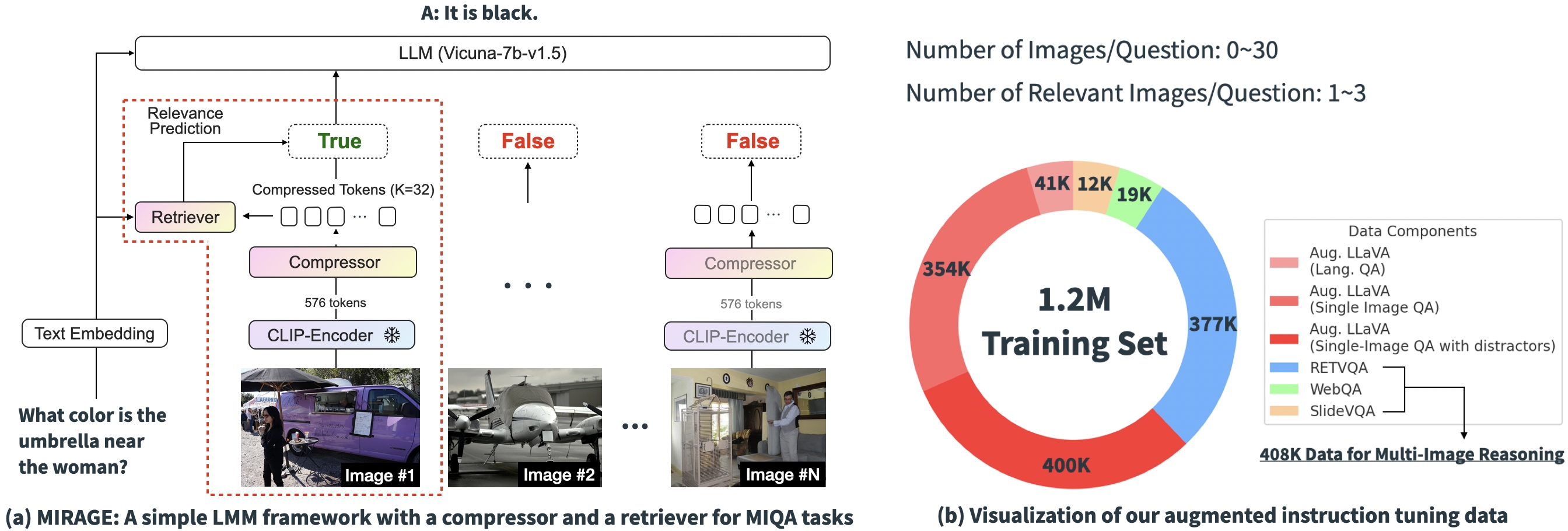

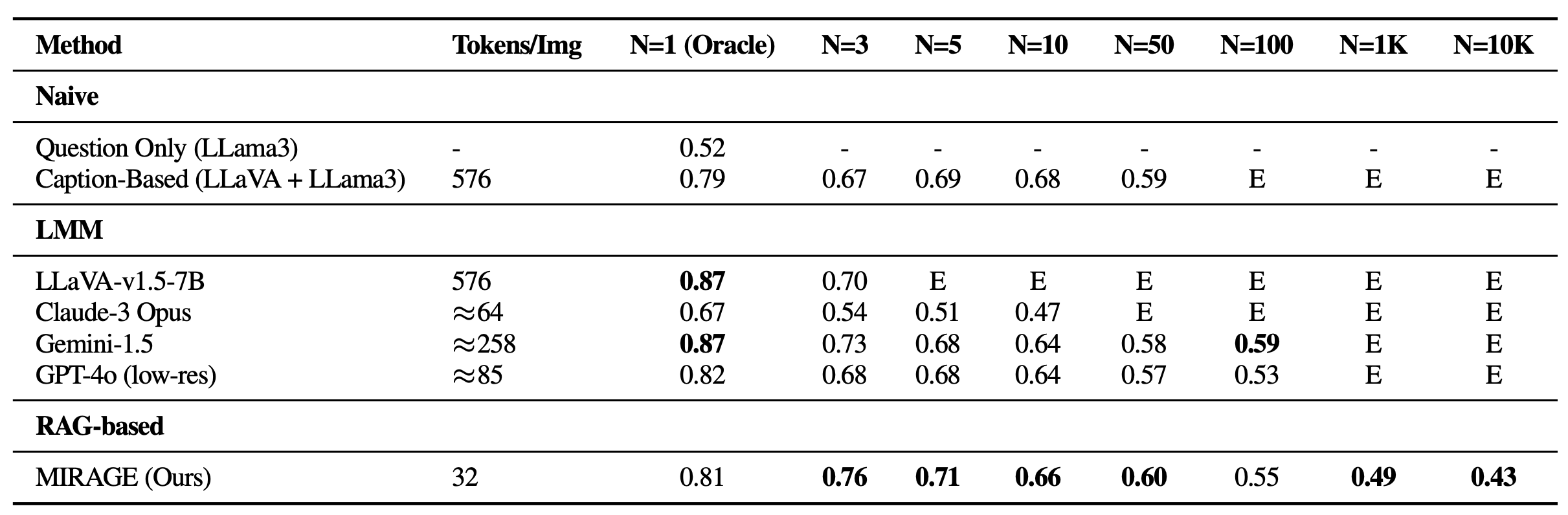

基于上述实验结果,很明显,现有MIQA解决方案的核心挑战在于(1)在没有位置偏差的情况下,能够从大量的潜在不相关图像中准确地检索相关图像,以及(2)整合这些图像中的相关视觉信息以正确回答问题。为解决这些问题,我们引入了一种开源且简单的单阶段训练范式——“MIRAGE”(多图像检索增强生成),它扩展了LLaVA模型以处理MIQA任务。下图展示了我们的模型架构。

我们提出的范式包含几个组件,每个组件都旨在缓解MIQA任务中的关键问题:

-

压缩现有编码:MIRAGE范式利用查询感知的压缩模型,将视觉编码器令牌减少到更小的子集(小10倍),从而在相同的上下文长度内可以容纳更多的图像。

-

采用检索器过滤掉不相关信息:MIRAGE使用与LLM微调在线训练的检索器,来预测一张图像是否相关,并动态删除不相关的图像。

-

多图像训练数据:MIRAGE使用多图像推理数据和合成多图像推理数据来增强现有的单图像指令微调数据。

结果

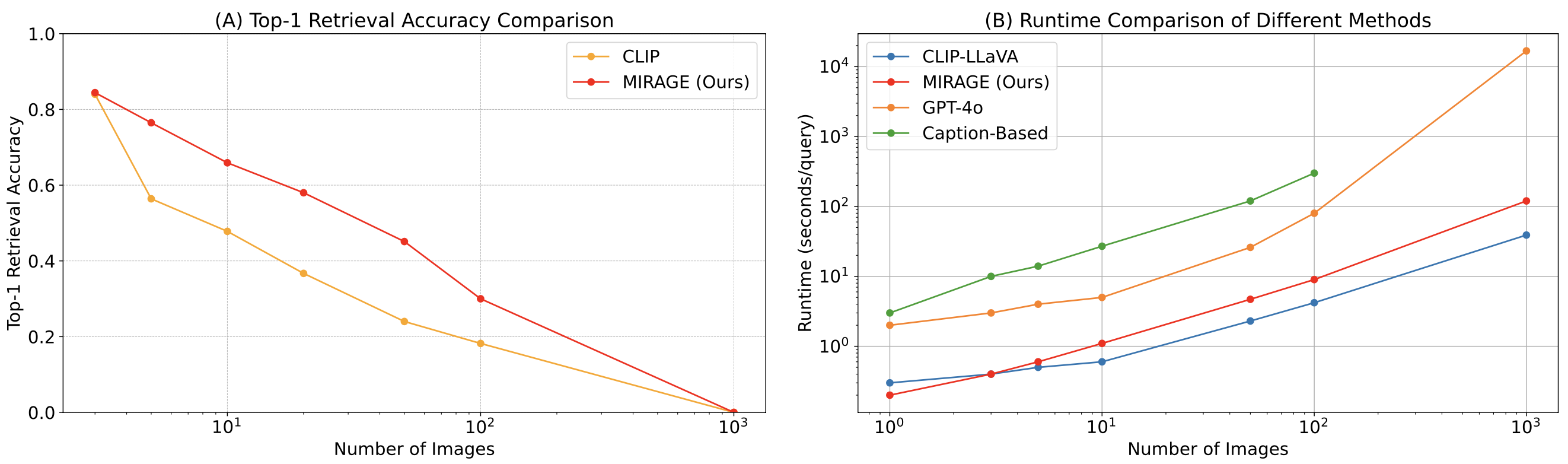

我们使用MIRAGE重新审视了VHs基准测试。除了能够处理1K或10K张图像外,尽管其单图像QA骨干网络较弱(每张图像仅32个令牌),MIRAGE在大多数单针任务上实现了最先进的性能!

我们还在各种VQA任务上对MIRAGE和其他LMMs模型进行了基准测试。在多图像任务上,MIRAGE展示了强大的召回率和精确率能力,显著优于像GPT-4、Gemini-v1.5和大型世界模型(LWM)等强劲竞争对手。此外,它在单图像QA性能上也表现出竞争力。

最后,我们将MIRAGE的协同训练的检索器与CLIP进行了比较。我们的检索器在不损失效率的情况下,性能明显优于CLIP。这表明,虽然CLIP模型可以作为开放词汇图像检索的良好检索器,但在处理类文本查询时,它们可能表现不佳!

最后总结

在这项工作中,我们开发了视觉草垛(VHs)基准测试,并确定了现有大型多模态模型(LMMs)中存在的三个普遍缺陷:

-

视觉干扰的挣扎:在单针任务中,随着图像数量的增加,LMM的性能急剧下降,表明在过滤掉不相关的视觉信息方面存在重大挑战。

-

跨多图像推理的难度:在多针设置中,简单的“字幕后接基于语言的QA”等方法优于所有现有的LMMs,突显了LMMs处理多图像信息的能力不足。

-

视觉领域的现象:专有模型和开源模型都表现出对“针”信息在图像序列中位置的敏感性,在视觉领域中表现出“迷失在中间”的现象。

作为回应,我们提出了MIRAGE,这是一个开创性的视觉检索增强生成(视觉-RAG)框架。MIRAGE通过创新的视觉令牌压缩器、协同训练的检索器以及增强的多图像指令调优数据解决了这些挑战。

在探索完这篇博客后,我们鼓励所有未来的LMM项目使用视觉草垛框架对模型进行基准测试,以便在部署前识别和纠正潜在的缺陷。我们还敦促社区探索多图像问答,作为推进真正通用人工智能(AGI)前沿的一种手段。

最后,请查看我们的项目页面、arXiv论文,并点击我们的GitHub仓库上的星标按钮!

@article{wu2024visual, title={Visual Haystacks: Answering Harder Questions About Sets of Images}, author={Wu, Tsung-Han and Biamby, Giscard and and Quenum, Jerome and Gupta, Ritwik and Gonzalez, Joseph E and Darrell, Trevor and Chan, David M}, journal={arXiv preprint arXiv:2407.13766}, year={2024} } 🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区