📢 转载信息

原文链接:https://www.ithome.com/0/906/565.htm

原文作者:故渊

IT之家 12 月 20 日消息,谷歌于 12 月 18 日发布公告,宣布推出 FunctionGemma,是基于 Gemma 3 270M 微调的专用模型,目的是将强大的函数调用(Function Calling)能力引入手机等边缘设备。

谷歌表示,随着行业从单纯的对话式接口转向 主动式智能体(Agent),开发者对模型本地执行任务的需求日益迫切。

FunctionGemma 正是为此而生,它不仅继承了 Gemma 系列的轻量化优势,更通过专项微调,让边缘设备(如智能手机和嵌入式系统)无需依赖云端算力,能够精准理解用户指令并调用相应功能。

与通用大模型不同,FunctionGemma 专为“定制化”设计。它既能与人类自然对话,也能生成结构化的函数调用代码来指挥计算机。

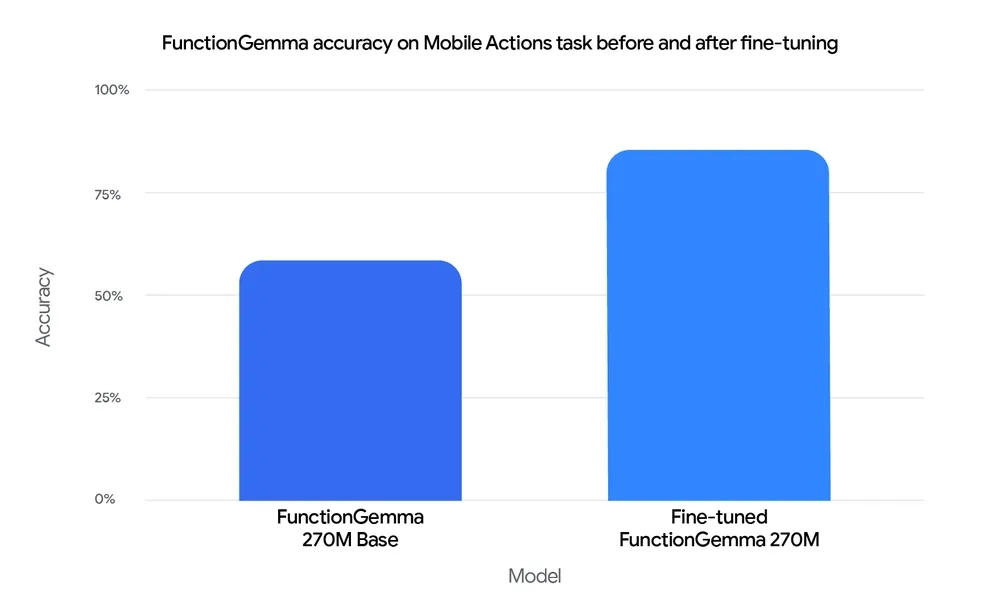

在 Google 进行的“移动操作”(Mobile Actions)测试中,该模型展现了惊人的可塑性:未经微调的基础版本准确率为 58%,而经过针对性微调后,其执行复杂指令(如“明天约午饭并添加到日历”、“帮我把昨天拍的美食发给老妈”)的准确率跃升至 85%。

为了在算力和电池受限的边缘设备上流畅运行,FunctionGemma 采用了极致的轻量化设计。它利用 Gemma 的 256k 词表高效处理 JSON 数据和多语言输入,大幅降低了延迟。

该模型目前已适配 NVIDIA Jetson Nano 等开发板及主流移动设备,甚至能作为“交通指挥官”,处理简单任务并将复杂逻辑路由至更大的 Gemma 3 27B 模型。

为了降低开发门槛,谷歌为 FunctionGemma 构建了广泛的生态支持。开发者现在即可通过 Hugging Face、Kaggle 下载模型,并利用 Unsloth、Keras 或 NVIDIA NeMo 进行微调。

在部署方面,该模型全面支持 LiteRT-LM、vLLM、Llama.cpp 和 Ollama 等工具。谷歌还同步发布了 TinyGarden 游戏演示和“移动操作”微调指南,展示了如何用自然语言控制虚拟农场或手机系统设置,帮助开发者快速构建属于自己的私有化、低延迟端侧智能体。IT之家附上演示视频如下:

广告声明:文内含有的对外跳转链接(包括不限于超链接、二维码、口令等形式),用于传递更多信息,节省甄选时间,结果仅供参考,IT之家所有文章均包含本声明。

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区