📢 转载信息

原文作者:Traci Lim, Chanmi Eun, Sharadha Kandasubramanian, Melanie Li, Saurabh Trikande, and Vincent Wang

在泰国、马来西亚、新加坡、印度尼西亚和台湾的组织,现在可以通过Amazon Bedrock上针对扩展规模设计的全球分布式推理架构,利用全局跨区域推理(CRIS)功能访问Anthropic Claude Opus 4.6、Sonnet 4.6和Haiku 4.5等基础模型。全局CRIS提供三大优势:更高的配额、成本效益以及智能请求路由至跨AWS商业区域的推理容量,从而赋能聊天机器人、自主编码代理和金融分析系统等AI用例的客户。

在本文中,我们很高兴地宣布,全局CRIS现已向泰国、马来西亚、新加坡、台湾和印度尼西亚的客户开放,并将介绍技术实施步骤,并涵盖配额管理最佳实践,以最大化您的AI推理部署的价值。我们还将提供生产部署的最佳实践指南。

全局跨区域推理

CRIS是一项强大的Amazon Bedrock功能,组织可利用它将推理处理无缝地分布到多个AWS区域。此功能可帮助您在构建规模化应用时实现更高的吞吐量,确保即使在重负载下,您的生成式AI应用也能保持响应速度和可靠性。

您通过推理配置文件(inference profiles)来访问CRIS,推理配置文件基于两个关键概念运行:

- 源区域(Source Region) – 您发出API请求的区域

- 目标区域(Destination Region) – Amazon Bedrock可以路由请求以进行推理的区域

CRIS通过安全的AWS网络运行,对传输中和静态存储的数据进行端到端加密。当您从源区域提交推理请求时,CRIS会通过Amazon Bedrock托管网络,将请求智能地路由到推理配置文件配置的目标区域之一。推理请求通过Bedrock在AWS全球网络上传输,响应会返回到源区域的您的应用程序。

关键区别在于,虽然推理处理(瞬态计算)可能发生在另一个区域,但静态存储的数据——包括日志、知识库和存储的配置——仍然专属于您的源区域。Amazon Bedrock提供两种类型的跨区域推理配置文件:地理CRIS(在特定地理区域内路由,如美国、欧盟、亚太地区、澳大利亚、日本)和全局CRIS(路由到全球支持的商业区域)。现在,泰国、马来西亚、新加坡、台湾和印度尼西亚的客户可以通过全局CRIS访问Claude Opus 4.6、Sonnet 4.6和Haiku 4.5,该功能可跨区域路由请求,以实现更高的吞吐量和在流量高峰期间的内置弹性。

为何泰国、马来西亚、新加坡、台湾和印度尼西亚需要全局CRIS

随着组织从对话式AI助手转向能够规划、执行和协调复杂工作流程的自主代理,生产级AI部署需要更具弹性、更可扩展的基础设施。全局CRIS通过专为满足向生产级自主系统转变的需求而设计的高可用性架构,交付Claude Opus 4.6、Sonnet 4.6和Haiku 4.5。当自主代理越来越多地处理针对泰国、马来西亚、新加坡、台湾和印度尼西亚客户的用例中的商家运营、协调物流网络和自动化财务工作流程时,基础设施的可靠性直接影响这些自主决策系统的连续性。全局CRIS将推理请求路由到全球AWS区域上的更多推理容量,降低了应用程序在流量高峰期间遇到服务限流的可能性。这种路由能力提供了内置的弹性,使您的代理应用能够在需求模式变化时保持操作连续性。

泰国、马来西亚、新加坡、台湾和印度尼西亚的源区域配置

在发布时,泰国、马来西亚、新加坡、台湾和印度尼西亚的客户可以从以下源区域调用全局CRIS配置文件:

| 源区域 | AWS 商业区域 | 可用性 | 全局CRIS路由 |

| 亚太地区(新加坡) | ap-southeast-1 |

现已可用 | 路由到全球20多个支持的AWS商业区域 |

| 亚太地区(雅加达) | ap-southeast-3 |

现已可用 | 路由到全球20多个支持的AWS商业区域 |

| 亚太地区(台北) | ap-east-2 |

现已可用 | 路由到全球20多个支持的AWS商业区域 |

| 亚太地区(泰国) | ap-southeast-7 |

现已可用 | 路由到全球20多个支持的AWS商业区域 |

| 亚太地区(马来西亚) | ap-southeast-5 |

现已可用 | 路由到全球20多个支持的AWS商业区域 |

在后台调用后,全局CRIS将管理请求到任何受支持的商业AWS区域的路由。

先决条件

在使用全局CRIS之前,您需要配置IAM权限,以启用推理请求的跨区域路由。

配置IAM权限

在通过全局CRIS调用Claude模型之前,必须配置IAM权限以适应跨区域路由架构。以下部分将介绍策略结构并解释为什么需要三个独立的语句。

完成以下步骤配置全局CRIS的IAM权限。IAM策略授予通过全局CRIS调用Claude模型的权限。该策略需要三个语句,因为CRIS跨区域路由请求:您在源区域(新加坡或雅加达)调用推理配置文件,然后该配置文件会调用CRIS选择的任何目标区域中的基础模型。第三个语句使用"aws:RequestedRegion": "unspecified"来授予全局CRIS跨区域路由请求所需的必要权限。

将<ACCOUNT>替换为您的AWS账户ID,如果使用雅加达(ap-southeast-3)而不是新加坡(ap-southeast-1),请调整源区域。

{

"Version": "2012-10-17",

"Statement": [

{

"Sid": "GrantGlobalCrisInferenceProfileRegionAccess",

"Effect": "Allow",

"Action": "bedrock:InvokeModel",

"Resource": [

"arn:aws:bedrock:ap-southeast-1:<ACCOUNT>:inference-profile/global.anthropic.claude-opus-4-6-v1",

"arn:aws:bedrock:ap-southeast-1:<ACCOUNT>:inference-profile/global.anthropic.claude-sonnet-4-5-20250929-v1:0",

"arn:aws:bedrock:ap-southeast-1:<ACCOUNT>:inference-profile/global.anthropic.claude-haiku-4-5-20251001-v1:0"

],

"Condition": {

"StringEquals": {

"aws:RequestedRegion": "ap-southeast-1"

}

}

},

{

"Sid": "GrantGlobalCrisInferenceProfileInRegionModelAccess",

"Effect": "Allow",

"Action": "bedrock:InvokeModel",

"Resource": [

"arn:aws:bedrock:ap-southeast-1::foundation-model/anthropic.claude-opus-4-6-v1",

"arn:aws:bedrock:ap-southeast-1::foundation-model/anthropic.claude-sonnet-4-5-20250929-v1:0",

"arn:aws:bedrock:ap-southeast-1::foundation-model/anthropic.claude-haiku-4-5-20251001-v1:0"

],

"Condition": {

"StringEquals": {

"aws:RequestedRegion": "ap-southeast-1",

"bedrock:InferenceProfileArn": [ "arn:aws:bedrock:ap-southeast-1:<ACCOUNT>:inference-profile/global.anthropic.claude-opus-4-6-v1", "arn:aws:bedrock:ap-southeast-1:<ACCOUNT>:inference-profile/global.anthropic.claude-sonnet-4-5-20250929-v1:0",

"arn:aws:bedrock:ap-southeast-1:<ACCOUNT>:inference-profile/global.anthropic.claude-haiku-4-5-20251001-v1:0"

}

}

},

{

"Sid": "GrantGlobalCrisInferenceProfileGlobalModelAccess",

"Effect": "Allow",

"Action": "bedrock:InvokeModel",

"Resource": [

"arn:aws:bedrock:::foundation-model/anthropic.claude-opus-4-6-v1",

"arn:aws:bedrock:::foundation-model/anthropic.claude-sonnet-4-5-20250929-v1:0",

"arn:aws:bedrock:::foundation-model/anthropic.claude-haiku-4-5-20251001-v1:0"

],

"Condition": {

"StringEquals": {

"aws:RequestedRegion": "unspecified",

"bedrock:InferenceProfileArn": [

"arn:aws:bedrock:ap-southeast-1:<ACCOUNT>:inference-profile/global.anthropic.claude-opus-4-6-v1",

"arn:aws:bedrock:ap-southeast-1:<ACCOUNT>:inference-profile/global.anthropic.claude-sonnet-4-5-20250929-v1:0",

"arn:aws:bedrock:ap-southeast-1:<ACCOUNT>:inference-profile/global.anthropic.claude-haiku-4-5-20251001-v1:0"

]

}

}

}

]

}

需要注意的是,如果贵组织的服务控制策略(SCPs)拒绝访问unspecified区域,全局CRIS将无法正常工作。我们建议在部署依赖全局路由的生产工作负载之前,验证您的SCP配置。

如果您的组织限制AWS API调用到特定区域,请确保您的SCP在批准的区域列表中包含了"unspecified"。以下示例展示了如何配置一个允许全局CRIS路由的SCP。请在批准的区域列表中添加您的全局CRIS源区域(新加坡ap-southeast-1或雅加达ap-southeast-3)以及贵组织使用的其他区域:

{

"Version": "2012-10-17",

"Statement": [

{

"Sid": "DenyAllOutsideApprovedRegions",

"Effect": "Deny",

"Action": "*",

"Resource": "*",

"Condition": {

"StringNotEquals": {

"aws:RequestedRegion": [

"ap-southeast-1",

"unspecified"

]

}

}

}

]

}

配置好IAM权限后,您就可以开始使用推理配置文件和Converse API通过全局CRIS调用Claude模型了。

使用跨区域推理配置文件

全局推理配置文件的模型标识符中带有global.前缀——这是一个命名约定,可用于区分全局路由配置文件与区域性或单区域模型ID。在进行API调用时,请使用这些推理配置文件ID,而不是标准的模型ID:

| 模型 | 基础模型ID | 全局推理配置文件ID |

| Claude Sonnet 4.6 | anthropic.claude-sonnet-4-6 | global.anthropic.claude-sonnet-4-6 |

| Claude Opus 4.6 | anthropic.claude-opus-4-6-v1 | global.anthropic.claude-opus-4-6-v1 |

| Claude Sonnet 4.5 | anthropic.claude-sonnet-4-5-20250929-v1:0 | global.anthropic.claude-sonnet-4-5-20250929-v1:0 |

| Claude Haiku 4.5 | anthropic.claude-haiku-4-5-20251001-v1:0 | global.anthropic.claude-haiku-4-5-20251001-v1:0 |

InvokeModel API和Converse API都支持跨区域推理配置文件。我们推荐使用Converse API——此方法提供简化的接口和一致的请求/响应格式,适用于不同的基础模型,因此您可以在不重写集成代码的情况下在模型之间切换。

进行您的第一个API调用

开始使用全局CRIS只需要对现有应用程序代码进行少量更改。以下代码片段演示了如何使用boto3 SDK在Python中通过全局CRIS调用Claude Opus 4.6:

import logging

import os

import boto3

from botocore.exceptions import ClientError

# Configure logging

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

# Load configuration from environment variables with defaults

REGION = os.getenv( "AWS_REGION", "ap-southeast-1"

) # Singapore or Jakarta (ap-southeast-3)

MODEL_ID = os.getenv("MODEL_ID", "global.anthropic.claude-opus-4-6-v1")

MAX_TOKENS = int(os.getenv("MAX_TOKENS", "8000"))

TEMPERATURE = float(os.getenv("TEMPERATURE", "1"))

THINKING_TYPE = os.getenv("THINKING_TYPE", "adaptive")

EFFORT_LEVEL = os.getenv("EFFORT_LEVEL", "medium")

# Initialize Bedrock Runtime client for your Region

bedrock_runtime = boto3.client(service_name="bedrock-runtime", region_name=REGION)

# Example: Architecture trade-offs analysis

user_query = "Analyze the trade-offs between microservices and monolithic architectures for a mid-size SaaS company."

# Make inference request using Converse API with adaptive thinking

try:

response = bedrock_runtime.converse(

modelId=MODEL_ID,

messages=[{"role": "user", "content": [{"text": user_query}]}],

inferenceConfig={

"maxTokens": MAX_TOKENS,

"temperature": TEMPERATURE

},

additionalModelRequestFields={

"thinking": {"type": THINKING_TYPE},

"output_config": {"effort": EFFORT_LEVEL},

},

)

except ClientError as e:

logger.error("Failed to invoke model %s: %s", MODEL_ID, e)

raise

# Extract response content

output_message = response["output"]["message"]

has_thinking = any(block.get("type") == "thinking" for block in output_message["content"])

logger.info("Effort level: %s", EFFORT_LEVEL)

logger.info("Claude decided to think: %s", has_thinking)

for block in output_message["content"]:

if block.get("type") == "thinking":

thinking_tokens = len(block["thinking"].split())

logger.info("[Thinking]: ~%d words", thinking_tokens)

elif block.get("text"):

logger.info("[Response]: %s", block["text"])

如果您是第一次使用跨区域功能,您可能会认为将请求路由到多个区域会使您的监控设置复杂化。但对于全局CRIS而言并非如此。即使推理请求在其他地方处理,您的Amazon CloudWatch指标、CloudWatch日志和AWS CloudTrail审计日志也保留在您的源区域中。您现有的仪表板、警报和审计跟踪将像往常一样继续工作。

有关Converse API和可用参数的更多信息,请参阅Amazon Bedrock API参考。在此基础上,让我们探讨配额管理策略,以确保您的部署能够随需求扩展。

配额管理

随着您的应用程序从原型扩展到生产,了解和管理服务配额对于维持一致的性能至关重要。本节介绍配额的工作原理、如何监控使用情况以及何时需要请求增加。

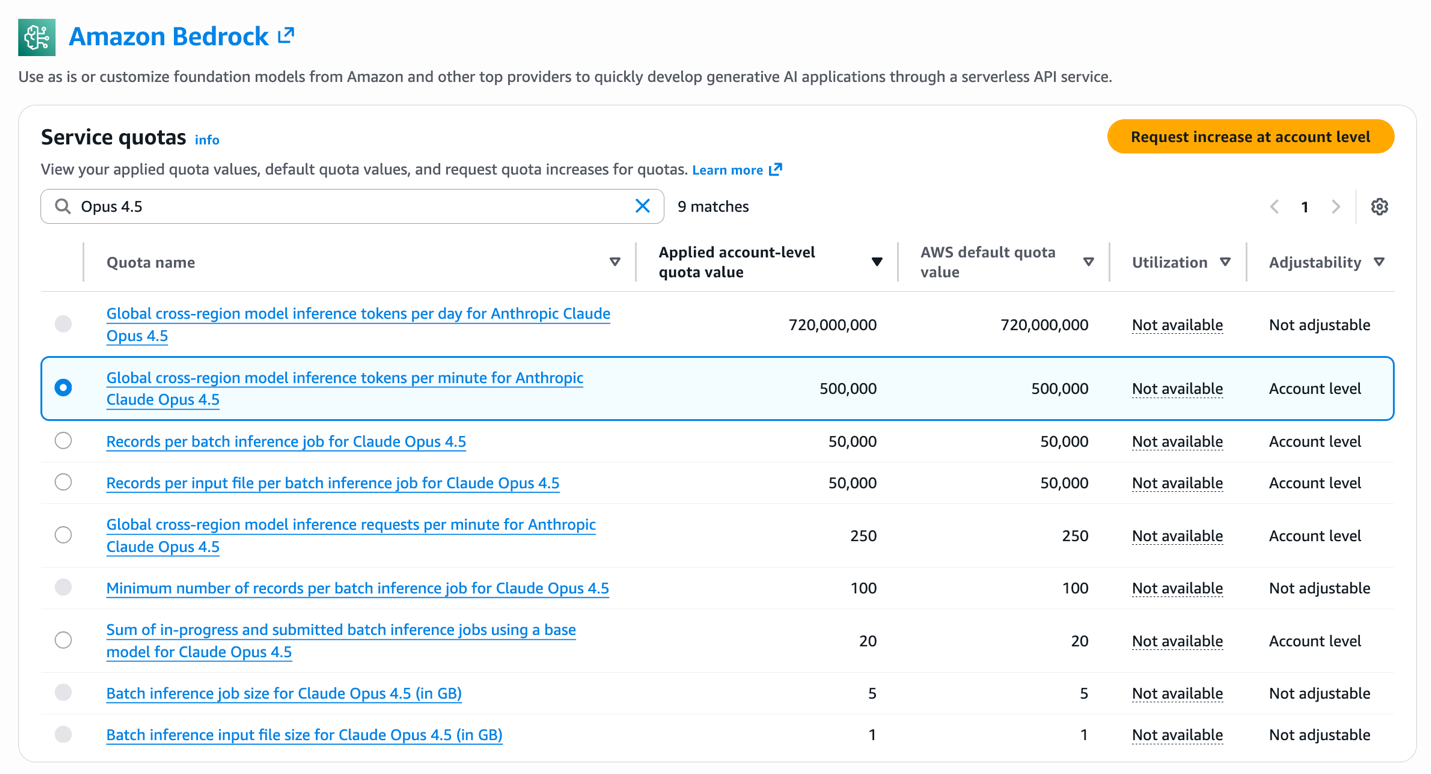

下图显示了AWS控制台中Amazon Bedrock服务配额页面,您可以在其中查看全局CRIS推理配置文件的已应用账户级别配额值。

理解配额和规划扩展

理解配额和规划扩展是确保您的全局CRIS部署能够处理生产流量而不被限流的第一步。Amazon Bedrock会实施服务配额,以促进公平的资源分配和系统稳定性。随着应用程序从原型扩展到生产,这一点变得至关重要。对于全局CRIS,配额在两个维度上进行衡量,每个维度在容量管理中服务于不同的目的:

- 每分钟令牌数(TPM) – 每分钟可以处理的最大令牌数(输入+输出)

- 每分钟请求数(RPM) – 每分钟可以发出的最大推理请求数

默认配额因模型而异,并按源区域分配。您可以在源区域(新加坡或雅加达)的Amazon Bedrock服务配额中,通过导航至AWS 服务配额控制台查看当前的配额。

请注意,Amazon Bedrock使用一种令牌燃尽率(token burndown rate),在计算配额消耗时,输出令牌的权重高于输入令牌。燃尽率为5:1——输出令牌消耗的配额是输入令牌的五倍,因为生成令牌比处理输入需要更多的计算。

配额消耗 = 输入令牌 + (输出令牌 × 5)

例如,如果您的请求使用10,000个输入令牌并生成5,000个输出令牌:

总配额消耗 = 10,000 + (5,000 × 5) = 35,000 令牌

该请求会消耗35,000个令牌以进行TPM配额的限流目的。在规划容量需求和请求配额增加时,您需要考虑此燃尽率。如果您的应用程序以每分钟100个请求的速度处理具有相同令牌模式的请求,则总配额消耗将为3,500,000 TPM(100个请求 × 35,000个令牌/请求)。在与您的AWS客户经理协商配额增加请求时,请提供您预期的请求量、平均输入令牌数和平均输出令牌数,以便他们可以使用此燃尽乘数计算适当的配额分配。

有效管理配额

我们建议在70%–80%的配额使用率时设置CloudWatch警报,以便在达到限流限制之前请求增加。CloudWatch指标InputTokenCount和OutputTokenCount实时跟踪您的消耗情况,而InvocationClientErrors指标在激增时指示限流——为容量规划提供早期预警信号。有关可用指标和如何为Bedrock工作负载配置监控的详细指南,请参阅监控Amazon Bedrock的性能。

对于非时间敏感的工作负载,Claude Haiku 4.5支持批量推理,可节省50%的成本。批量请求在24小时内异步处理,不计入您的实时TPM配额。

请求配额增加

在确定是否需要配额增加时,请考虑以下因素:工作负载规模(高峰流量期间的每分钟请求数)、输出令牌比率(高输出生成会更快消耗配额)和增长预测(考虑6-12个月的扩展需求)。如果您的工作负载需要超出默认限制的配额,您可以通过AWS 服务配额控制台请求增加。

通过AWS 服务配额控制台请求配额增加,请完成以下步骤:

- 登录到源区域的AWS服务配额控制台。

- 导航到AWS服务并选择Amazon Bedrock。

- 搜索您特定模型的

Global cross-Region model inference tokens per minute。 - 选择配额并选择请求账户级别增加。

- 输入您期望的配额值并提供增加的理由。

- 提交请求以供AWS审核。

提前规划配额增加,以帮助确保在您的启动或扩展事件之前有可用容量。对于大规模部署或时间敏感的启动,我们建议与您的AWS客户团队合作,以确保适当的容量规划和加速审核。有了配额管理策略,让我们探讨如何为您的特定用例在Opus 4.6、Sonnet 4.6和Haiku 4.5之间进行选择。

从Claude 3.x迁移到Claude 4.5 / 4.6

从Claude 3.x到Claude 4.5 / 4.6的迁移对于使用Opus、Sonnet或Haiku版本的组织来说,是一次重大的技术飞跃。Claude的混合推理架构在工具集成、内存管理和上下文处理能力方面引入了实质性的改进。

有关更多技术实施指南,请参阅AWS博客文章从Anthropic的Claude Sonnet 3.x迁移到Amazon Bedrock上的Claude Sonnet 4.x,其中提供了对新Claude Sonnet 4.6模型同样有效的基本最佳实践。此外,Anthropic的迁移文档提供了模型特定的优化策略和过渡到Claude 4.5 / 4.6模型的注意事项。

最佳实践

考虑以下优化技术,以最大限度地提高工作负载的性能并降低成本:

1. 重复上下文的提示缓存

提示缓存可为缓存的令牌提供高达90%的成本削减和高达85%的延迟改进,适用于重复使用相同上下文的工作负载。缓存超过500个令牌的系统提示、文档内容、少样本示例和工具定义。以静态内容开头,动态查询结尾来构造提示。请参阅 ... [内容被截断]

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区