📢 转载信息

原文作者:Matthew Lee, Jonah Craig, and Siamak Nariman

在精准医疗领域,研究人员在开发早期疾病检测诊断测试时面临一个关键挑战:数据集包含数千个潜在的生物标志物,但患者样本却只有几百个。这种维度灾难可能会决定突破性发现的成败。

现代生物信息学使用多种组学模式——基因组学、脂质组学、蛋白质组学和代谢组学——来开发早期疾病检测测试。该行业的研究人员也常常面临特征数量远超样本数量的挑战。随着考虑的新模式的增加,排列组合呈指数级增长,使得实验跟踪成为一项重大挑战。此外,源代码控制和代码质量是整体机器学习架构的任务关键方面。如果没有高效的机器学习运营(MLOps)流程到位,这一点很容易被忽视,尤其是在周期的早期发现阶段。

在本文中,我们将探讨Sonrai(一家生命科学AI公司)如何与AWS合作,利用Amazon SageMaker AI构建了一个强大的MLOps框架,该框架解决了这些挑战,同时保持了受监管环境中所需的可追溯性和可重复性。

MLOps概述

MLOps结合了ML、DevOps和数据工程实践,以可靠、高效地在生产中部署和维护ML系统。

从一开始就实施MLOps最佳实践,可以实现更快的实验迭代和可信赖、可追溯的模型部署,这些对于治理和验证至关重要的医疗技术公司来说都是必不可少的。

Sonrai的数据挑战

Sonrai与一家开发罕见癌症生物标志物测试的大型生物技术公司合作。该项目涉及跨越蛋白质组学、代谢组学和脂质组学多种组学模式的丰富数据集,目标是确定具有高灵敏度和特异性的早期检测生物标志物的最佳特征组合。客户面临着几个关键挑战。他们的数据集包含来自三种模式的超过8000个潜在生物标志物,但只有几百个患者样本。这种极端的特征与样本比率需要复杂的特征选择来避免过拟合。团队需要评估数百种模式组合和建模方法,使得手动实验跟踪变得不可行。由于诊断测试旨在用于临床,从原始数据到每一个建模决策再到最终部署的模型,完整的可追溯性对于监管提交至关重要。

解决方案概述

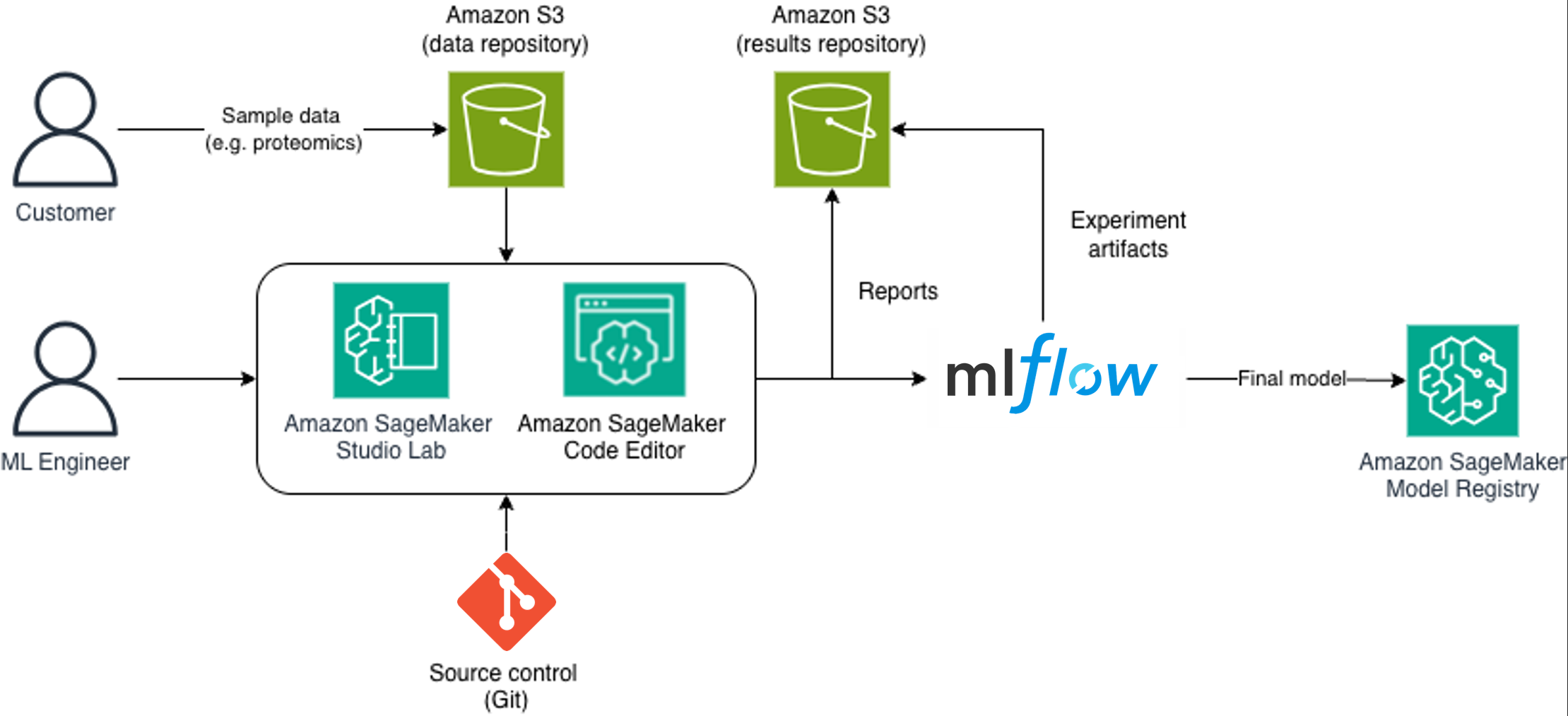

为了解决这些MLOps挑战,Sonrai利用SageMaker AI架构了一个全面的解决方案,SageMaker AI是一项完全托管的服务,供数据科学家和开发人员大规模构建、训练和部署ML模型。该解决方案有助于提供更安全的数据管理、灵活的开发环境、强大的实验跟踪以及具有完全可追溯性的简化模型部署。下图说明了架构和流程。

端到端的MLOps工作流程遵循清晰的路径:

- 客户将样本数据提供给Amazon Simple Storage Service (Amazon S3) 中的安全数据存储库。

- ML工程师使用Amazon SageMaker Studio Lab和Code Editor,连接到源代码控制。

- 管道从数据存储库读取数据、处理数据并将结果写入Amazon S3。

- 实验记录在Amazon SageMaker Studio内的MLflow中。

- 生成的报告存储在Amazon S3中,并与利益相关者共享。

- 经验证的模型被提升到Amazon SageMaker Model Registry。

- 最终模型部署用于推理或进一步验证。

这种架构有助于实现完全可追溯性:每个注册的模型都可以追溯到生成它的源数据和代码版本,包括超参数选择和数据集划分。

使用Amazon S3进行安全数据管理

Sonrai解决方案的基础是借助Amazon S3进行安全数据管理。Sonrai配置了具有分层访问控制的S3存储桶,用于敏感患者数据。样本和临床数据存储在具有受限访问权限的专用数据存储库存储桶中,有助于满足数据保护要求的治理。单独的结果存储库存储桶用于存储处理过的数据、模型输出和生成的报告。这种分离确保了原始患者数据保持安全,同时实现了分析结果的灵活共享。与Git存储库的无缝集成支持协作、源代码控制和质量保证流程,同时将敏感患者数据安全地保留在AWS环境中——这对维护受监管行业的治理至关重要。

SageMaker AI MLOps

从项目开始,Sonrai就在其SageMaker AI环境中同时使用了JupyterLab和Code Editor界面。该环境与客户的Git存储库集成进行源代码控制,从第一天起就建立了版本控制和代码审查工作流程。SageMaker AI提供了广泛的ML优化计算实例,可以在几分钟内配置并在不使用时停止,从而优化了成本效益。对于此项目,Sonrai使用了具有足够内存来处理大型组学数据集的计算实例,在密集的建模运行时启动它们,并在分析阶段关闭它们。Code Editor作为构建生产质量管道的主要开发环境,具有集成的调试和Git工作流程功能。JupyterLab用于数据探索和客户协作会议,其交互式笔记本格式便于实时讨论结果。

诸如Quarto(一个开源技术出版系统)之类的第三方工具安装在SageMaker计算环境中,以便在建模管道本身内生成报告。一个单一的Quarto渲染命令执行完整的管道,并在几分钟内自动写入结果S3存储桶,利益相关者可以从中下载准备好的报告,其中包含交互式可视化、统计表和详细的Markdown注释。

托管式MLflow

SageMaker AI中托管的MLflow功能实现了无缝的实验跟踪。在SageMaker AI环境中执行的实验会自动在MLflow中跟踪和记录,捕获实验过程的全面视图。对于此项目,MLflow成为建模实验的单一事实来源,记录性能指标、超参数、特征重要性排名和自定义工件(如ROC曲线和混淆矩阵)。MLflow UI提供了一个直观的界面,用于并排比较实验,使团队能够快速识别有前景的方法并在客户审查会议期间共享结果。

MLOps管道

Sonrai的建模管道被构建为可重现、版本控制的工作流程,通过多个阶段处理原始数据以生成最终模型:

- 从Amazon S3加载、标准化和质量控制原始组学数据。

- 应用领域特定的转换以创建可用于建模的特征。

- 递归特征消除(RFE)将数千个特征减少到对疾病检测最重要的特征。

- 针对单个和组合的模式训练多个模型。

- 评估模型性能并生成综合报告。

每次管道执行都会在MLflow中进行跟踪,捕获输入数据版本、代码提交、超参数和性能指标。这创建了从原始数据到最终模型的可审计跟踪,对于监管提交至关重要。管道在SageMaker训练作业上执行,这些作业提供可扩展的计算资源并自动捕获训练元数据。最关键的管道阶段是RFE,它在监控模型性能的同时迭代地移除不重要的特征。MLflow跟踪了每一次迭代,记录了哪些特征被移除、模型在每个步骤的性能以及最终选择的特征集。这种详细的跟踪使得特征选择决策的验证和为监管审查提供文档成为可能。

模型部署

Sonrai以互补的方式使用MLflow和SageMaker Model Registry,在整个开发生命周期中管理模型工件和元数据。在积极实验期间,MLflow充当主要的跟踪系统,通过轻量级的实验跟踪实现快速迭代。当模型满足预定性能阈值并准备好进行更广泛的验证或部署时,它会被提升到SageMaker Model Registry。这种提升代表了从研究到开发的正式过渡。候选模型会根据成功标准进行评估,与其推理代码和容器一起打包,并使用唯一的版本标识符在SageMaker Model Registry中注册。SageMaker Model Registry支持与Sonrai质量管理系统保持一致的正式部署批准工作流程:

- 待定 (Pending) – 等待审查的新注册模型

- 已批准 (Approved) – 已通过验证标准并准备好部署的模型

- 已拒绝 (Rejected) – 未达到验收标准,并附有记录的原因

对于癌症生物标志物项目,模型根据严格的临床标准进行评估:灵敏度至少为90%,特异性至少为85%,AUC-ROC至少为0.90。对于已批准的模型,部署选项包括用于实时推理的SageMaker端点、用于处理大型数据集的批量转换作业,或检索模型工件以部署到客户特定的环境中。

结果和模型性能

使用SageMaker AI上的ML优化计算实例,整个管道——从原始数据到最终模型和报告——的执行时间不到10分钟。这种快速迭代周期支持每日模型更新、客户会议期间的实时协作以及假设的即时验证。过去需要数天才能完成的工作,现在可以在一次客户通话中完成。

建模管道针对单个模式和多模式组合生成了15个独立模型。性能最佳的模型结合了蛋白质组学和代谢组学特征,实现了94%的灵敏度和89%的特异性,AUC-ROC为0.93。这种多模式方法优于单一模式,证明了整合不同组学数据类型的价值。获胜模型被提升到SageMaker Model Registry,包含完整的元数据,包括模型工件位置、训练数据集、MLflow实验ID、评估指标和自定义元数据。该注册模型在客户临床团队进行额外验证后,才批准进行临床验证研究。“使用SageMaker AI进行整个模型开发过程,使团队能够以完全的可追溯性和对最终结果的信心进行协作和快速迭代。Amazon SageMaker AI中丰富的一套服务使其成为稳健的模型开发、部署和监控的完整解决方案,” Sonrai的AI和医学影像总监Matthew Lee说。

结论

Sonrai与AWS合作开发了一个MLOps解决方案,利用SageMaker AI加速精准医疗试验。该解决方案解决了生物标志物发现中的关键挑战:在处理有限的患者样本的同时管理来自多种组学模式的数千个特征的数据集,跟踪数百个复杂的实验排列组合,以及为监管准备工作维护版本控制和可追溯性。

结果是一个可扩展的MLOps框架,将开发迭代时间从几天缩短到几分钟,同时促进了可重复性和监管就绪性。SageMaker AI开发环境、MLflow实验跟踪和SageMaker Model Registry的结合,提供了从原始数据到已部署模型的端到端可追溯性——这对于科学有效性和治理都至关重要。Sonrai看到了以下关键结果:

- 建模和跟踪了8,916个生物标志物

- 进行了数百次具有完整谱系(lineage)的实验

- 用于生物标志物报告的数据整理时间减少了50%

在此基础上,Sonrai正在扩展其SageMaker AI MLOps能力。该团队正在开发自动再训练管道,当新的患者数据可用时触发模型更新,使用Amazon EventBridge来编排SageMaker AI管道,以监控数据漂移和模型性能下降。

Sonrai还正在扩展架构以支持跨多个临床站点的联邦学习,从而在敏感患者数据保留在每个机构的同时,实现协作模型开发。选定的模型正在部署到SageMaker端点以进行实时预测,以支持临床决策支持应用。

立即开始使用Amazon SageMaker for MLOps来构建您自己的ML Ops管道。请查找我们的入门级Amazon SageMaker ML Ops 研讨会。

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区