📢 转载信息

原文链接:http://bair.berkeley.edu/blog/2025/03/25/rl-av-smoothing/

原文作者:Berkeley AI Research (BAIR)

我们部署了100辆由强化学习(RL)控制的汽车进入高峰时段的高速公路交通中,旨在为所有人平抑拥堵并减少燃料消耗。我们的目标是解决那些通常没有明确原因,但会导致拥堵和大量能源浪费的“走走停停”(stop-and-go)波。为了训练高效的流量平抑控制器,我们构建了快速、数据驱动的模拟环境,供RL智能体与之交互,学习如何在保证吞吐量和在人类驾驶员周围安全操作的同时,最大化能源效率。

总体而言,一小部分控制良好的自动驾驶汽车(AV)足以显著改善道路上所有驾驶员的交通流量和燃油效率。 此外,所训练的控制器旨在可以部署在大多数现代车辆上,以分散式方式运行,并依赖标准的雷达传感器。在我们最新的论文中,我们探索了将RL控制器从模拟环境部署到实地进行大规模部署所面临的挑战,并在此次百车实验中进行了验证。

“幽灵拥堵”的挑战

一个“走走停停”波在高速公路上向后移动。

如果您开车,您肯定经历过“走走停停”波带来的沮丧感:那些看似毫无来由、突然出现然后又突然消失的交通减速现象。这些波浪通常是由我们驾驶行为中的微小波动引起的,这些波动在交通流中被放大。我们自然会根据前方的车辆调整速度。如果间隙变大,我们会加速以跟上;如果前车刹车,我们也会减速。但由于我们有非零的反应时间,我们可能刹车比前车稍微用力一点。后面的司机也会这样做,这种现象不断放大。随着时间的推移,最初微不足道的减速演变成后方交通的完全停止。这些波浪向后穿过交通流,由于频繁的加速,导致能源效率大幅下降,同时伴随着二氧化碳排放增加和事故风险上升。

这并非孤立现象!当交通密度超过某个临界阈值时,这些波浪在繁忙的道路上无处不在。那么我们如何解决这个问题呢?传统的做法,如匝道计量和可变限速,试图管理交通流量,但它们通常需要昂贵的基础设施和集中协调。一个更具可扩展性的方法是使用自动驾驶汽车(AV),它们可以实时动态调整驾驶行为。然而,仅仅将AVs插入人类驾驶员中间是不够的:它们还必须以更智能的方式驾驶,为每个人改善交通,这就是RL发挥作用的地方。

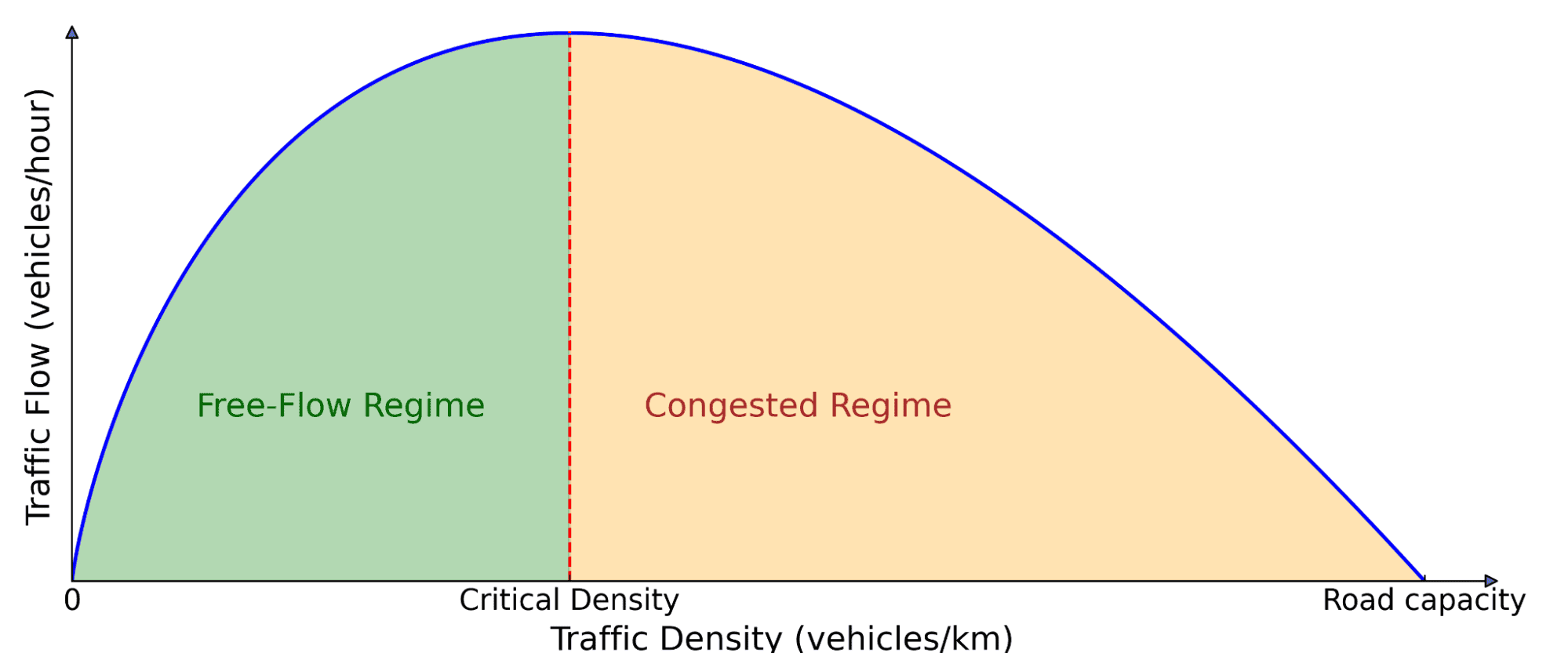

交通流的基本图。道路上的车辆数量(密度)会影响向前移动的流量。在低密度下,增加更多车辆会增加流量,因为可以通过更多的车辆。但超过临界阈值后,车辆开始互相阻碍,导致拥堵,此时增加更多车辆实际上会减慢整体移动速度。

用于波浪平抑AV的强化学习

强化学习(RL)是一种强大的控制方法,智能体(agent)通过与环境交互来学习最大化奖励信号。智能体通过试错收集经验,从错误中学习,并随时间推移而改进。在我们的案例中,环境是一个混合自主交通场景,AVs在这里学习驾驶策略,以抑制“走走停停”波,并降低自身及附近人类驾驶车辆的燃料消耗。

训练这些RL智能体需要能够复制高速公路“走走停停”行为的、具有逼真交通动态的快速模拟环境。为实现这一目标,我们利用了在田纳西州纳什维尔附近的24号州际公路(I-24)收集的实验数据,并用这些数据构建了模拟环境,其中车辆重放高速公路轨迹,产生不稳定的交通状况,后面行驶的AVs则从中学习如何平抑这些波动。

模拟重放了一条显示多个“走走停停”波形的高速公路轨迹。

我们在设计AV时就考虑到了部署的因素,确保它们仅能使用关于自身和前方车辆的基本传感器信息进行操作。观测数据包括AV的速度、前车的速度以及它们之间的空间间隔。根据这些输入,RL智能体为AV开出瞬时加速度或期望速度。仅使用这些局部测量值的关键优势在于,RL控制器可以以去中心化的方式部署在大多数现代车辆上,而无需额外基础设施。

奖励设计

最具挑战性的部分是设计一个奖励函数,当其被最大化时,能够与我们期望AV实现的不同目标保持一致:

- 波浪平抑: 减少“走走停停”的振荡。

- 能源效率: 降低所有车辆(而不仅仅是AV)的燃料消耗。

- 安全性: 确保合理的跟车距离并避免急刹车。

- 驾驶舒适性: 避免激进的加速和减速。

- 遵守人类驾驶规范: 确保一种“正常”的驾驶行为,不让周围驾驶员感到不适。

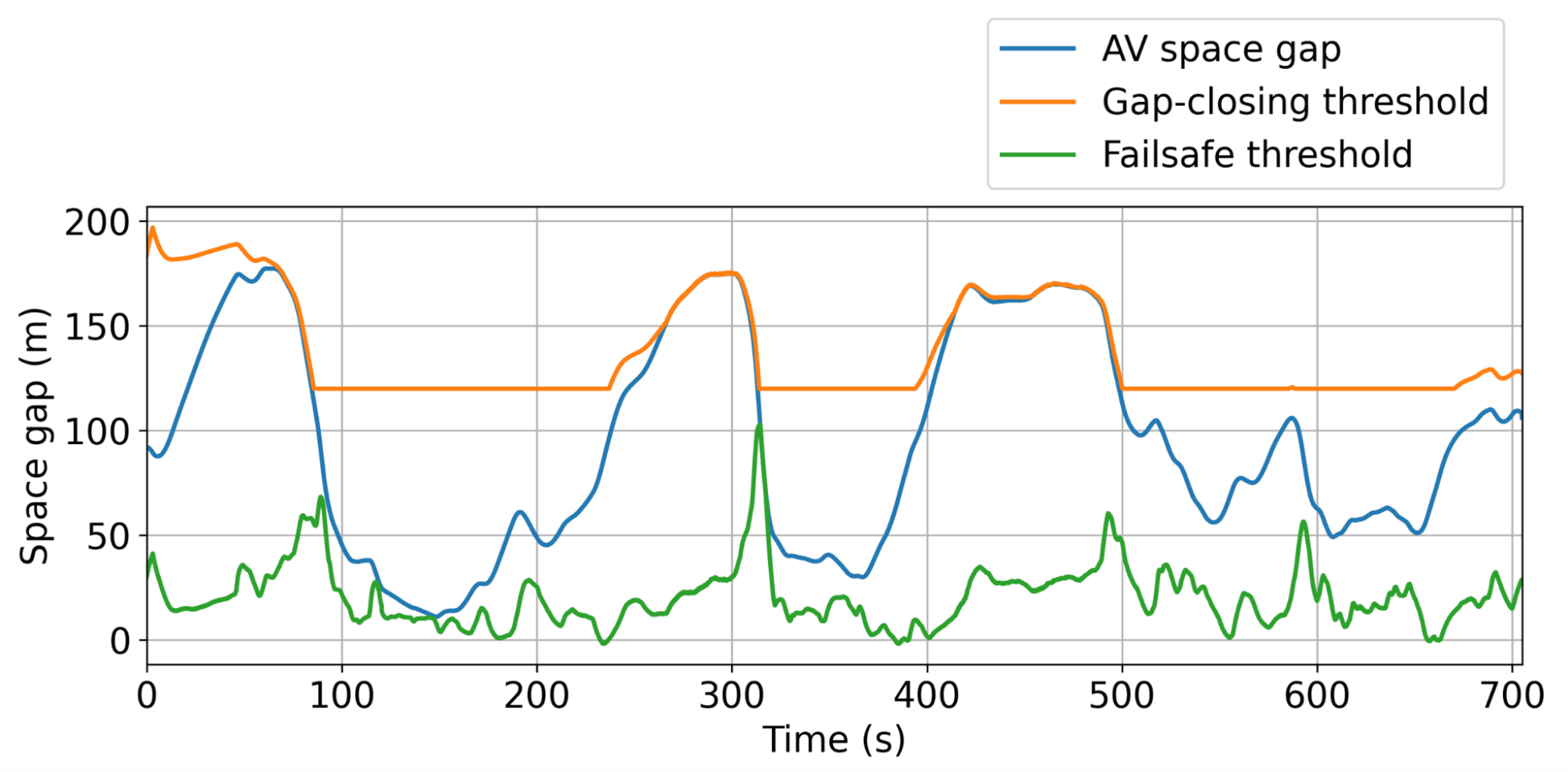

将这些目标平衡在一起是很困难的,因为必须找到每个项的合适系数。例如,如果最小化燃料消耗在奖励中占主导地位,RL AVs会学着在高速公路中间停下来,因为那样是最节能的。为防止这种情况,我们引入了动态最小和最大间隙阈值,以确保安全合理的行为,同时优化燃油效率。我们还惩罚了AV后方人类驾驶车辆的燃料消耗,以阻止RL学习一种自私的行为,即以牺牲周围交通为代价来优化自身的能源节约。总的来说,我们的目标是在能源节约与合理安全的驾驶行为之间取得平衡。

模拟结果

动态最小和最大间隙阈值的示意图,AV可以在此范围内自由操作,以尽可能高效地平抑交通。

AVs学习到的典型行为是保持比人类驾驶员稍大的间隙,这使它们能够更有效地吸收前方可能出现的、突然的交通减速。在模拟中,这种方法在最拥堵的情况下,使所有道路使用者节省了高达20%的燃料,而此时道路上仅有不到5%的AVs。而且这些AVs不必是特殊的车辆!它们可以是配备了智能自适应巡航控制(ACC)的普通消费级汽车,这正是我们进行规模化测试的内容。

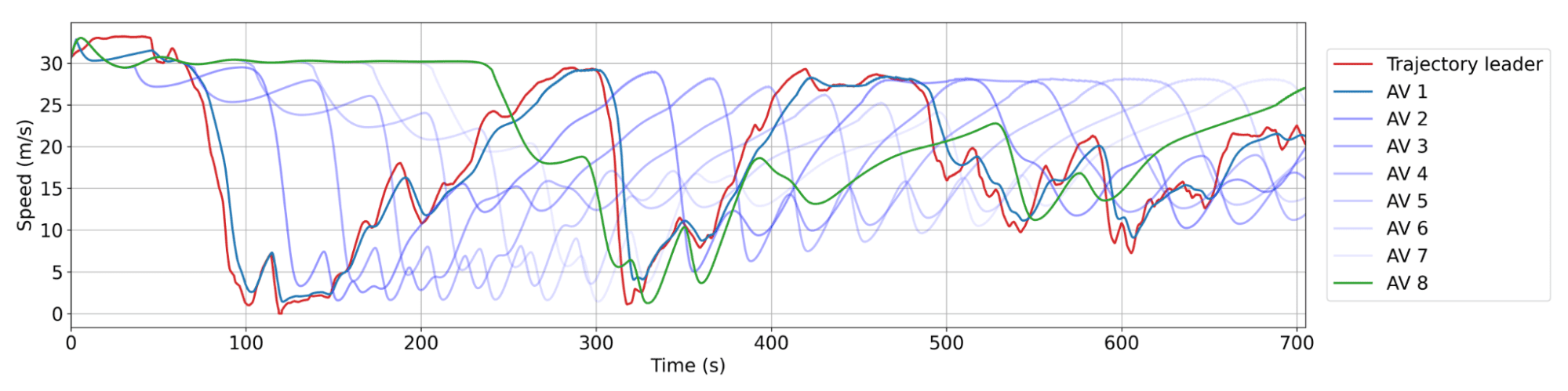

RL AVs的平抑行为。 红色:数据集中的人类轨迹。 蓝色:队列中连续的AVs,其中AV 1是最靠近人类轨迹的。AV之间通常有20到25辆人类驾驶的汽车。每个AV减速的幅度或加速的速度都不会像其前车那么大,从而随着时间的推移导致波幅减小,并实现节能。

RL AVs的平抑行为。 红色:数据集中的人类轨迹。 蓝色:队列中连续的AVs,其中AV 1是最靠近人类轨迹的。AV之间通常有20到25辆人类驾驶的汽车。每个AV减速的幅度或加速的速度都不会像其前车那么大,从而随着时间的推移导致波幅减小,并实现节能。

100车队实地测试:将RL大规模部署

100辆汽车在实验周期间停在我们运营中心的样子。

鉴于模拟结果令人鼓舞,自然而然的下一步就是弥合从模拟到高速公路的差距。我们将训练好的RL控制器部署在I-24上的100辆车上,在连续几天的高峰交通时段进行测试。这项被称为MegaVanderTest的大规模实验,是迄今为止进行的最大规模的混合自主交通平抑实验。

在实地部署RL控制器之前,我们对其进行了广泛的模拟训练和评估,并在硬件上进行了验证。总的来说,部署步骤包括:

- 数据驱动模拟训练: 我们使用I-24的高速公路交通数据创建了一个具有逼真波浪动态的训练环境,然后在一系列新的交通场景中验证训练后智能体的性能和鲁棒性。

- 硬件部署: 在机器人软件中验证后,训练好的控制器被上传到汽车上,能够控制车辆的设定速度。我们通过车辆的车载巡航控制系统进行操作,该系统充当低层安全控制器。

- 模块化控制框架: 测试期间的一个关键挑战是没有获取到前车信息传感器的权限。为克服这一点,RL控制器被集成到一个分层系统中,即MegaController,该系统结合了考虑下游交通状况的速度规划器指南,并将RL控制器作为最终决策者。

- 硬件验证: RL智能体被设计用于在大多数车辆由人类驾驶的环境中运行,这要求策略具有鲁棒性,能够适应不可预测的行为。我们通过在仔细的人工监督下在道路上驾驶RL控制的车辆来验证这一点,并根据反馈对控制进行调整。

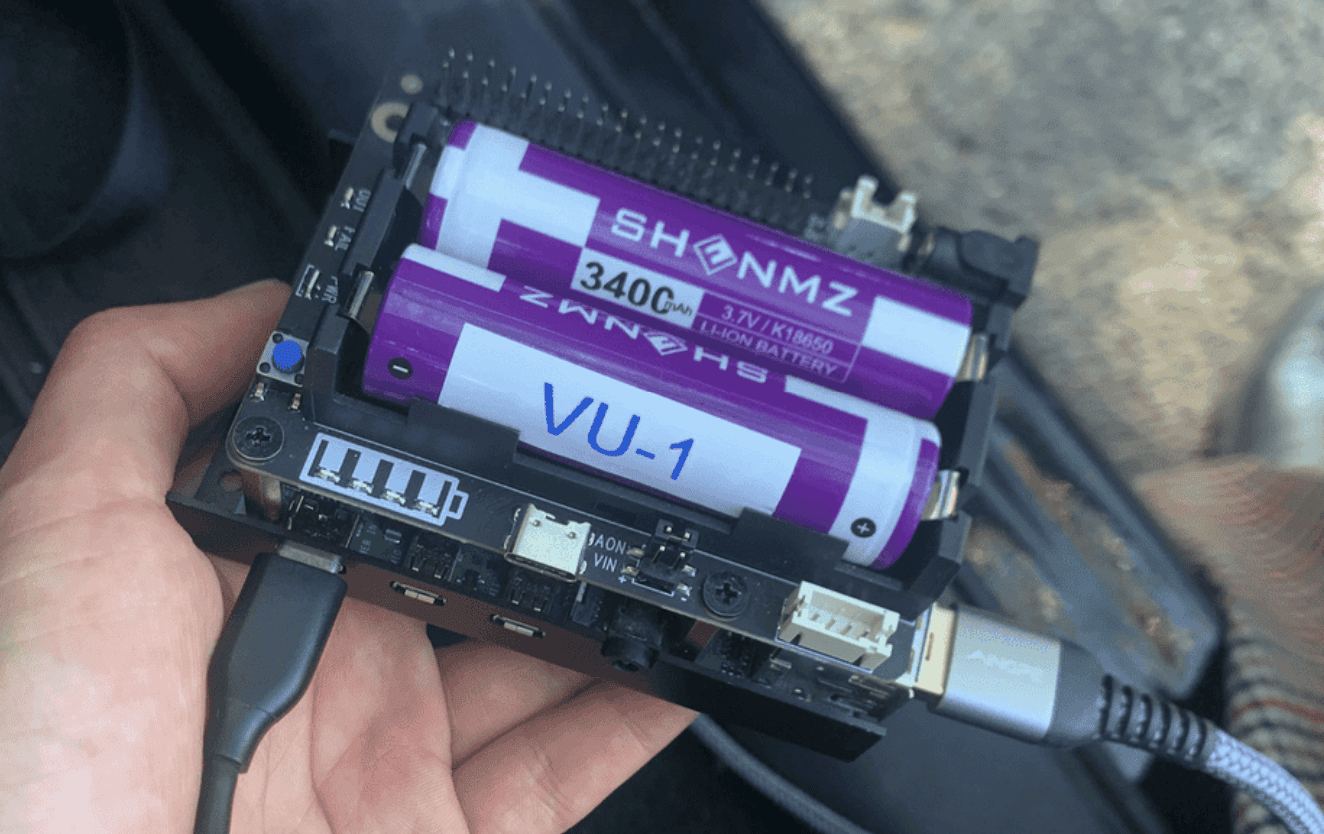

100辆车中的每一辆都连接到一个Raspberry Pi,RL控制器(一个小型神经网络)部署在该设备上。

100辆车中的每一辆都连接到一个Raspberry Pi,RL控制器(一个小型神经网络)部署在该设备上。

RL控制器直接控制车载自适应巡航控制(ACC)系统,设置其速度和期望的跟车距离。

RL控制器直接控制车载自适应巡航控制(ACC)系统,设置其速度和期望的跟车距离。

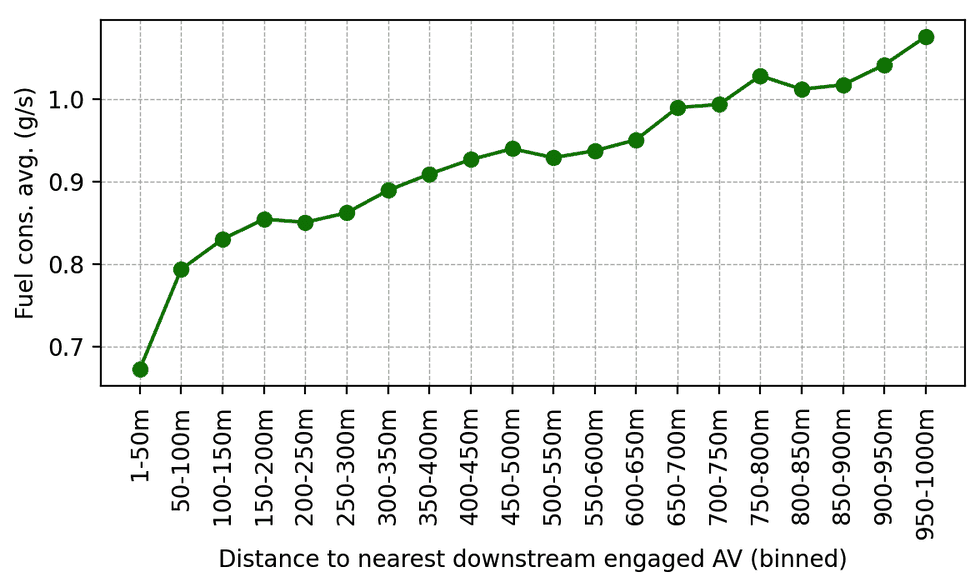

验证完成后,RL控制器被部署到100辆汽车上,并在早高峰时段在I-24上行驶。周围的交通对实验不知情,确保了驾驶行为的无偏性。实验期间,数据是通过沿高速公路设置的数十个高空摄像头收集的,通过计算机视觉流程提取了数百万条单独的车辆轨迹。根据这些轨迹计算的指标表明,在AV周围的区域,燃料消耗呈下降趋势,这与模拟结果和先前较小的验证部署相符。例如,我们可以观察到,人们离我们的AV越近,他们平均消耗的燃料似乎就越少(这是使用校准的能源模型计算得出的):

平均燃料消耗与下游交通中最近的、启用了RL控制的AV的距离函数关系。人类驾驶员离AV越远,其平均燃料消耗就越高。

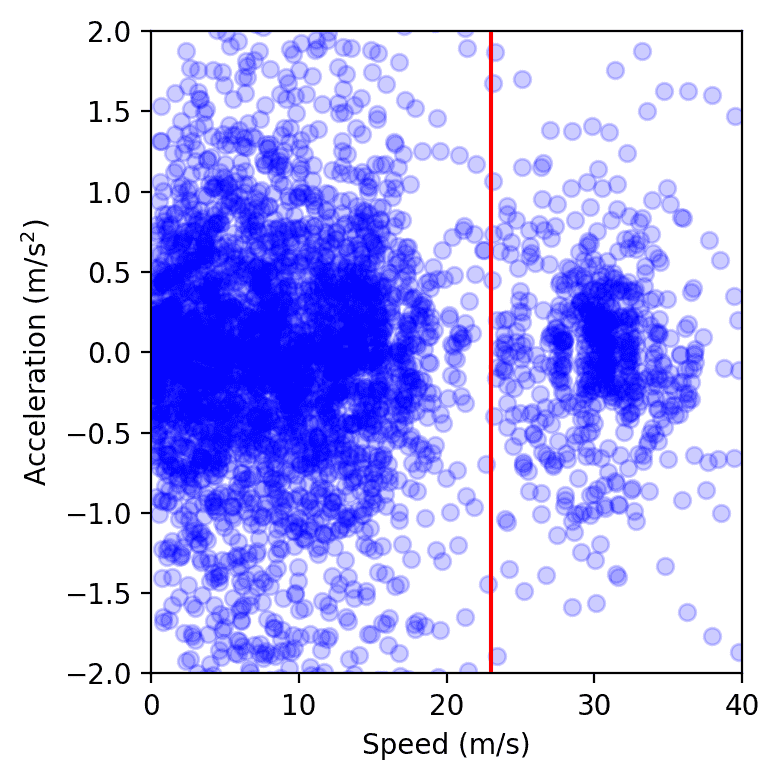

衡量的另一个方法是测量速度和加速度的方差:方差越低,波的幅度应该越小,这与我们在实地测试数据中观察到的情况一致。总的来说,尽管从大量的摄像机视频数据中获得精确的测量是复杂的,但我们观察到在我们的控制车辆周围有15%到20%的能源节约。

实验某一天中高速公路上所有车辆在速度-加速度空间中的数据点。红色线条左侧的簇代表拥堵,右侧的簇代表自由流。我们观察到,存在AV时,拥堵簇的面积更小,通过计算软凸包的面积或拟合高斯核来衡量。

最后的思考

这次100车队实地操作测试是去中心化的,AV之间没有明确的合作或通信,这反映了当前自动驾驶技术的部署现状,并使我们离更平稳、更节能的高速公路更近了一步。然而,仍然有巨大的改进潜力。将模拟环境扩展到更快、更准确,并包含更好的人类驾驶模型,对于弥合模拟到现实的差距至关重要。为AV配备额外的交通数据(无论是通过先进传感器还是集中规划),可以进一步提高控制器的性能。例如,虽然多智能体RL在改进协作控制策略方面很有前景,但启用AV之间通过5G网络进行显式通信是否能进一步提高稳定性和减轻“走走停停”波,仍然是一个悬而未决的问题。至关重要的是,我们的控制器与现有的自适应巡航控制(ACC)系统无缝集成,使得大规模的实地部署成为可能。配备智能交通平抑控制的车辆越多,我们道路上看到的波浪就越少,这意味着为每个人带来了更少的污染和更低的燃料消耗!

许多贡献者参与了MegaVanderTest的实现!完整的名单可以在CIRCLES项目页面上找到,其中包含有关该项目的更多详细信息。

阅读更多:[论文]

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区